- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章Python爬虫实现百度图片自动下载由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

制作爬虫的步骤 。

制作一个爬虫一般分以下几个步骤:

分析需求分析网页源代码,配合开发者工具编写正则表达式或者XPath表达式正式编写 python 爬虫代码 效果预览 。

运行效果如下:

存放图片的文件夹:

需求分析 。

我们的爬虫至少要实现两个功能:一是搜索图片,二是自动下载.

搜索图片:最容易想到的是爬百度图片的结果,我们就上百度图片看看:

随便搜索几个关键字,可以看到已经搜索出来很多张图片:

分析网页 。

我们点击右键,查看源代码:

打开源代码之后,发现一堆源代码比较难找出我们想要的资源.

这个时候,就要用开发者工具!我们回到上一页面,调出开发者工具,我们需要用的是左上角那个东西:(鼠标跟随).

然后选择你想看源代码的地方,就可以发现,下面的代码区自动定位到了相应的位置。如下图:

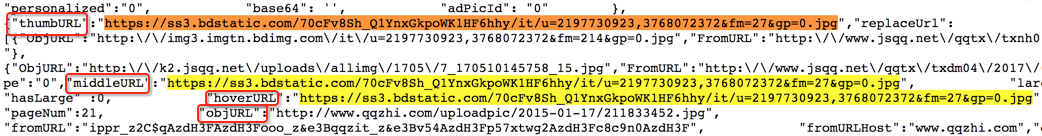

我们复制这个地址,然后到刚才的一堆源代码里搜索一下,发现了它的位置,但是这里我们又疑惑了,这个图片有这么多地址,到底用哪个呢?我们可以看到有thumbURL,middleURL,hoverURL,objURL 。

通过分析可以知道,前面两个是缩小的版本,hoverURL 是鼠标移动过后显示的版本,objURL 应该是我们需要的,可以分别打开这几个网址看看,发现 objURL 的那个最大最清晰.

找到了图片地址,接下来我们分析源代码。看看是不是所有的 objURL 都是图片.

发现都是以.jpg格式结尾的图片.

编写正则表达式 。

|

1

|

pic_url

=

re.findall(

'"objURL":"(.*?)",'

,html,re.S)

|

编写爬虫代码 。

这里我们用了2个包,一个是正则,一个是 requests 包 。

|

1

2

3

|

#-*- coding:utf-8 -*-

import

re

import

requests

|

复制百度图片搜索的链接,传入 requests ,然后把正则表达式写好 。

|

1

|

url = 'https://image.baidu.com/search/index?tn=baiduimage&ie=utf-8&word=%E6%A0%97%E5%B1%B1%E6%9C%AA%E6%9D%A5%E5%A4%B4%E5%83%8F&ct=201326592&ic=0&lm=-1&width=&height=&v=index' html = requests.get(url).text pic_url = re.findall('"objURL":"(.*?)",',html,re.S)

|

。

因为有很多张图片,所以要循环,我们打印出结果来看看,然后用 requests 获取网址,由于有些图片可能存在网址打不开的情况,所以加了10秒超时控制.

|

1

2

3

4

5

6

|

pic_url

=

re.findall(

'"objURL":"(.*?)",'

,html,re.S) i

=

1

for

each

in

pic_url:

print

each

try

:

pic

=

requests.get(each, timeout

=

10

)

except

requests.exceptions.ConnectionError:

print

(

'【错误】当前图片无法下载'

)

continue

|

。

接着就是把图片保存下来,我们事先建立好一个 images 目录,把图片都放进去,命名的时候,以数字命名.

|

1

2

3

4

5

|

dir

=

'../images/'

+

keyword

+

'_'

+

str

(i)

+

'.jpg'

fp

=

open

(

dir

,

'wb'

)

fp.write(pic.content)

fp.close()

i

+

=

1

|

完整的代码 。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

|

# -*- coding:utf-8 -*-

import

re

import

requests

def

dowmloadPic(html, keyword):

pic_url

=

re.findall(

'"objURL":"(.*?)",'

, html, re.S)

i

=

1

print

(

'找到关键词:'

+

keyword

+

'的图片,现在开始下载图片...'

)

for

each

in

pic_url:

print

(

'正在下载第'

+

str

(i)

+

'张图片,图片地址:'

+

str

(each))

try

:

pic

=

requests.get(each, timeout

=

10

)

except

requests.exceptions.ConnectionError:

print

(

'【错误】当前图片无法下载'

)

continue

dir

=

'../images/'

+

keyword

+

'_'

+

str

(i)

+

'.jpg'

fp

=

open

(

dir

,

'wb'

)

fp.write(pic.content)

fp.close()

i

+

=

1

if

__name__

=

=

'__main__'

:

word

=

input

(

"Input key word: "

)

url

=

'http://image.baidu.com/search/flip?tn=baiduimage&ie=utf-8&word='

+

word

+

'&ct=201326592&v=flip'

result

=

requests.get(url)

dowmloadPic(result.text, word)

|

我们看到有的图片没显示出来,打开网址看,发现确实没了.

因为百度有些图片它缓存到百度的服务器上,所以我们在百度上还能看见它,但它的实际链接已经失效了.

总结 。

enjoy 我们的第一个图片下载爬虫吧!当然它不仅能下载百度的图片,依葫芦画瓢,你现在应该能做很多事情了,比如爬取头像,爬淘宝展示图等等.

完整代码已经放到Githut上 https://github.com/nnngu/BaiduImageDownload 。

原文链接:https://www.cnblogs.com/nnngu/p/8410903.html 。

最后此篇关于Python爬虫实现百度图片自动下载的文章就讲到这里了,如果你想了解更多关于Python爬虫实现百度图片自动下载的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

我正在处理一组标记为 160 个组的 173k 点。我想通过合并最接近的(到 9 或 10 个组)来减少组/集群的数量。我搜索过 sklearn 或类似的库,但没有成功。 我猜它只是通过 knn 聚类

我有一个扁平数字列表,这些数字逻辑上以 3 为一组,其中每个三元组是 (number, __ignored, flag[0 or 1]),例如: [7,56,1, 8,0,0, 2,0,0, 6,1,

我正在使用 pipenv 来管理我的包。我想编写一个 python 脚本来调用另一个使用不同虚拟环境(VE)的 python 脚本。 如何运行使用 VE1 的 python 脚本 1 并调用另一个 p

假设我有一个文件 script.py 位于 path = "foo/bar/script.py"。我正在寻找一种在 Python 中通过函数 execute_script() 从我的主要 Python

这听起来像是谜语或笑话,但实际上我还没有找到这个问题的答案。 问题到底是什么? 我想运行 2 个脚本。在第一个脚本中,我调用另一个脚本,但我希望它们继续并行,而不是在两个单独的线程中。主要是我不希望第

我有一个带有 python 2.5.5 的软件。我想发送一个命令,该命令将在 python 2.7.5 中启动一个脚本,然后继续执行该脚本。 我试过用 #!python2.7.5 和http://re

我在 python 命令行(使用 python 2.7)中,并尝试运行 Python 脚本。我的操作系统是 Windows 7。我已将我的目录设置为包含我所有脚本的文件夹,使用: os.chdir("

剧透:部分解决(见最后)。 以下是使用 Python 嵌入的代码示例: #include int main(int argc, char** argv) { Py_SetPythonHome

假设我有以下列表,对应于及时的股票价格: prices = [1, 3, 7, 10, 9, 8, 5, 3, 6, 8, 12, 9, 6, 10, 13, 8, 4, 11] 我想确定以下总体上最

所以我试图在选择某个单选按钮时更改此框架的背景。 我的框架位于一个类中,并且单选按钮的功能位于该类之外。 (这样我就可以在所有其他框架上调用它们。) 问题是每当我选择单选按钮时都会出现以下错误: co

我正在尝试将字符串与 python 中的正则表达式进行比较,如下所示, #!/usr/bin/env python3 import re str1 = "Expecting property name

考虑以下原型(prototype) Boost.Python 模块,该模块从单独的 C++ 头文件中引入类“D”。 /* file: a/b.cpp */ BOOST_PYTHON_MODULE(c)

如何编写一个程序来“识别函数调用的行号?” python 检查模块提供了定位行号的选项,但是, def di(): return inspect.currentframe().f_back.f_l

我已经使用 macports 安装了 Python 2.7,并且由于我的 $PATH 变量,这就是我输入 $ python 时得到的变量。然而,virtualenv 默认使用 Python 2.6,除

我只想问如何加快 python 上的 re.search 速度。 我有一个很长的字符串行,长度为 176861(即带有一些符号的字母数字字符),我使用此函数测试了该行以进行研究: def getExe

list1= [u'%app%%General%%Council%', u'%people%', u'%people%%Regional%%Council%%Mandate%', u'%ppp%%Ge

这个问题在这里已经有了答案: Is it Pythonic to use list comprehensions for just side effects? (7 个答案) 关闭 4 个月前。 告

我想用 Python 将两个列表组合成一个列表,方法如下: a = [1,1,1,2,2,2,3,3,3,3] b= ["Sun", "is", "bright", "June","and" ,"Ju

我正在运行带有最新 Boost 发行版 (1.55.0) 的 Mac OS X 10.8.4 (Darwin 12.4.0)。我正在按照说明 here构建包含在我的发行版中的教程 Boost-Pyth

学习 Python,我正在尝试制作一个没有任何第 3 方库的网络抓取工具,这样过程对我来说并没有简化,而且我知道我在做什么。我浏览了一些在线资源,但所有这些都让我对某些事情感到困惑。 html 看起来

我是一名优秀的程序员,十分优秀!