- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章C#如何在海量数据下的高效读取写入MySQL由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

前提 。

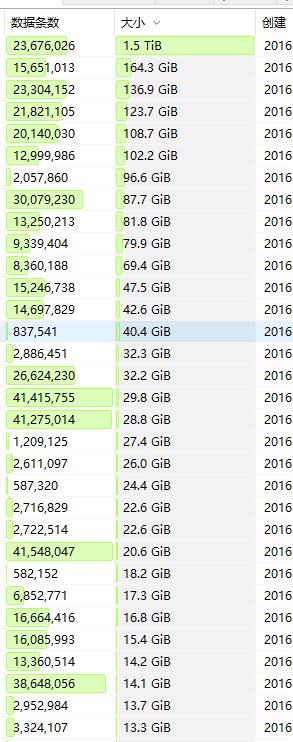

由于工作的原因,经常需要对海量数据进行处理,做的数据爬虫相关,动辄千万级别的数据,单表几十个G都是都是家常便饭。 主要开发语言是C#,数据库使用的是MySQL.

最常见的操作便是 select 读取数据,然后在C#中对数据进行处理, 完毕后再插入数据库中。 简而言之就 select -> process -> insert三个步骤。 对于数据量小的情况下(百万级别 or 几百兆)可能最多1个小时就处理完了。但是对于千万级数据可能几天,甚至更多。 那么问题来了,如何优化??

(数据库的一览,有图有真相) 。

第一步 解决读取的问题 。

跟数据库打交道的方式有很多,我来列举下吧:

1. 【重武器-坦克大炮】使用重型ORM框架,比如EF,NHibernat 这样的框架。 2. 【轻武器-AK47】 使用Dapper,PetaPoco之类,单cs文件。灵活高效,使用简单。居家越货必备(我更喜欢PetaPoco :)) 3. 【冷兵器?匕首?】使用原生的Connection、Command。 然后写原生的SQL语句。.

分析:

【重武器】在我们这里肯定直接被PASS, 他们应该被用在大型项目中。 。

【轻武器】Dapper,PetaPoco 看过源码你会发现用到了反射,虽然使用IL和缓存技术,但是还是会影响读取效率,PASS 好吧那就只有使用匕首,原生SQL走起, 利用DataReader 进行高效读取,并且使用索引取数据(更快),而不是列名。 大概的代码如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

|

using

(var conn =

new

MySqlConnection(

'Connection String...'

))

{

conn.Open();

//此处设置读取的超时,不然在海量数据时很容易超时

var c =

new

MySqlCommand(

'set net_write_timeout=9999999; set net_read_timeout=9999999'

, conn);

c.ExecuteNonQuery();

MySqlCommand rcmd =

new

MySqlCommand();

rcmd.Connection = conn;

rcmd.CommandText = @

'SELECT `f1`,`f2` FROM `table1`'

;

//设置命令的执行超时

rcmd.CommandTimeout = 99999999;

var myData = rcmd.ExecuteReader();

while

(myData.Read())

{

var f1= myData.GetInt32(0);

var f2= myData.GetString(1);

//这里做数据处理....

}

}

|

哈哈,怎么样,代码非常原始,还是使用索引来取数据,很容易出错。 当然一切为了性能咱都忍了 。

第二步 数据处理 。

其实这一步,根据你的业务需要,代码肯定不一, 不过无非是一些字符串处理,类型转换的操作,这时候就是考验你的C#基础功底的时候了。 以及如何高效编写正则表达式。。.

具体代码也没法写啊 ,先看完CLR via C# 在来跟我讨论吧 ,O(∩_∩)O哈哈哈~ 跳过。。。.

第三部 数据插入 。

如何批量插入才最高效呢? 有同学会说, 使用事务啊,BeginTransaction, 然后EndTransaction。 恩,这个的确可以提高插入效率。 但是还有更加高效的方法,那就是合并insert语句.

那么怎么合并呢?

|

1

|

insert

into

table

(f1,f2)

values

(1,

'sss'

),

values

(2,

'bbbb'

),

values

(3,

'cccc'

);

|

就是把values后面的全部用逗号,链接起来,然后一次性执行 .

当然不能一次性提交个100MB的SQL执行,MySQL服务器对每次执行命令的长度是有限制的。 通过 MySQL服务器端的max_allowed_packet 属性可以查看, 默认是1MB 。

咱们来看看伪代码吧 。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

|

//使用StringBuilder高效拼接字符串

var sqlBuilder =

new

StringBuilder();

//添加insert 语句的头

string

sqlHeader =

'insert into table1 (`f1`,`f2`) values'

;

sqlBuilder.Append(sqlHeader);

using

(var conn =

new

MySqlConnection(

'Connection String...'

))

{

conn.Open();

//此处设置读取的超时,不然在海量数据时很容易超时

var c =

new

MySqlCommand(

'set net_write_timeout=9999999; set net_read_timeout=9999999'

, conn);

c.ExecuteNonQuery();

MySqlCommand rcmd =

new

MySqlCommand();

rcmd.Connection = conn;

rcmd.CommandText = @

'SELECT `f1`,`f2` FROM `table1`'

;

//设置命令的执行超时

rcmd.CommandTimeout = 99999999;

var myData = rcmd.ExecuteReader();

while

(myData.Read())

{

var f1 = myData.GetInt32(0);

var f2 = myData.GetString(1);

//这里做数据处理....

sqlBuilder.AppendFormat(

'({0},'

{1}

'),'

, f1,AddSlash(f2));

if

(sqlBuilder.Length >= 1024 * 1024)

//当然这里的1MB length的字符串并不等于 1MB的Packet。。。我知道:)

{

insertCmd.Execute(sqlBuilder.Remove(sqlBuilder.Length-1,1).ToString())

//移除逗号,然后执行

sqlBuilder.Clear();

//清空

sqlBuilder.Append(sqlHeader);

//在加上insert 头

}

}

}

|

好了,到这里 大概的优化后的高效查询、插入就完成了。 。

结语 。

总结下来,无非2个关键技术点,DataReader、SQL合并,都是一些老的技术啦.

其实,上面的代码只能称得上 高效 , 但是, 却非常的不优雅。。。甚至难看。。.

那那么问题来了? 如何进行重构呢? 通过重构抽象出一个可用的类,而不必关心字符串拼接这些乱七八糟的东西,支持多线程合并写入,最大限度提高写入IO, 我们在下一篇文章中再来谈谈.

最后此篇关于C#如何在海量数据下的高效读取写入MySQL的文章就讲到这里了,如果你想了解更多关于C#如何在海量数据下的高效读取写入MySQL的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

#include using namespace std; class C{ private: int value; public: C(){ value = 0;

这个问题已经有答案了: What is the difference between char a[] = ?string?; and char *p = ?string?;? (8 个回答) 已关闭

关闭。此题需要details or clarity 。目前不接受答案。 想要改进这个问题吗?通过 editing this post 添加详细信息并澄清问题. 已关闭 7 年前。 此帖子已于 8 个月

除了调试之外,是否有任何针对 c、c++ 或 c# 的测试工具,其工作原理类似于将独立函数复制粘贴到某个文本框,然后在其他文本框中输入参数? 最佳答案 也许您会考虑单元测试。我推荐你谷歌测试和谷歌模拟

我想在第二台显示器中移动一个窗口 (HWND)。问题是我尝试了很多方法,例如将分辨率加倍或输入负值,但它永远无法将窗口放在我的第二台显示器上。 关于如何在 C/C++/c# 中执行此操作的任何线索 最

我正在寻找 C/C++/C## 中不同类型 DES 的现有实现。我的运行平台是Windows XP/Vista/7。 我正在尝试编写一个 C# 程序,它将使用 DES 算法进行加密和解密。我需要一些实

很难说出这里要问什么。这个问题模棱两可、含糊不清、不完整、过于宽泛或夸夸其谈,无法以目前的形式得到合理的回答。如需帮助澄清此问题以便重新打开,visit the help center . 关闭 1

有没有办法强制将另一个 窗口置于顶部? 不是应用程序的窗口,而是另一个已经在系统上运行的窗口。 (Windows, C/C++/C#) 最佳答案 SetWindowPos(that_window_ha

假设您可以在 C/C++ 或 Csharp 之间做出选择,并且您打算在 Windows 和 Linux 服务器上运行同一服务器的多个实例,那么构建套接字服务器应用程序的最明智选择是什么? 最佳答案 如

你们能告诉我它们之间的区别吗? 顺便问一下,有什么叫C++库或C库的吗? 最佳答案 C++ 标准库 和 C 标准库 是 C++ 和 C 标准定义的库,提供给 C++ 和 C 程序使用。那是那些词的共同

下面的测试代码,我将输出信息放在注释中。我使用的是 gcc 4.8.5 和 Centos 7.2。 #include #include class C { public:

很难说出这里问的是什么。这个问题是含糊的、模糊的、不完整的、过于宽泛的或修辞性的,无法以目前的形式得到合理的回答。如需帮助澄清此问题以便重新打开它,visit the help center 。 已关

我的客户将使用名为 annoucement 的结构/类与客户通信。我想我会用 C++ 编写服务器。会有很多不同的类继承annoucement。我的问题是通过网络将这些类发送给客户端 我想也许我应该使用

我在 C# 中有以下函数: public Matrix ConcatDescriptors(IList> descriptors) { int cols = descriptors[0].Co

我有一个项目要编写一个函数来对某些数据执行某些操作。我可以用 C/C++ 编写代码,但我不想与雇主共享该函数的代码。相反,我只想让他有权在他自己的代码中调用该函数。是否可以?我想到了这两种方法 - 在

我使用的是编写糟糕的第 3 方 (C/C++) Api。我从托管代码(C++/CLI)中使用它。有时会出现“访问冲突错误”。这使整个应用程序崩溃。我知道我无法处理这些错误[如果指针访问非法内存位置等,

关闭。这个问题不符合Stack Overflow guidelines .它目前不接受答案。 我们不允许提问寻求书籍、工具、软件库等的推荐。您可以编辑问题,以便用事实和引用来回答。 关闭 7 年前。

已关闭。此问题不符合Stack Overflow guidelines 。目前不接受答案。 要求我们推荐或查找工具、库或最喜欢的场外资源的问题对于 Stack Overflow 来说是偏离主题的,因为

我有一些 C 代码,将使用 P/Invoke 从 C# 调用。我正在尝试为这个 C 函数定义一个 C# 等效项。 SomeData* DoSomething(); struct SomeData {

这个问题已经有答案了: Why are these constructs using pre and post-increment undefined behavior? (14 个回答) 已关闭 6

我是一名优秀的程序员,十分优秀!