- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章人脸检测之Retina FaceNet由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

retinaface 人脸检测算法 。

甜点 。

最近一直了解人脸检测的算法,所以也尝试学多人脸检测框架。所以这里将拿出来和大家分享一下 。

Retinaface 与普通的目标检测算法类似,在图片上预先设定好一些先验框,这些先验框会分布在整个图片上,网络内部结构会对这些先验框进行判断看是否包含人脸,同时也会调整位置进行调整并且给每一个先验框的一个置信度.

在 Retinaface 的先验框不但要获得人脸位置,还需要获得每一个人脸的五个关键点位置 。

接下来我们对 Retinaface 执行过程其实就是在图片上预先设定好先验框,网络的预测结果会判断先验框内部是否包含人脸并且对先验框进行调整获得预测框和五个人脸关键点.

主干特征提取网络 。

mobileNet 。

MobileNet 网络是由 google 团队在 2017 年提出的,专注移动端和嵌入式设备中轻量级 CNN 网络,在大大减少模型参数与运算量下,对于精度只是小幅度下降而已.

加强特征提取网络 FPN 和 SHH 。

FPN 构建就是生成特征图进行融合,通过上采样然后和上一层的有效特征层进行 。

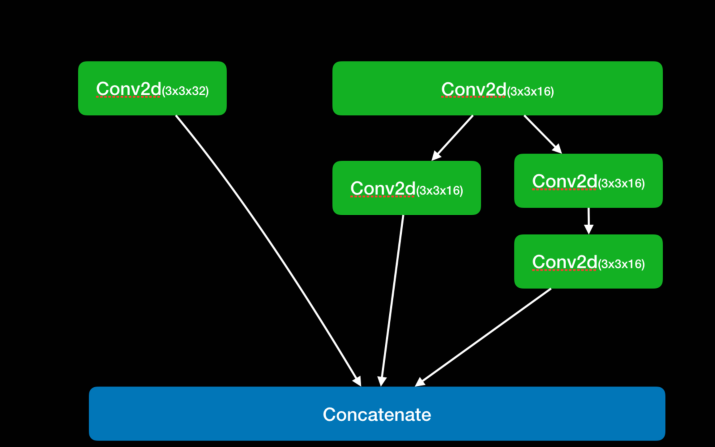

SSH 的思想非常简单,使用了 3 个并行结构,利用 3 x 3 卷积的堆叠代替 5 x 5 与 7 x 7 卷积的效果, 。

retina head 。

在主干网络输出的相当输出了不同大小网格,用于检测不同大小目标,先验框默认数量为 2,这些先验框用于检测目标,然后通过调整得到目标边界框.

FPN 。

class FPN(nn.Module): 。

def __init__(self,in_channels_list,out_channels): 。

super(FPN,self).__init__() 。

leaky = 0 。

if (out_channels <= 64): 。

leaky = 0.1 。

。

# 利用 1x1 卷积对获得的3有效特征层进行通道数的调整,输出通道数都为 64 。

self.output1 = conv_bn1X1(in_channels_list[0], out_channels, stride = 1, leaky = leaky) 。

self.output2 = conv_bn1X1(in_channels_list[1], out_channels, stride = 1, leaky = leaky) 。

self.output3 = conv_bn1X1(in_channels_list[2], out_channels, stride = 1, leaky = leaky) 。

。

self.merge1 = conv_bn(out_channels, out_channels, leaky = leaky) 。

self.merge2 = conv_bn(out_channels, out_channels, leaky = leaky) 。

。

def forward(self, input): 。

# names = list(input.keys()) 。

input = list(input.values()) 。

。

# 。

output1 = self.output1(input[0]) 。

output2 = self.output2(input[1]) 。

output3 = self.output3(input[2]) 。

。

# 对于最小特征层进行上采样来获得 up3 。

up3 = F.interpolate(output3, size=[output2.size(2), output2.size(3)], mode="nearest") 。

# 然后将最小特征层经过上采用获得结果和中间有效特征层进行相加 。

output2 = output2 + up3 。

# 进行 64 通道卷积进行特征整合 。

output2 = self.merge2(output2) 。

。

# 这个步骤和上面类似 。

up2 = F.interpolate(output2, size=[output1.size(2), output1.size(3)], mode="nearest") 。

output1 = output1 + up2 。

output1 = self.merge1(output1) 。

。

out = [output1, output2, output3] 。

return out 。

SSH 。

class SSH(nn.Module): 。

def __init__(self, in_channel, out_channel): 。

super(SSH, self).__init__() 。

assert out_channel % 4 == 0 。

leaky = 0 。

if (out_channel <= 64): 。

leaky = 0.1 。

self.conv3X3 = conv_bn_no_relu(in_channel, out_channel//2, stride=1) 。

。

# 用 2 个 3 x 3 的卷积来代替 5 x 5 的卷积 。

self.conv5X5_1 = conv_bn(in_channel, out_channel//4, stride=1, leaky = leaky) 。

self.conv5X5_2 = conv_bn_no_relu(out_channel//4, out_channel//4, stride=1) 。

# 使用 3 个 3 x 3 的卷积来代替 7 x 7 的卷积 。

self.conv7X7_2 = conv_bn(out_channel//4, out_channel//4, stride=1, leaky = leaky) 。

self.conv7x7_3 = conv_bn_no_relu(out_channel//4, out_channel//4, stride=1) 。

。

def forward(self, input): 。

conv3X3 = self.conv3X3(input) 。

。

conv5X5_1 = self.conv5X5_1(input) 。

conv5X5 = self.conv5X5_2(conv5X5_1) 。

。

conv7X7_2 = self.conv7X7_2(conv5X5_1) 。

conv7X7 = self.conv7x7_3(conv7X7_2) 。

。

# 堆叠 。

out = torch.cat([conv3X3, conv5X5, conv7X7], dim=1) 。

out = F.relu(out) 。

return out 。

先验框调整 。

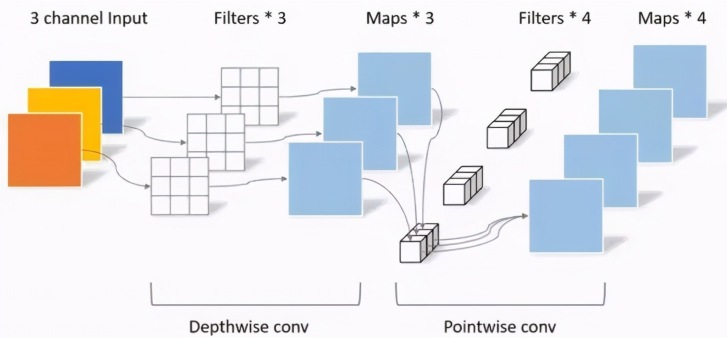

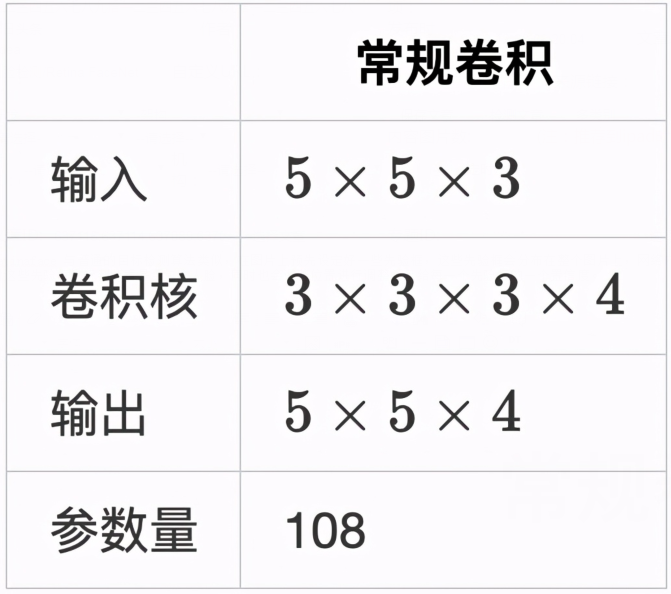

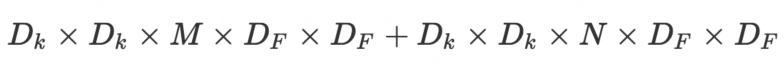

深度可分离卷积(Depthwise separable convolution) 。

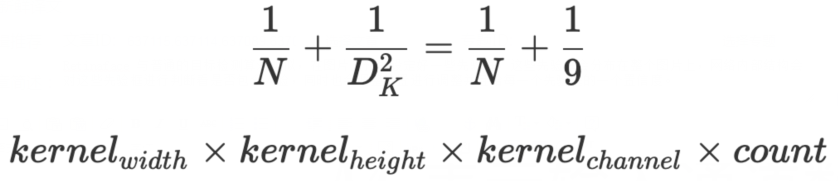

深度可分离卷积好处就是可以减少参数数量,从而降低运算的成本。经常出现在一些轻量级的网络结构(这些网络结构适合于移动设备或者嵌入式设备),深度可分离卷积是由DW(depthwise)和PW(pointwise)组成 。

这里我们通过对比普通卷积神经网络来解释,深度可分离卷积是如何减少参数 。

DW(Depthwise Conv) 。

我们先看图中 DW 部分,在这一个部分每一个卷积核通道数 1 ,每一个卷积核对应一个输入通道进行计算,那么可想而知输出通道数就与卷积核个数以及输入通道数量保持一致.

简单总结一下有以下两点 。

PW(Pointwise Conv) 。

PW 卷积核核之前普通卷积核类似,只不过 PW 卷积核大小为 1 ,卷积核深度与输入通道数相同,而卷积核个数核输出通道数相同 。

原文地址:https://www.toutiao.com/i6895666874189627915/ 。

最后此篇关于人脸检测之Retina FaceNet的文章就讲到这里了,如果你想了解更多关于人脸检测之Retina FaceNet的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

我正在寻找一种用C# 编写的人脸、情感和语音识别方法。对于人脸识别,我早期使用的是 Emgu CV,它不准确,而且在弱光条件下性能非常低。我还需要找到用户的情绪。不管是悲伤还是快乐。但我发现使用 Em

我正在尝试使用 Apple 的 ARKit 3.0(Reality Kit)设置面部 anchor 但失败了。1. 以前只支持前置摄像头。现在还是这样吗?2.如何让Reality Kit的ARView

当我调试人脸 API 时抛出以下错误。 UnknownHostException@830035410936}“java.net.UnknownHostException:无法解析主机“api.proj

用例如下 我们的系统中有面孔列表 用户将上传一张图片 我们希望显示与上传图像匹配的面孔列表,例如置信度 >0.8 现在查看how to ,我的理解如下 使用人脸检测API,我们需要首先上传所有图像,包

用例如下 我们的系统中有面孔列表 用户将上传一张图片 我们希望显示与上传图像匹配的面孔列表,例如置信度 >0.8 现在查看how to ,我的理解如下 使用人脸检测API,我们需要首先上传所有图像,包

我正在寻找一种完美的方法来平滑二进制图像的边缘。问题是二值图像似乎是一个阶梯状的边界,这对我进一步的掩蔽过程来说非常不愉快。 我附加了一个原始二进制图像,该图像将被转换为平滑边缘,并且我还提供了预期的

我需要一个 java 库来确定哪个图像是“人体”;这是一张“人脸”;这是一个“动物”;这是一个“风景”等等。 有这样的东西吗? 谢谢 最佳答案 我不认为那里有什么方便的东西。特别是因为你在这里有非常广

自从过去 2 天以来,我一直在努力弄清楚出了什么问题?我正在使用 Microsoft 认知服务开发用于人脸识别的 Cordova android 应用程序。为了拍摄图像,我使用了 Cordova Ca

我是一名优秀的程序员,十分优秀!