- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章浅谈Tensorflow 动态双向RNN的输出问题由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

tf.nn.bidirectional_dynamic_rnn() 。

函数:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

def

bidirectional_dynamic_rnn(

cell_fw,

# 前向RNN

cell_bw,

# 后向RNN

inputs,

# 输入

sequence_length

=

None

,

# 输入序列的实际长度(可选,默认为输入序列的最大长度)

initial_state_fw

=

None

,

# 前向的初始化状态(可选)

initial_state_bw

=

None

,

# 后向的初始化状态(可选)

dtype

=

None

,

# 初始化和输出的数据类型(可选)

parallel_iterations

=

None

,

swap_memory

=

False

,

time_major

=

False

,

# 决定了输入输出tensor的格式:如果为true, 向量的形状必须为 `[max_time, batch_size, depth]`.

# 如果为false, tensor的形状必须为`[batch_size, max_time, depth]`.

scope

=

None

)

|

其中, 。

outputs为(output_fw, output_bw),是一个包含前向cell输出tensor和后向cell输出tensor组成的元组。假设 。

time_major=false,tensor的shape为[batch_size, max_time, depth]。实验中使用tf.concat(outputs, 2)将其拼接.

output_states为(output_state_fw, output_state_bw),包含了前向和后向最后的隐藏状态的组成的元组.

output_state_fw和output_state_bw的类型为LSTMStateTuple.

LSTMStateTuple由(c,h)组成,分别代表memory cell和hidden state.

返回值:

|

1

|

元组:(outputs, output_states)

|

这里还有最后的一个小问题,output_states是一个元组的元组,处理方法是用c_fw,h_fw = output_state_fw和c_bw,h_bw = output_state_bw,最后再分别将c和h状态concat起来,用tf.contrib.rnn.LSTMStateTuple()函数生成decoder端的初始状态 。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

|

def

encoding_layer(rnn_size,sequence_length,num_layers,rnn_inputs,keep_prob):

# rnn_size: rnn隐层节点数量

# sequence_length: 数据的序列长度

# num_layers:堆叠的rnn cell数量

# rnn_inputs: 输入tensor

# keep_prob:

'''Create the encoding layer'''

for

layer

in

range

(num_layers):

with tf.variable_scope(

'encode_{}'

.

format

(layer)):

cell_fw

=

tf.contrib.rnn.LSTMCell(rnn_size,initializer

=

tf.random_uniform_initializer(

-

0.1

,

0.1

,seed

=

2

))

cell_fw

=

tf.contrib.rnn.DropoutWrapper(cell_fw,input_keep_prob

=

keep_prob)

cell_bw

=

tf.contrib.rnn.LSTMCell(rnn_size,initializer

=

tf.random_uniform_initializer(

-

0.1

,

0.1

,seed

=

2

))

cell_bw

=

tf.contrib.rnn.DropoutWrapper(cell_bw,input_keep_prob

=

keep_prob)

enc_output,enc_state

=

tf.nn.bidirectional_dynamic_rnn(cell_fw,cell_bw,

rnn_inputs,sequence_length,dtype

=

tf.float32)

# join outputs since we are using a bidirectional RNN

enc_output

=

tf.concat(enc_output,

2

)

return

enc_output,enc_state

|

tf.nn.dynamic_rnn() 。

tf.nn.dynamic_rnn的返回值有两个:outputs和state 。

为了描述输出的形状,先介绍几个变量,batch_size是输入的这批数据的数量,max_time就是这批数据中序列的最长长度,如果输入的三个句子,那max_time对应的就是最长句子的单词数量,cell.output_size其实就是rnn cell中神经元的个数.

例子来说明其用法,假设你的RNN的输入input是[2,20,128],其中2是batch_size,20是文本最大长度,128是embedding_size,可以看出,有两个example,我们假设第二个文本长度只有13,剩下的7个是使用0-padding方法填充的。dynamic返回的是两个参数:outputs,state,其中outputs是[2,20,128],也就是每一个迭代隐状态的输出,state是由(c,h)组成的tuple,均为[batch,128].

outputs. outputs是一个tensor 。

如果time_major==True,outputs形状为 [max_time, batch_size, cell.output_size ](要求rnn输入与rnn输出形状保持一致) 。

如果time_major==False(默认),outputs形状为 [ batch_size, max_time, cell.output_size ] 。

state. state是一个tensor。state是最终的状态,也就是序列中最后一个cell输出的状态。一般情况下state的形状为 [batch_size, cell.output_size ],但当输入的cell为BasicLSTMCell时,state的形状为[2,batch_size, cell.output_size ],其中2也对应着LSTM中的cell state和hidden state.

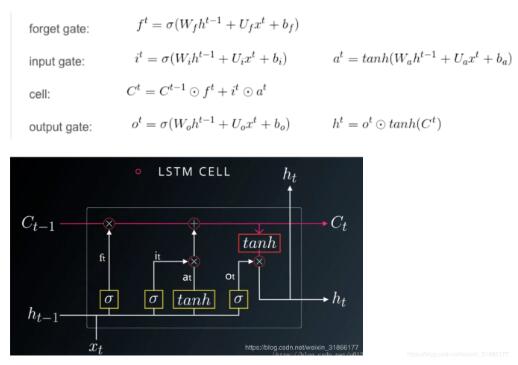

这里有关于LSTM的结构问题:

以上这篇浅谈Tensorflow 动态双向RNN的输出问题就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持我.

原文链接:https://blog.csdn.net/weixin_31866177/article/details/81905226 。

最后此篇关于浅谈Tensorflow 动态双向RNN的输出问题的文章就讲到这里了,如果你想了解更多关于浅谈Tensorflow 动态双向RNN的输出问题的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

我想将模型及其各自训练的权重从 tensorflow.js 转换为标准 tensorflow,但无法弄清楚如何做到这一点,tensorflow.js 的文档对此没有任何说明 我有一个 manifest

我有一个运行良好的 TF 模型,它是用 Python 和 TFlearn 构建的。有没有办法在另一个系统上运行这个模型而不安装 Tensorflow?它已经经过预训练,所以我只需要通过它运行数据。 我

当执行 tensorflow_model_server 二进制文件时,它需要一个模型名称命令行参数,model_name。 如何在训练期间指定模型名称,以便在运行 tensorflow_model_s

我一直在 R 中使用标准包进行生存分析。我知道如何在 TensorFlow 中处理分类问题,例如逻辑回归,但我很难将其映射到生存分析问题。在某种程度上,您有两个输出向量而不是一个输出向量(time_t

Torch7 has a library for generating Gaussian Kernels在一个固定的支持。 Tensorflow 中有什么可比的吗?我看到 these distribu

在Keras中我们可以简单的添加回调,如下所示: self.model.fit(X_train,y_train,callbacks=[Custom_callback]) 回调在doc中定义,但我找不到

我正在寻找一种在 tensorflow 中有条件打印节点的方法,使用下面的示例代码行,其中每 10 个循环计数,它应该在控制台中打印一些东西。但这对我不起作用。谁能建议? 谢谢,哈米德雷萨, epsi

我想使用 tensorflow object detection API 创建我自己的 .tfrecord 文件,并将它们用于训练。该记录将是原始数据集的子集,因此模型将仅检测特定类别。我不明白也无法

我在 TensorFlow 中训练了一个聊天机器人,想保存模型以便使用 TensorFlow.js 将其部署到 Web。我有以下内容 checkpoint = "./chatbot_weights.c

我最近开始学习 Tensorflow,特别是我想使用卷积神经网络进行图像分类。我一直在看官方仓库中的android demo,特别是这个例子:https://github.com/tensorflow

我目前正在研究单图像超分辨率,并且我设法卡住了现有的检查点文件并将其转换为 tensorflow lite。但是,使用 .tflite 文件执行推理时,对一张图像进行上采样所需的时间至少是使用 .ck

我注意到 tensorflow 的 api 中已经有批量标准化函数。我不明白的一件事是如何更改训练和测试之间的程序? 批量归一化在测试和训练期间的作用不同。具体来说,在训练期间使用固定的均值和方差。

我创建了一个模型,该模型将 Mobilenet V2 应用于 Google colab 中的卷积基础层。然后我使用这个命令转换它: path_to_h5 = working_dir + '/Tenso

代码取自:- http://adventuresinmachinelearning.com/python-tensorflow-tutorial/ import tensorflow as tf fr

好了,所以我准备在Tensorflow中运行 tf.nn.softmax_cross_entropy_with_logits() 函数。 据我了解,“logit”应该是概率的张量,每个对应于某个像素的

tensorflow 服务构建依赖于大型 tensorflow ;但我已经成功构建了 tensorflow。所以我想用它。我做这些事情:我更改了 tensorflow 服务 WORKSPACE(org

Tensoflow 嵌入层 ( https://www.tensorflow.org/api_docs/python/tf/keras/layers/Embedding ) 易于使用, 并且有大量的文

我正在尝试使用非常大的数据集(比我的内存大得多)训练 Tensorflow 模型。 为了充分利用所有可用的训练数据,我正在考虑将它们分成几个小的“分片”,并一次在一个分片上进行训练。 经过一番研究,我

根据 Sutton 的书 - Reinforcement Learning: An Introduction,网络权重的更新方程为: 其中 et 是资格轨迹。 这类似于带有额外 et 的梯度下降更新。

如何根据条件选择执行图表的一部分? 我的网络有一部分只有在 feed_dict 中提供占位符值时才会执行.如果未提供该值,则采用备用路径。我该如何使用 tensorflow 来实现它? 以下是我的代码

我是一名优秀的程序员,十分优秀!