- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章Nginx整合Kafka的方法示例由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

背景 。

nginx-kafka-module是nginx的一个插件,可以将kafka整合到nginx中,便于web项目中前端页面埋点数据的收集,如前端页面设置了埋点,即可将用户的一些访问和请求数据通过http请求直接发送到消息中间件kafka中,后端可以通过程序消费kafka中的消息来进行实时的计算。比如通过SparkStream来实时的消费Kafka中的数据来分析用户PV,UV、用户的一些行为及页面的漏斗模型转化率,来更好的对系统进行优化或者对来访用户进行实时动态的分析.

具体整合步骤 。

1.安装git 。

|

1

|

yum

install

-y git

|

2.切换到/usr/local/src目录,然后将kafka的c客户端源码clone到本地 。

|

1

2

|

cd

/usr/local/src

git clone https:

//github

.com

/edenhill/librdkafka

|

3.进入到librdkafka,然后进行编译 。

|

1

2

3

4

|

cd

librdkafka

yum

install

-y gcc gcc-c++ pcre-devel zlib-devel

.

/configure

make

&&

make

install

|

4.安装nginx整合kafka的插件,进入到/usr/local/src,clone nginx整合kafka的源码 。

|

1

2

|

cd

/usr/local/src

git clone https:

//github

.com

/brg-liuwei/ngx_kafka_module

|

5.进入到nginx的源码包目录下 (编译nginx,然后将将插件同时编译) 。

|

1

2

3

|

cd

/usr/local/src/nginx-1

.12.2

.

/configure

--add-module=

/usr/local/src/ngx_kafka_module/

make

&&

make

install

|

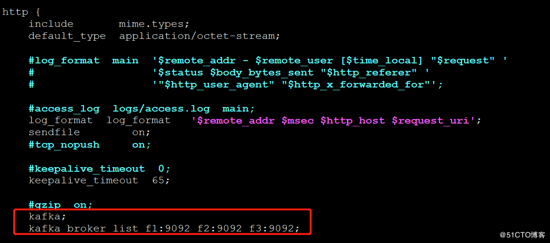

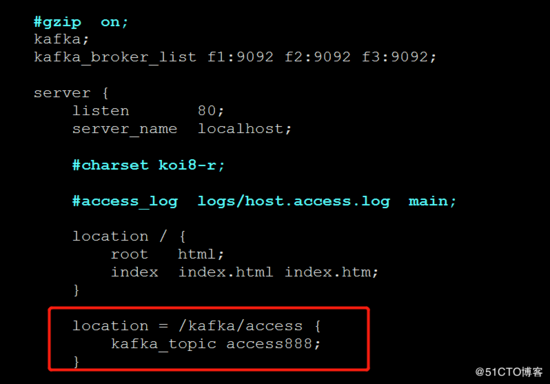

6.修改nginx的配置文件:设置一个location和kafaka的topic,详情请查看当前目录的nginx.conf 。

|

1

2

3

4

5

6

7

|

#添加配置(2处)

kafka;

kafka_broker_list f1:9092 f2:9092 f3:9092;

location =

/kafka/access

{

kafka_topic access888;

}

|

如下图:

7.启动zk和kafka集群(创建topic) 。

|

1

2

|

zkServer.sh start

kafka-server-start.sh -daemon config/server.properties

|

8.启动nginx,报错,找不到kafka.so.1的文件 。

error while loading shared libraries: librdkafka.so.1: cannot open shared object file: No such file or directory 。

9.加载so库 。

|

1

2

3

4

|

#开机加载/usr/local/lib下面的库

echo "/usr/local/lib" >> /etc/ld.so.conf

#手动加载

ldconfig

|

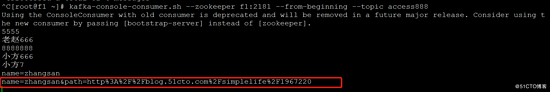

10.测试,向nginx中写入数据,然后观察kafka的消费者能不能消费到数据 。

|

1

2

|

curl http:

//localhost/kafka/access

-d

"message send to kafka topic"

curl http:

//localhost/kafka/access

-d

"小伟666"

测试

|

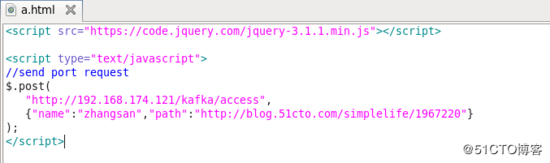

也可以模拟页面埋点请求接口来发送信息:

后台Kafka消费信息如图:

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持我.

原文链接:http://blog.51cto.com/simplelife/2307998 。

最后此篇关于Nginx整合Kafka的方法示例的文章就讲到这里了,如果你想了解更多关于Nginx整合Kafka的方法示例的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

我在 Windows 机器上启动 Kafka-Server 时出现以下错误。我已经从以下链接下载了 Scala 2.11 - kafka_2.11-2.1.0.tgz:https://kafka.ap

关于Apache-Kafka messaging queue . 我已经从 Kafka 下载页面下载了 Apache Kafka。我已将其提取到 /opt/apache/installed/kafka

假设我有 Kafka 主题 cars。 我还有一个消费者组 cars-consumers 订阅了 cars 主题。 cars-consumers 消费者组当前位于偏移量 89。 当我现在删除 cars

我想知道什么最适合我:Kafka 流或 Kafka 消费者 api 或 Kafka 连接? 我想从主题中读取数据,然后进行一些处理并写入数据库。所以我编写了消费者,但我觉得我可以编写 Kafka 流应

我曾研究过一些 Kafka 流应用程序和 Kafka 消费者应用程序。最后,Kafka流不过是消费来自Kafka的实时事件的消费者。因此,我无法弄清楚何时使用 Kafka 流或为什么我们应该使用

Kafka Acknowledgement 和 Kafka 消费者 commitSync() 有什么区别 两者都用于手动偏移管理,并希望两者同步工作。 请协助 最佳答案 使用 spring-kafka

如何在 Kafka 代理上代理 Apache Kafka 生产者请求,并重定向到单独的 Kafka 集群? 在我的特定情况下,无法更新写入此集群的客户端。这意味着,执行以下操作是不可行的: 更新客户端

我需要在 Kafka 10 中命名我的消费者,就像我在 Kafka 8 中所做的一样,因为我有脚本可以嗅出并进一步使用这些信息。 显然,consumer.id 的默认命名已更改(并且现在还单独显示了

1.概述 我们会看到zk的数据中有一个节点/log_dir_event_notification/,这是一个序列号持久节点 这个节点在kafka中承担的作用是: 当某个Broker上的LogDir出现

我正在使用以下命令: bin/kafka-console-producer.sh --broker-list localhost:9092 --topic test.topic --property

我很难理解 Java Spring Boot 中的一些 Kafka 概念。我想针对在服务器上运行的真实 Kafka 代理测试消费者,该服务器有一些生产者已将数据写入/已经将数据写入各种主题。我想与服务

我的场景是我使用了很多共享前缀的 Kafka 主题(例如 house.door, house.room ) 并使用 Kafka 流正则表达式主题模式 API 使用所有主题。 一切看起来都不错,我得到了

有没有办法以编程方式获取kafka集群的版本?例如,使用AdminClient应用程序接口(interface)。 我想在消费者/生产者应用程序中识别 kafka 集群的版本。 最佳答案 目前无法检索

每当我尝试重新启动 kafka 时,它都会出现以下错误。一旦我删除/tmp/kafka-logs 它就会得到解决,但它也会删除我的主题。 有办法解决吗? ERROR Error while

我是 Apache Kafka 的新用户,我仍在了解内部结构。 在我的用例中,我需要从 Kafka Producer 客户端动态增加主题的分区数。 我发现了其他类似的 questions关于增加分区大

正如 Kafka 文档所示,一种方法是通过 kafka.tools.MirrorMaker 来实现这一点。但是,我需要将一个主题(比如 测试 带 1 个分区)(其内容和元数据)从生产环境复制到没有连接

我已经在集群中配置了 3 个 kafka,我正在尝试与 spring-kafka 一起使用。 但是在我杀死 kafka 领导者之后,我无法将其他消息发送到队列中。 我将 spring.kafka.bo

我的 kafka sink 连接器从多个主题(配置了 10 个任务)读取,并处理来自所有主题的 300 条记录。根据每个记录中保存的信息,连接器可以执行某些操作。 以下是触发器记录中键值对的示例: "

我有以下 kafka 流代码 public class KafkaStreamHandler implements Processor{ private ProcessorConte

当 kafka-streams 应用程序正在运行并且 Kafka 突然关闭时,应用程序进入“等待”模式,发送警告日志的消费者和生产者线程无法连接,当 Kafka 回来时,一切都应该(理论上)去恢复正常

我是一名优秀的程序员,十分优秀!