- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章pyTorch深入学习梯度和Linear Regression实现由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

PyTorch的数据结构是tensor,它有个属性叫做requires_grad,设置为True以后,就开始track在其上的所有操作,前向计算完成后,可以通过backward来进行梯度回传。 评估模型的时候我们并不需要梯度回传,使用with torch.no_grad() 将不需要梯度的代码段包裹起来。每个Tensor都有一个.grad_fn属性,该属性即创建该Tensor的Function,直接用构造的tensor返回None,否则是生成该tensor的操作.

tensor(data, *, dtype=None, device=None, requires_grad=False, pin_memory=False) -> Tensor#require_grad默认是false,下面我们将显式的开启x = torch.tensor([1,2,3],requires_grad=True,dtype=torch.float)

注意只有数据类型是浮点型和complex类型才能require梯度,所以这里显示指定dtype为torch.float32 。

x = torch.tensor([1,2,3],requires_grad=True,dtype=torch.float32)> tensor([1.,2.,3.],grad_fn=None)y = x + 2> tensor([3.,4.,5.],grad_fn=<AddBackward0>)z = y * y * 3> tensor([3.,4.,5.],grad_fn=<MulBackward0>)

像x这种直接创建的,没有grad_fn,被称为叶子结点。grad_fn记录了一个个基本操作用来进行梯度计算的。 关于梯度回传计算看下面一个例子 。

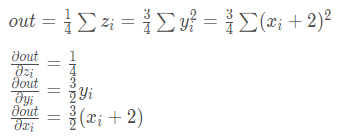

x = torch.ones((2,2),requires_grad=True)> tensor([[1.,1.],> [1.,1.]],requires_grad=True)y = x + 2z = y * y * 3out = z.mean()#out是一个标量,无需指定求偏导的变量out.backward()x.grad> tensor([[4.500,4.500],> [4.500,4.500]])#每次计算梯度前,需要将梯度清零,否则会累加x.grad.data.zero_()

值得注意的是只有叶子节点的梯度在回传时才会被计算,也就是说,上面的例子中拿不到y和z的grad。 来看一个中断求导的例子 。

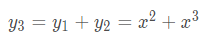

x = torch.tensor(1.,requires_grad=True)y1 = x ** 2with torch.no_grad() y2 = x ** 3y3 = y1 + y2y3.backward()print(x.grad)> 2

本来梯度应该为5的,但是由于y2被with torch.no_grad()包裹,在梯度计算的时候不会被追踪.

如果我们想要修改某个tensor的数值但是又不想被autograd记录,那么需要使用对x.data进行操作就行这也是一个张量.

。

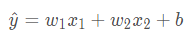

利用线性回归来预测一栋房屋的价格,价格取决于很多feature,这里简化问题,假设价格只取决于两个因素,面积(平方米)和房龄(年) 。

x1代表面积,x2代表房龄,售出价格为y 。

。

。

假设我们的样本数量为1000个,每个数据包括两个features,则数据为1000 * 2的2-d张量,用正太分布来随机取值。 labels是房屋的价格,长度为1000的一维张量。 真实w和b提前把值定好,然后再取一个干扰量 δ \delta δ(也用高斯分布取值,用来模拟真实数据集中的偏差) 。

num_features = 2#两个特征num_examples = 1000 #样本个数w = torch.normal(0,1,(num_features,1))b = torch.tensor(4.2)samples = torch.normal(0,1,(num_examples,num_features))labels = samples.matmul(w) + bnoise = torch.normal(0,.01,labels.shape)labels += noise

。

import randomdef data_iter(samples,labels,batch_size): num_samples = samples.shape[0] #获得batch轴的长度 indices = [i for i in range(num_samples)] random.shuffle(indices)#将索引数组原地打乱 for i in range(0,num_samples,batch_size): j = torch.LongTensor(indices[i:min(i+batch_size,num_samples)]) yield samples.index_select(0,j),labels(0,j)

torch.index_select(dim,index) dim表示tensor的轴,index是一个tensor,里面包含的是索引.

。

def loss_function(predict,labels): loss = (predict,labels)** 2 / 2 return loss.mean()

定义优化器 。

def loss_function(predict,labels): loss = (predict,labels)** 2 / 2 return loss.mean()

开始训练 。

w = torch.normal(0.,1.,(num_features,1),requires_grad=True)b = torch.zero(0.,dtype=torch.float32,requires_grad=True)batch_size = 100for epoch in range(10): for data, label in data_iter(samples,labels,batch_size): predict = data.matmul(w) + b loss = loss_function(predict,label) loss.backward() optimizer([w,b],0.05) w.grad.data.zero_() b.grad.data.zero_()

以上就是pyTorch深入学习梯度和Linear Regression实现的详细内容,更多关于pyTorch实现梯度和Linear Regression的资料请关注我其它相关文章! 。

原文链接:https://blog.csdn.net/qq_43152622/article/details/116792624 。

最后此篇关于pyTorch深入学习梯度和Linear Regression实现的文章就讲到这里了,如果你想了解更多关于pyTorch深入学习梯度和Linear Regression实现的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

已关闭。此问题不符合Stack Overflow guidelines 。目前不接受答案。 这个问题似乎与 help center 中定义的范围内的编程无关。 . 已关闭 3 年前。 此帖子于去年编辑

据我所知,在使用 GPU 训练和验证模型时,GPU 内存主要用于加载数据,向前和向后。据我所知,我认为 GPU 内存使用应该相同 1) 训练前,2) 训练后,3) 验证前,4) 验证后。但在我的例子中

我正在尝试在 PyTorch 中将两个复数矩阵相乘,看起来 the torch.matmul functions is not added yet to PyTorch library for com

我正在尝试定义二分类问题的损失函数。但是,目标标签不是硬标签0,1,而是0~1之间的一个 float 。 Pytorch 中的 torch.nn.CrossEntropy 不支持软标签,所以我想自己写

我正在尝试让 PyTorch 与 DataLoader 一起工作,据说这是处理小批量的最简单方法,在某些情况下这是获得最佳性能所必需的。 DataLoader 需要一个数据集作为输入。 大多数关于 D

Pytorch Dataloader 的迭代顺序是否保证相同(在温和条件下)? 例如: dataloader = DataLoader(my_dataset, batch_size=4,

PyTorch 的负对数似然损失,nn.NLLLoss定义为: 因此,如果以单批处理的标准重量计算损失,则损失的公式始终为: -1 * (prediction of model for correct

在PyTorch中,new_ones()与ones()有什么区别。例如, x2.new_ones(3,2, dtype=torch.double) 与 torch.ones(3,2, dtype=to

假设我有一个矩阵 src带形状(5, 3)和一个 bool 矩阵 adj带形状(5, 5)如下, src = tensor([[ 0, 1, 2], [ 3, 4,

我想知道如果不在第 4 行中使用“for”循环,下面的代码是否有更有效的替代方案? import torch n, d = 37700, 7842 k = 4 sample = torch.cat([

我有三个简单的问题。 如果我的自定义损失函数不可微会发生什么? pytorch 会通过错误还是做其他事情? 如果我在我的自定义函数中声明了一个损失变量来表示模型的最终损失,我应该放 requires_

我想知道 PyTorch Parameter 和 Tensor 的区别? 现有answer适用于使用变量的旧 PyTorch? 最佳答案 这就是 Parameter 的全部想法。类(附加)在单个图像中

给定以下张量(这是网络的结果 [注意 grad_fn]): tensor([121., 241., 125., 1., 108., 238., 125., 121., 13., 117., 12

什么是__constants__在 pytorch class Linear(Module):定义于 https://pytorch.org/docs/stable/_modules/torch/nn

我在哪里可以找到pytorch函数conv2d的源代码? 它应该在 torch.nn.functional 中,但我只找到了 _add_docstr 行, 如果我搜索conv2d。我在这里看了: ht

如 documentation 中所述在 PyTorch 中,Conv2d 层使用默认膨胀为 1。这是否意味着如果我想创建一个简单的 conv2d 层,我必须编写 nn.conv2d(in_chann

我阅读了 Pytorch 的源代码,发现它没有实现 convolution_backward 很奇怪。函数,唯一的 convolution_backward_overrideable 函数是直接引发错

我对编码真的很陌生,现在我正在尝试将我的标签变成一种热门编码。我已经完成将 np.array 传输到张量,如下所示 tensor([4., 4., 4., 4., 4., 4., 4., 4., 4.

我正在尝试实现 text classification model使用CNN。据我所知,对于文本数据,我们应该使用一维卷积。我在 pytorch 中看到了一个使用 Conv2d 的示例,但我想知道如何

我有一个多标签分类问题,我正试图用 Pytorch 中的 CNN 解决这个问题。我有 80,000 个训练示例和 7900 个类;每个示例可以同时属于多个类,每个示例的平均类数为 130。 问题是我的

我是一名优秀的程序员,十分优秀!