- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章用scikit-learn和pandas学习线性回归的方法由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

对于想深入了解线性回归的童鞋,这里给出一个完整的例子,详细学完这个例子,对用scikit-learn来运行线性回归,评估模型不会有什么问题了.

1. 获取数据,定义问题 。

没有数据,当然没法研究机器学习啦。:) 这里我们用uci大学公开的机器学习数据来跑线性回归.

数据的介绍在这:http://archive.ics.uci.edu/ml/datasets/Combined+Cycle+Power+Plant 。

数据的下载地址在这:http://archive.ics.uci.edu/ml/machine-learning-databases/00294/ 。

里面是一个循环发电场的数据,共有9568个样本数据,每个数据有5列,分别是:at(温度), v(压力), ap(湿度), rh(压强), pe(输出电力)。我们不用纠结于每项具体的意思.

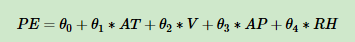

我们的问题是得到一个线性的关系,对应pe是样本输出,而at/v/ap/rh这4个是样本特征, 机器学习的目的就是得到一个线性回归模型,即

pe=θ 0 +θ 1 ∗at+θ 2 ∗v+θ 3 ∗ap+θ 4 ∗rh 而需要学习的,就是\(\theta_0, \theta_1, \theta_2, \theta_3, \theta_4\)这5个参数.

2. 整理数据 。

下载后的数据可以发现是一个压缩文件,解压后可以看到里面有一个xlsx文件,我们先用excel把它打开,接着“另存为“”csv格式,保存下来,后面我们就用这个csv来运行线性回归.

打开这个csv可以发现数据已经整理好,没有非法数据,因此不需要做预处理。但是这些数据并没有归一化,也就是转化为均值0,方差1的格式。也不用我们搞,后面scikit-learn在线性回归时会先帮我们把归一化搞定.

好了,有了这个csv格式的数据,我们就可以大干一场了.

3.用pandas来读取数据 。

我们先打开ipython notebook,新建一个notebook。当然也可以直接在python的交互式命令行里面输入,不过还是推荐用notebook。下面的例子和输出我都是在notebook里面跑的.

先把要导入的库声明了:

|

1

2

3

4

5

|

import

matplotlib.pyplot as plt

%

matplotlib inline

import

numpy as np

import

pandas as pd

from

sklearn

import

datasets, linear_model

|

接着我们就可以用pandas读取数据了:

|

1

2

|

# read_csv里面的参数是csv在你电脑上的路径,此处csv文件放在notebook运行目录下面的ccpp目录里

data

=

pd.read_csv(

'.\ccpp\ccpp.csv'

)

|

测试下读取数据是否成功:

|

1

2

|

#读取前五行数据,如果是最后五行,用data.tail()

data.head()

|

运行结果应该如下,看到下面的数据,说明pandas读取数据成功:

。

| at | v | ap | rh | pe | |

|---|---|---|---|---|---|

| 0 | 8.34 | 40.77 | 1010.84 | 90.01 | 480.48 |

| 1 | 23.64 | 58.49 | 1011.40 | 74.20 | 445.75 |

| 2 | 29.74 | 56.90 | 1007.15 | 41.91 | 438.76 |

| 3 | 19.07 | 49.69 | 1007.22 | 76.79 | 453.09 |

| 4 | 11.80 | 40.66 | 1017.13 | 97.20 | 464.43 |

。

4.准备运行算法的数据 。

我们看看数据的维度:

|

1

|

data.shape

|

结果是(9568, 5)。说明我们有9568个样本,每个样本有5列.

现在我们开始准备样本特征x,我们用at, v,ap和rh这4个列作为样本特征.

|

1

2

|

x

=

data[[

'at'

,

'v'

,

'ap'

,

'rh'

]]

x.head()

|

可以看到x的前五条输出如下:

。

| at | v | ap | rh | |

|---|---|---|---|---|

| 0 | 8.34 | 40.77 | 1010.84 | 90.01 |

| 1 | 23.64 | 58.49 | 1011.40 | 74.20 |

| 2 | 29.74 | 56.90 | 1007.15 | 41.91 |

| 3 | 19.07 | 49.69 | 1007.22 | 76.79 |

| 4 | 11.80 | 40.66 | 1017.13 | 97.20 |

。

接着我们准备样本输出y, 我们用pe作为样本输出.

|

1

2

|

y

=

data[[

'pe'

]]

y.head()

|

可以看到y的前五条输出如下:

。

| pe | |

|---|---|

| 0 | 480.48 |

| 1 | 445.75 |

| 2 | 438.76 |

| 3 | 453.09 |

| 4 | 464.43 |

。

5. 划分训练集和测试集 。

我们把x和y的样本组合划分成两部分,一部分是训练集,一部分是测试集,代码如下:

|

1

2

|

from

sklearn.cross_validation

import

train_test_split

x_train, x_test, y_train, y_test

=

train_test_split(x, y, random_state

=

1

)

|

查看下训练集和测试集的维度:

|

1

2

3

4

|

print

x_train.shape

print

y_train.shape

print

x_test.shape

print

y_test.shape

|

结果如下:

(7176, 4) (7176, 1) (2392, 4) (2392, 1) 。

可以看到75%的样本数据被作为训练集,25%的样本被作为测试集.

6. 运行scikit-learn的线性模型 。

终于到了临门一脚了,我们可以用scikit-learn的线性模型来拟合我们的问题了。scikit-learn的线性回归算法使用的是最小二乘法来实现的。代码如下:

|

1

2

3

|

from

sklearn.linear_model

import

linearregression

linreg

=

linearregression()

linreg.fit(x_train, y_train)

|

拟合完毕后,我们看看我们的需要的模型系数结果:

|

1

2

|

print

linreg.intercept_

print

linreg.coef_

|

输出如下:

[ 447.06297099] [[-1.97376045 -0.23229086 0.0693515 -0.15806957]] 。

这样我们就得到了在步骤1里面需要求得的5个值。也就是说pe和其他4个变量的关系如下:

7. 模型评价 。

我们需要评估我们的模型的好坏程度,对于线性回归来说,我们一般用均方差(mean squared error, mse)或者均方根差(root mean squared error, rmse)在测试集上的表现来评价模型的好坏.

我们看看我们的模型的mse和rmse,代码如下:

|

1

2

3

4

5

6

7

|

#模型拟合测试集

y_pred

=

linreg.predict(x_test)

from

sklearn

import

metrics

# 用scikit-learn计算mse

print

"mse:"

,metrics.mean_squared_error(y_test, y_pred)

# 用scikit-learn计算rmse

print

"rmse:"

,np.sqrt(metrics.mean_squared_error(y_test, y_pred))

|

输出如下:

mse: 20.0804012021 rmse: 4.48111606657 。

得到了mse或者rmse,如果我们用其他方法得到了不同的系数,需要选择模型时,就用mse小的时候对应的参数.

比如这次我们用at, v,ap这3个列作为样本特征。不要rh, 输出仍然是pe。代码如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

|

x

=

data[[

'at'

,

'v'

,

'ap'

]]

y

=

data[[

'pe'

]]

x_train, x_test, y_train, y_test

=

train_test_split(x, y, random_state

=

1

)

from

sklearn.linear_model

import

linearregression

linreg

=

linearregression()

linreg.fit(x_train, y_train)

#模型拟合测试集

y_pred

=

linreg.predict(x_test)

from

sklearn

import

metrics

# 用scikit-learn计算mse

print

"mse:"

,metrics.mean_squared_error(y_test, y_pred)

# 用scikit-learn计算rmse

print

"rmse:"

,np.sqrt(metrics.mean_squared_error(y_test, y_pred))

|

输出如下:

mse: 23.2089074701 rmse: 4.81756239919 。

可以看出,去掉rh后,模型拟合的没有加上rh的好,mse变大了.

8. 交叉验证 。

我们可以通过交叉验证来持续优化模型,代码如下,我们采用10折交叉验证,即cross_val_predict中的cv参数为10:

|

1

2

3

4

5

6

7

8

|

x

=

data[[

'at'

,

'v'

,

'ap'

,

'rh'

]]

y

=

data[[

'pe'

]]

from

sklearn.model_selection

import

cross_val_predict

predicted

=

cross_val_predict(linreg, x, y, cv

=

10

)

# 用scikit-learn计算mse

print

"mse:"

,metrics.mean_squared_error(y, predicted)

# 用scikit-learn计算rmse

print

"rmse:"

,np.sqrt(metrics.mean_squared_error(y, predicted))

|

输出如下:

mse: 20.7955974619 rmse: 4.56021901469 。

可以看出,采用交叉验证模型的mse比第6节的大,主要原因是我们这里是对所有折的样本做测试集对应的预测值的mse,而第6节仅仅对25%的测试集做了mse。两者的先决条件并不同.

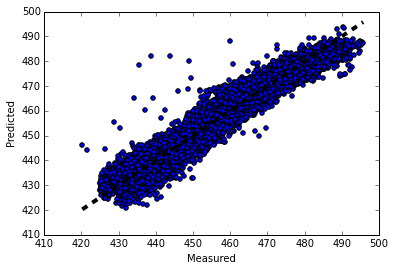

9. 画图观察结果 。

这里画图真实值和预测值的变化关系,离中间的直线y=x直接越近的点代表预测损失越低。代码如下:

|

1

2

3

4

5

6

|

fig, ax

=

plt.subplots()

ax.scatter(y, predicted)

ax.plot([y.

min

(), y.

max

()], [y.

min

(), y.

max

()],

'k--'

, lw

=

4

)

ax.set_xlabel(

'measured'

)

ax.set_ylabel(

'predicted'

)

plt.show()

|

输出的图像如下

完整的jupyter-notebook代码参看我的github.

以上就是用scikit-learn和pandas学习线性回归的过程,希望可以对初学者有所帮助。也希望大家多多支持我.

原文链接:https://www.cnblogs.com/pinard/p/6016029.html 。

最后此篇关于用scikit-learn和pandas学习线性回归的方法的文章就讲到这里了,如果你想了解更多关于用scikit-learn和pandas学习线性回归的方法的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

来自文档: sklearn.preprocessing.MinMaxScaler.min_ : ndarray, shape (n_features,) Per feature adjustment

这是我的数据:(我重置了索引。日期应该是索引) Date A B C D 0 2013-10-07 -0.002

我正在构建一个分类器,通过贷款俱乐部数据,选择最好的 X 笔贷款。我训练了一个随机森林,并创建了通常的 ROC 曲线、混淆矩阵等。 混淆矩阵将分类器的预测(森林中树木的多数预测)作为参数。但是,我希望

是否有类似于 的 scikit-learn 方法/类元成本 在 Weka 或其他实用程序中实现的算法以执行常量敏感分析? 最佳答案 不,没有。部分分类器提供 class_weight和 sample_

我发现使用相同数据的两种交叉验证技术之间的分类性能存在差异。我想知道是否有人可以阐明这一点。 方法一:cross_validation.train_test_split 方法 2:分层折叠。 具有相同

我正在查看 scikit-learn 文档中的这个示例:http://scikit-learn.org/0.18/auto_examples/model_selection/plot_nested_c

我想训练一个具有很多标称属性的数据集。我从一些帖子中注意到,要转换标称属性必须将它们转换为重复的二进制特征。另外据我所知,这样做在概念上会使数据集稀疏。我也知道 scikit-learn 使用稀疏矩阵

我正在尝试在 scikit-learn (sklearn.feature_selection.SelectKBest) 中通过卡方方法进行特征选择。当我尝试将其应用于多标签问题时,我收到此警告: 用户

有几种算法可以构建决策树,例如 CART(分类和回归树)、ID3(迭代二分法 3)等 scikit-learn 默认使用哪种决策树算法? 当我查看一些决策树 python 脚本时,它神奇地生成了带有

我正在尝试在 scikit-learn (sklearn.feature_selection.SelectKBest) 中通过卡方方法进行特征选择。当我尝试将其应用于多标签问题时,我收到此警告: 用户

有几种算法可以构建决策树,例如 CART(分类和回归树)、ID3(迭代二分法 3)等 scikit-learn 默认使用哪种决策树算法? 当我查看一些决策树 python 脚本时,它神奇地生成了带有

有没有办法让 scikit-learn 中的 fit 方法有一个进度条? 是否可以包含自定义的类似 Pyprind 的内容? ? 最佳答案 如果您使用 verbose=1 初始化模型调用前 fit你应

我正在尝试使用 grisSearchCV 在 scikit-learn 中拟合一些模型,并且我想使用“一个标准错误”规则来选择最佳模型,即从分数在 1 以内的模型子集中选择最简约的模型最好成绩的标准误

我有一个预定义的决策树,它是根据基于知识的拆分构建的,我想用它来进行预测。我可以尝试从头开始实现决策树分类器,但那样我就无法在 Scikit 函数中使用 predict 等内置函数。有没有办法将我的树

我正在使用随机森林解决分类问题。为此,我决定使用 Python 库 scikit-learn。但我对随机森林算法和这个工具都很陌生。我的数据包含许多因子变量。我用谷歌搜索,发现像我们在线性回归中所做的

我使用 Keras 回归器对数据进行回归拟合。我使用 Scikit-learn wrapper 和 Pipeline 来首先标准化数据,然后将其拟合到 Keras 回归器上。有点像这样: from s

在 scikit-learn ,有一个 的概念评分函数 .如果我们有一些预测标签和真实标签,我们可以通过调用 scoring(y_true, y_predict) 来获得分数。 .这种评分函数的一个例

我知道 train_test_split 方法将数据集拆分为随机训练和测试子集。并且使用 random_state=int 可以确保每次调用该方法时我们对该数据集都有相同的拆分。 我的问题略有不同。

我正在使用 scikit-learn 0.18.dev0。我知道之前有人问过完全相同的问题 here .我尝试了那里提供的答案,但出现以下错误 >>> def mydist(x, y): ...

我试图在 scikit-learn 中结合递归特征消除和网格搜索。正如您从下面的代码(有效)中看到的那样,我能够从网格搜索中获得最佳估计量,然后将该估计量传递给 RFECV。但是,我宁愿先进行 RFE

我是一名优秀的程序员,十分优秀!