- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章使用DataGrip连接Hive的详细步骤由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

1. 从官网下载安装包 下载网址 。

2. 安装 。

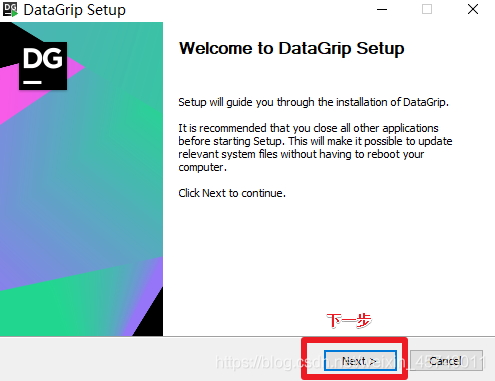

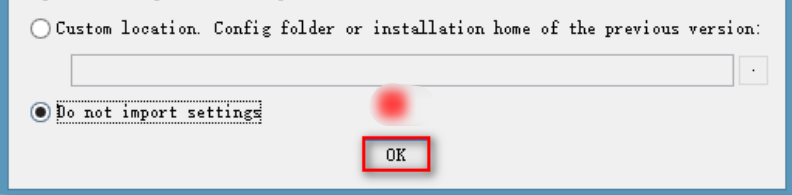

第一步 。

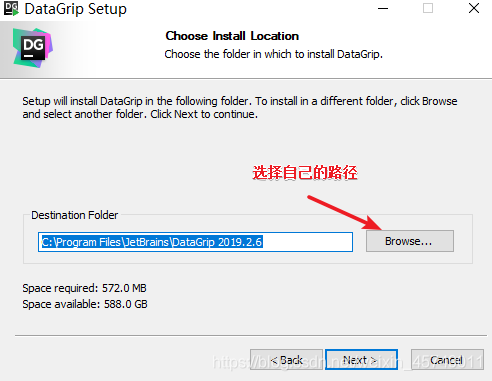

第二步 。

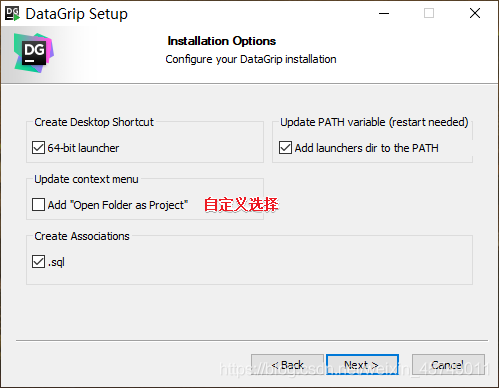

第三步 。

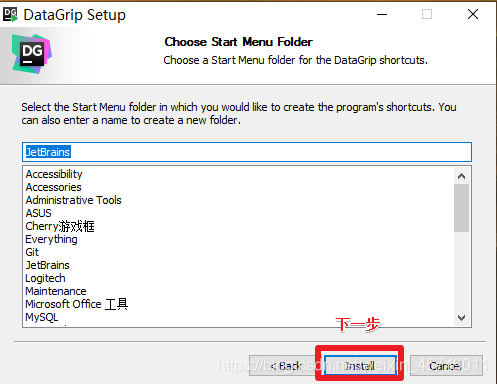

第四步 。

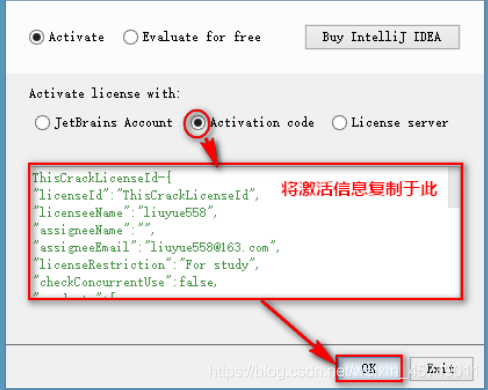

3. 安装完成后输入激活码 。

使用安装idea的图 datagrip 与此类似 。

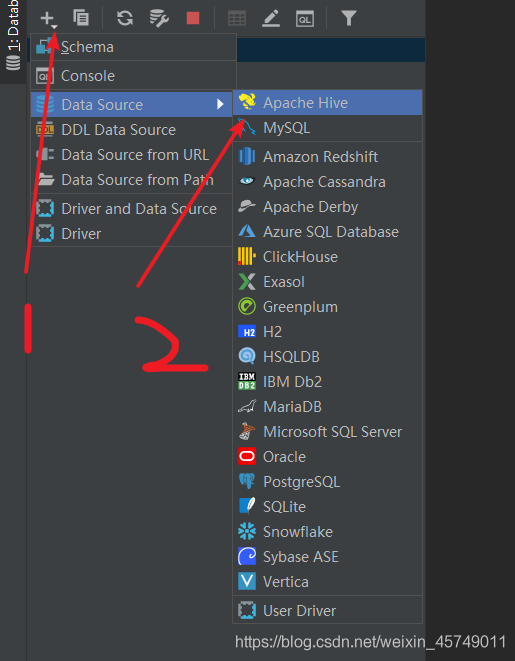

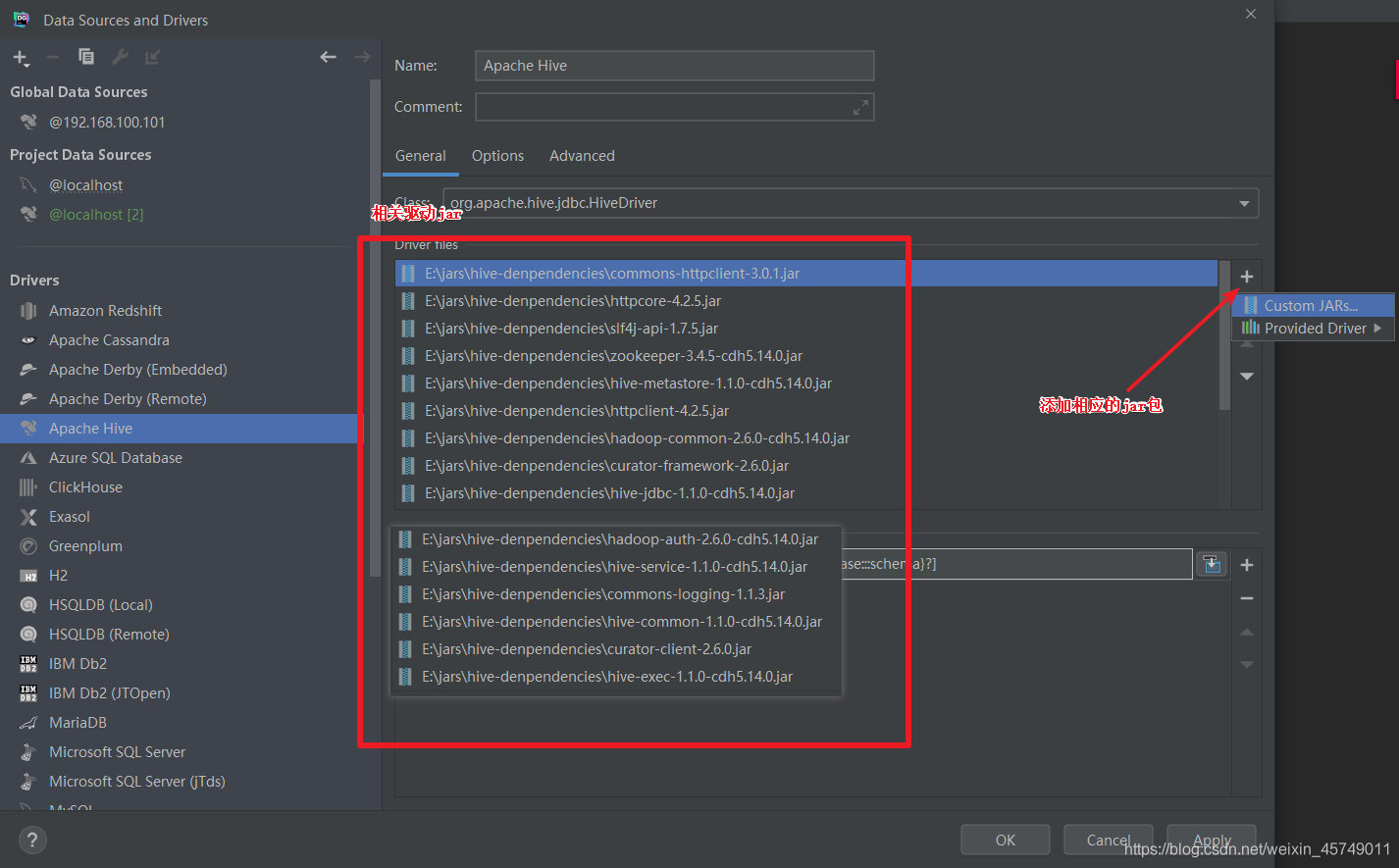

4. 配置hive 。

第一步 。

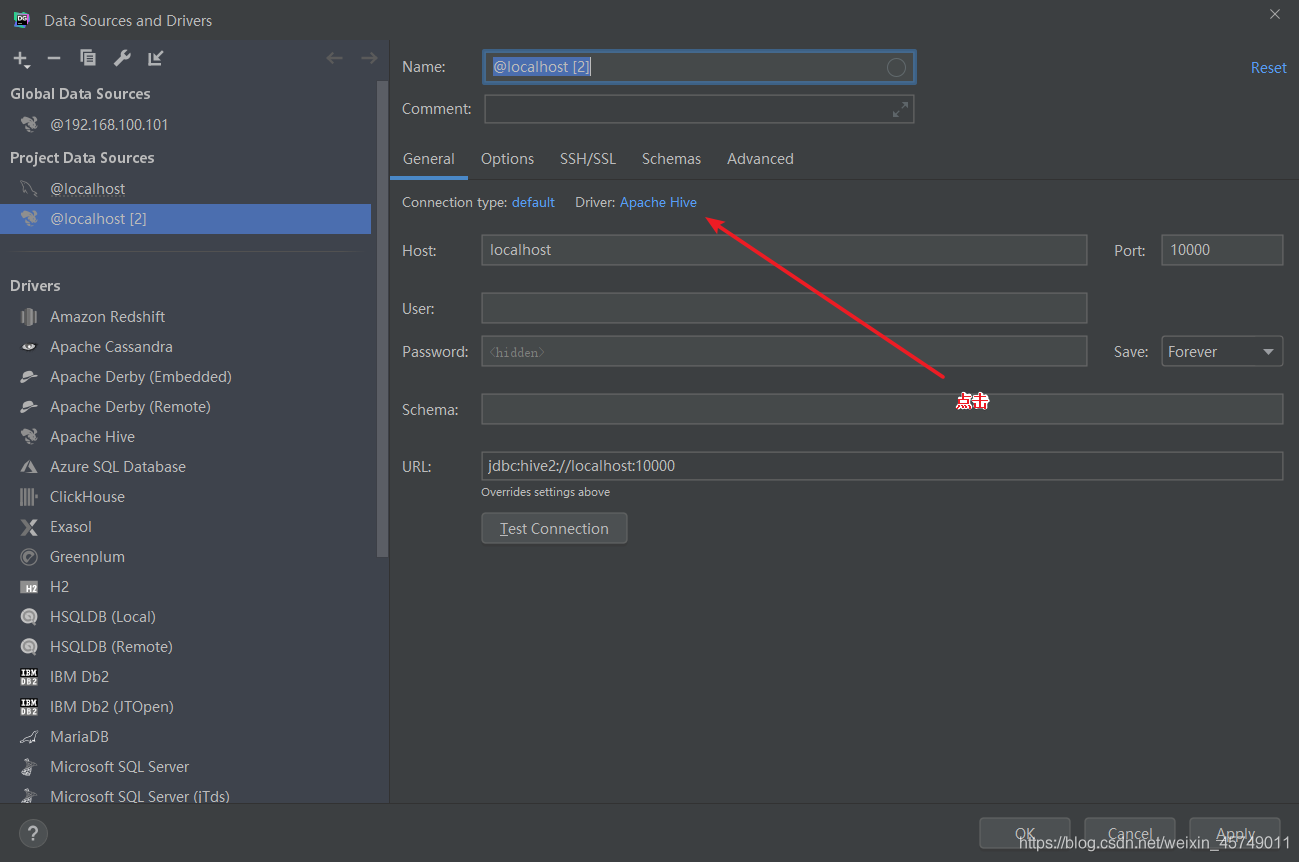

第二步 。

第三步 可以在虚拟机上拷贝到本地 。

。

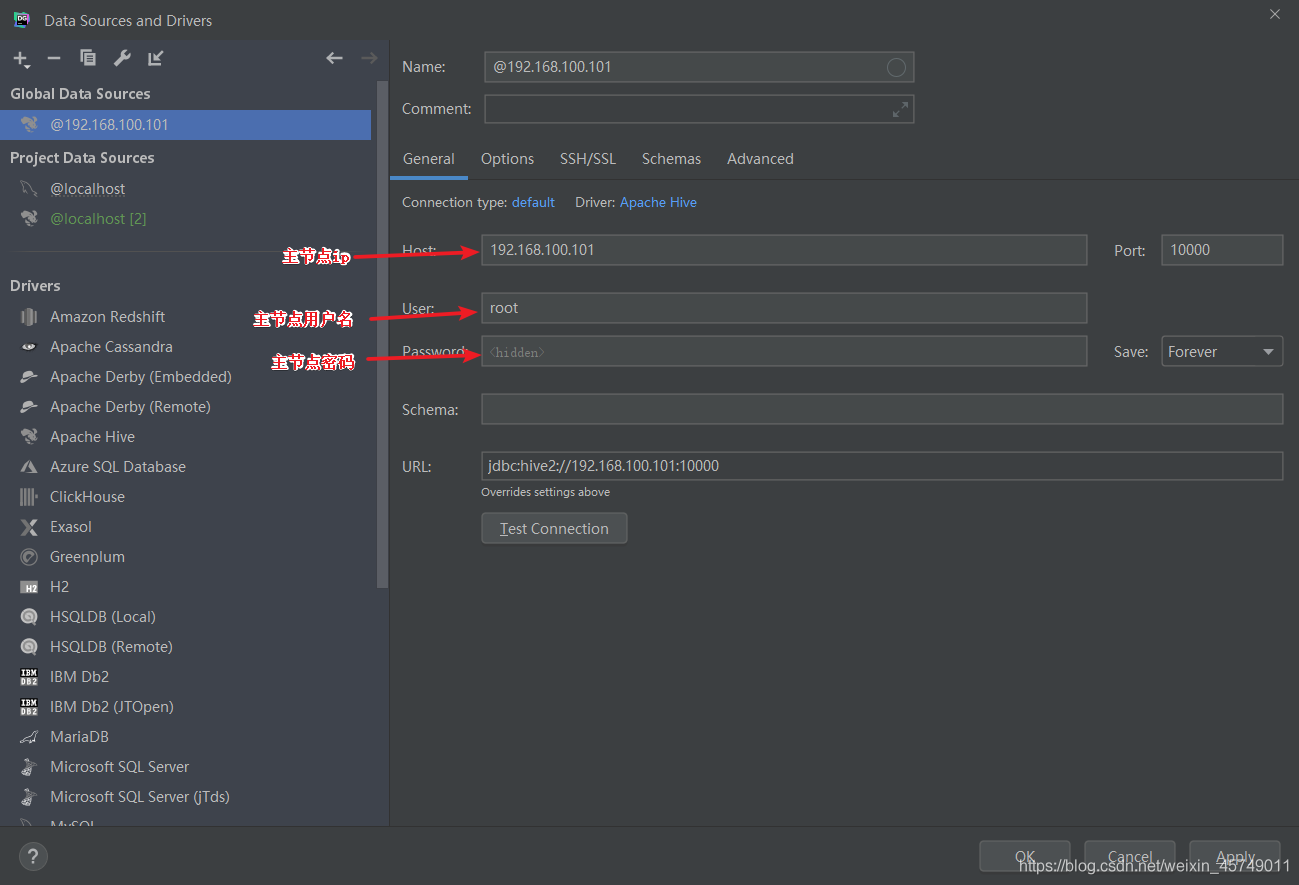

第四步 。

第五步

在主节点上执行如下代码 (后台开启 hive 服务) 。

不开启此服务无法连接 。

|

1

|

[root@node01 /]# nohup hive

--service hiveserver2 &

|

克隆主节点测试是否能够连接的通 。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

|

[root@node01 /]# beeline

which:

no

hbase

in

(/usr/lib64/qt-3.3/bin:/usr/

local

/sbin:/usr/

local

/bin:/sbin:/bin:/usr/sbin:/usr/bin:/export/servers/hadoop-2.6.0-cdh5.14.0/bin:/export/servers/hive-1.1.0-cdh5.14.0//bin:/export/servers/jdk1.8.0_144/bin:/root/bin)

beeline version 1.1.0-cdh5.14.0

by

apache hive

beeline>

beeline>

beeline> !

connect

jdbc:hive2://node01:10000

scan complete

in

2ms

connecting

to

jdbc:hive2://node01:10000

enter username

for

jdbc:hive2://node01:10000: root

enter

password

for

jdbc:hive2://node01:10000: ******

connected

to

: apache hive (version 1.1.0-cdh5.14.0)

driver: hive jdbc (version 1.1.0-cdh5.14.0)

transaction

isolation

: transaction_repeatable_read

0: jdbc:hive2://node01:10000>

|

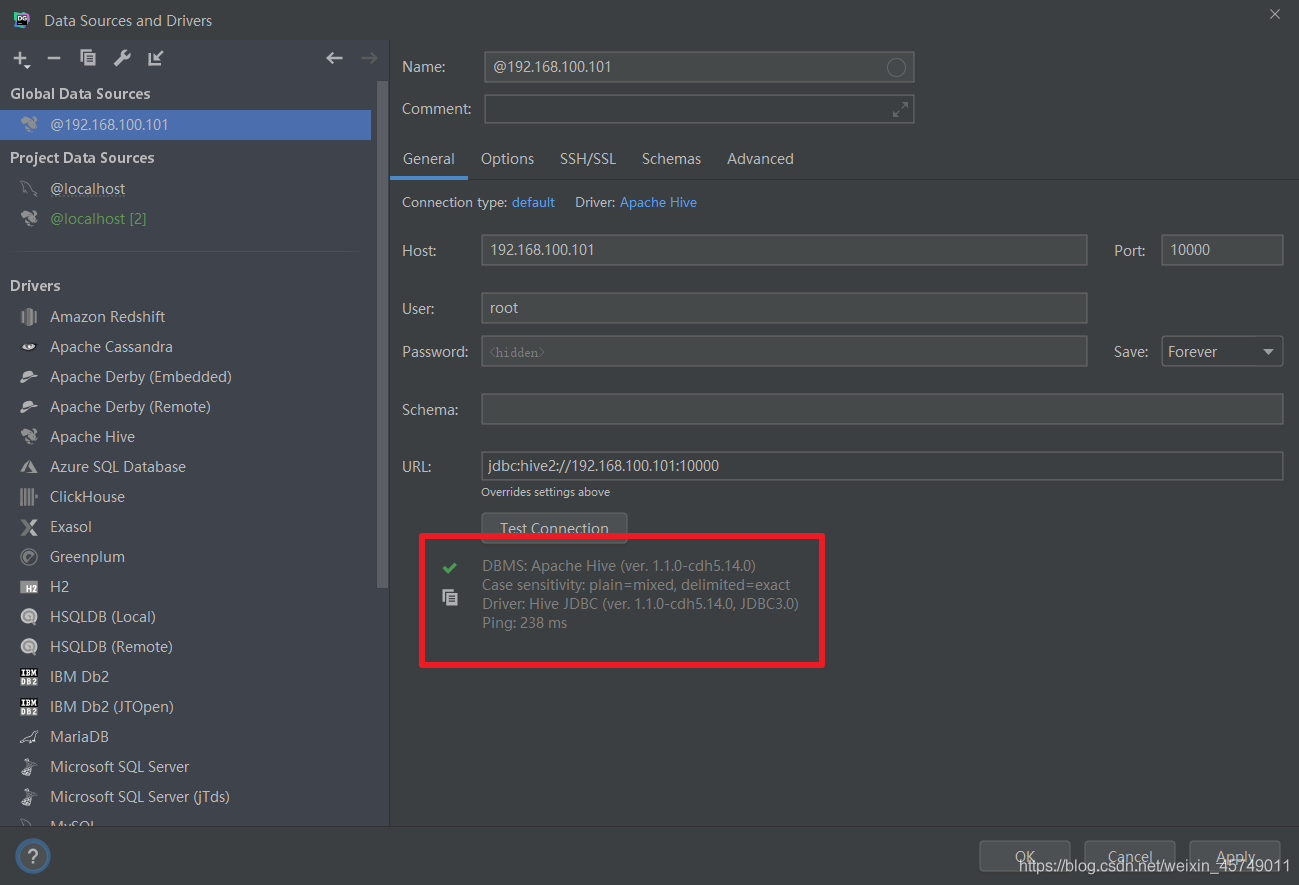

第六步 (看到如下信息即为成功) 。

datagrip系列教程:

最新datagrip2020.2.x破解版激活码的步骤详解(支持mac/windows/linux) 。

datagrip 2020.1 安装与激活方法 。

到此这篇关于datagrip连接hive的详细图文教程的文章就介绍到这了,更多相关datagrip连接hive内容请搜索我以前的文章或继续浏览下面的相关文章希望大家以后多多支持我! 。

原文链接:https://blog.csdn.net/weixin_45749011/article/details/103171510 。

最后此篇关于使用DataGrip连接Hive的详细步骤的文章就讲到这里了,如果你想了解更多关于使用DataGrip连接Hive的详细步骤的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

我可以将 CSV 或任何其他平面文件导入到 hive 中,而无需先在 hive 中创建和定义表结构吗?假设我的 csv 文件有 200 列,需要导入到 hive 表中。所以我必须首先在 hive 中创

我有以下示例数据,我试图在 hive 中爆炸它.. 我使用了 split 但我知道我错过了一些东西.. ["[[-80.742426,35.23248],[-80.740424,35.23184],[

我有一个很大的日志文件,我加载到 HDFS . HDFS将根据机架感知复制到不同的节点。 现在我将相同的文件加载到配置单元表中。命令如下: create table log_analysis (log

我正在尝试使用 UDF在 hive 中。但是当我尝试使用 userdate as 'unixtimeToDate' 创建一个临时函数时,我得到这个异常(exception) hive> create

在Mysql中,我们可以使用DO sleep(5) ;来进行暂停。但它在 Hive 中不起作用。 Hive有 sleep 功能吗? 最佳答案 你可以通过反射调用Thread让hive在处理每一行后多等

我正在将数据从 csv 文件导入 Hive。我的表包含字符串和整数。但是,在我的输入文件中,整数周围有空格,所以它看起来像这样: some string, 2 ,another stri

我可以嵌套吗select在 Hive 中具有不同的条件?例如 如果我有以下两个 Hive 查询: select percentile(x, 0.95) from t1 where y = 1; sel

hive 安装有什么特定的模式吗? 例如,Hadoop 安装有 3 种模式:独立、伪分布式和完全分布式。 同样,Hive 是否有任何特定类型的分布? Hive 可以分布式安装吗? 最佳答案 Hive

我正在使用 Hive,我有一个结构如下的表: CREATE TABLE t1 ( id INT, created TIMESTAMP, some_value BIGINT ); 我需要找到

我是 Hadoop 生态系统工具的新手。 任何人都可以帮助我了解 hive 、直线和 hive 之间的区别。 提前致谢! 最佳答案 Apache hive : 1] Apache Hive 是一个建立

如何在 Hive 中写出数组文字? SELECT PERCENTILE(my_column, [0.5, 0.25, 0.50, 0.75, 0.95]) AS quantiles FROM my_t

我正在尝试在Hive中重命名columnName。是否可以在Hive中重命名列名称。 tableA(栏1,_c1,_c2) 至 tableA(column1,column2,column3) ?? 最

减号查询似乎在 HIVE 中不起作用。 尝试过: select x from abc minus select x from bcd ; 我做错了还是没有为 HIVE 定义负查询?如果是这样,还有其他

我正在尝试使用 hive-jdbc 连接将数据插入 Hive (NON-ACID) 表。如果我在“语句”中执行单个 SQL 查询,它就可以工作。如果我尝试使用“addBatch”对 SQL 进行批处理

我知道这些, 要获取表中的列名,我们可以触发: show columns in . 要获取表的描述(包括 column_name、column_type 和许多其他详细信息): describe [f

无法找到有关 Hive 表最大字符限制的合适规范。 我正在开发一个涉及 hive 表的 ETL 过程,这些表已指定格式为 _ 的命名约定,并且提供的表名称远大于 30 字节(pl/sql 的正常限制)

在安装了Hive的集群中,metastore和namenode有什么?我了解 Metastore 拥有所有表架构、分区详细信息和元数据。现在这个元数据是什么?那么namenode有什么呢?这个元存储在

Hive 中静态分区和动态分区的主要区别是什么?使用单独的插入意味着静态,而对分区表的单个插入意味着动态。还有什么优点吗? 最佳答案 在静态分区中,我们需要在每个 LOAD 语句中指定分区列值。 假设

我是 hadoop 和 hive 的新手。如果有人研究过pivot in hive的概念,请与我分享。 例如:来自 teradata 或 oracle 的数据未转置,这些数据应在 hive 中转置。那

1)如果分区列没有数据,那么当你查询它时,你会得到什么错误? 2)如果某些行没有分区列,这些行将如何处理?会不会有数据丢失? 3)为什么需要对数字列进行分桶?我们也可以使用字符串列吗?流程是什么?您将

我是一名优秀的程序员,十分优秀!