- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章聊聊python中令人迷惑的duplicated和drop_duplicates()用法由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

在算face_track_id map有感:

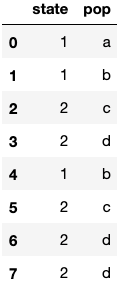

data={"state":[1,1,2,2,1,2,2,2],"pop":["a","b","c","d","b","c","d","d"]}frame=pd.DataFrame(data) frame

frame.shape$ (8,2)

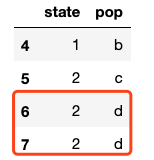

# 说明duplicated()是对整行进行查重,return 重复了的数据,且只现实n-1条重复的数据(n是重复的次数)frame[frame.duplicated() == True]

一开始还很疑惑,明明(1,b)只出现了1次,哪里duplicate了。其实,人家return的结果是去掉已经出现过一次的行数据了。所以看起来有点confuse,感觉(1,b)并没有重复,但其实人家的函数很简洁呢,返回了重复值而且不冗余.

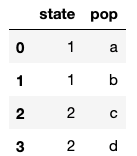

# 说明drop_duplicates()函数是将所有重复的数据都去掉了,且默认保留重复数据的第一条。# 比如(2,d)出现了3次,在duplicated()中显示了2次,在drop_dupicates()后保留了一个frame.drop_duplicates().shape$ (4,2)

# 留下了完全唯一的数据行frame.drop_duplicates()

补充:python的pandas重复值处理(duplicated()和drop_duplicates()) 。

import numpy as npimport pandas as pd #生成重复数据df=pd.DataFrame(np.ones([5,2]),columns=["col1","col2"])df["col3"]=["a","b","a","c","d"]df["col4"]=[3,2,3,2,2]df=df.reindex(columns=["col3","col4","col1","col2"]) #将新增的一列排在第一列df

输出:

#判断重复数据isDplicated=df.duplicated() #判断重复数据记录isDplicated

输出:

#删除重复值new_df1=df.drop_duplicates() #删除数据记录中所有列值相同的记录new_df2=df.drop_duplicates(["col3"]) #删除数据记录中col3列值相同的记录new_df3=df.drop_duplicates(["col4"]) #删除数据记录中col4列值相同的记录new_df4=df.drop_duplicates(["col3","col4"]) #删除数据记录中(col3和col4)列值相同的记录new_df1new_df2new_df3new_df4

输出:

以上为个人经验,希望能给大家一个参考,也希望大家多多支持我.

原文链接:https://blog.csdn.net/weixin_43852674/article/details/87717191 。

最后此篇关于聊聊python中令人迷惑的duplicated和drop_duplicates()用法的文章就讲到这里了,如果你想了解更多关于聊聊python中令人迷惑的duplicated和drop_duplicates()用法的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

我有以下工厂。它还有一个返回允许时间数组的函数(根据调用返回的信息计算)。我想在模板中提供此信息,我该如何在 Controller 中使用? .factory('Company', function(

我需要访问一些网页并像浏览器一样传递 cookie。这很容易使用 CookieHandler.setDefault(new MyCookieManager()); 但这引入了我需要避免的全局状态(想象

当我从 Rails 工作室搬到 Java 商店时,我主要是一名 JS 开发人员,正在学习 Maven。 Codehaus 的人员在提供 Maven 原型(prototype)方面提供了巨大帮助,以指导

从 learningpythonthehardway 开始,我已经进入了文字冒险游戏,我有一些代码,我理解它们执行的内容,但我不明白如何执行。下面是我缩小到单个 .py 文件中的整个代码: from

我在找 here在 CSS 中:事件选择器。 The :active selector styles links toactive pages 这让我开始思考,HTML/CSS 术语中的“事件页面”到

R具有qr()函数,该函数使用LINPACK或LAPACK执行QR分解(以我的经验,后者快5%)。返回的主要对象是一个矩阵“ qr”,该矩阵包含在上三角矩阵R中(即R=qr[upper.tri(qr)

我是一名优秀的程序员,十分优秀!