- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章基于 ZooKeeper 搭建 Hadoop 高可用集群 的教程图解由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

。

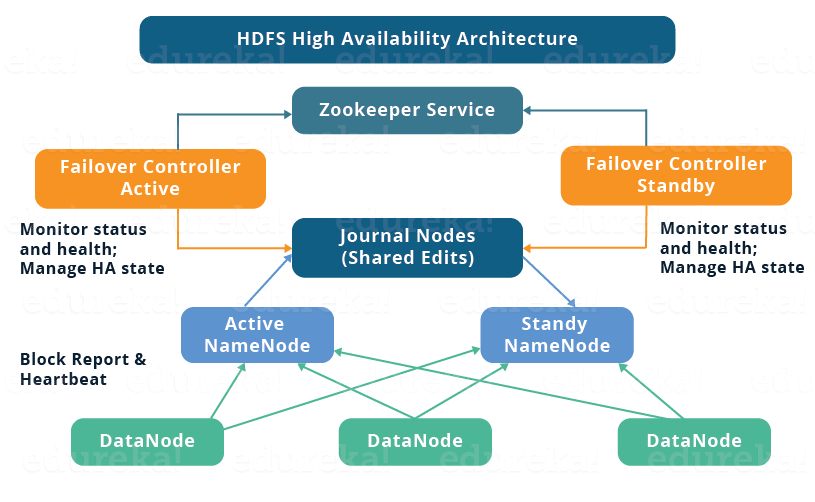

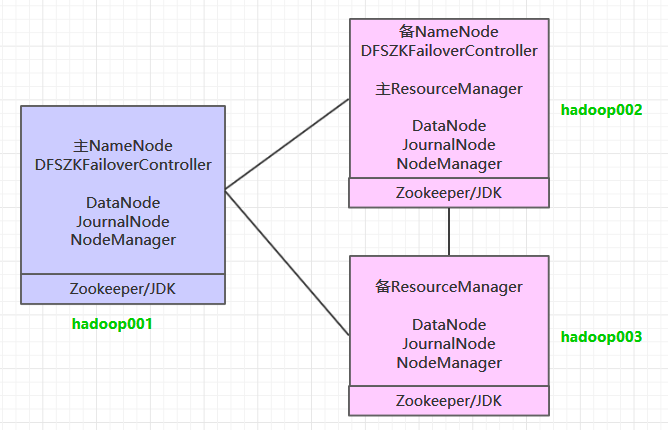

hadoop 高可用 (high availability) 分为 hdfs 高可用和 yarn 高可用,两者的实现基本类似,但 hdfs namenode 对数据存储及其一致性的要求比 yarn resourcemanger 高得多,所以它的实现也更加复杂,故下面先进行讲解:

1.1 高可用整体架构 。

hdfs 高可用架构如下:

图片引用自:https://www.edureka.co/blog/how-to-set-up-hadoop-cluster-with-hdfs-high-availability/ 。

hdfs 高可用架构主要由以下组件所构成:

1.2 基于 qjm 的共享存储系统的数据同步机制分析 。

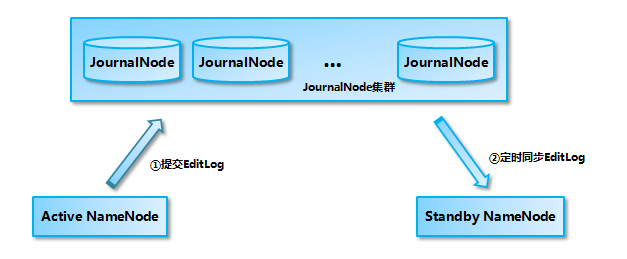

目前 hadoop 支持使用 quorum journal manager (qjm) 或 network file system (nfs) 作为共享的存储系统,这里以 qjm 集群为例进行说明:active namenode 首先把 editlog 提交到 journalnode 集群,然后 standby namenode 再从 journalnode 集群定时同步 editlog,当 active namenode 宕机后, standby namenode 在确认元数据完全同步之后就可以对外提供服务.

需要说明的是向 journalnode 集群写入 editlog 是遵循 “过半写入则成功” 的策略,所以你至少要有3个 journalnode 节点,当然你也可以继续增加节点数量,但是应该保证节点总数是奇数。同时如果有 2n+1 台 journalnode,那么根据过半写的原则,最多可以容忍有 n 台 journalnode 节点挂掉.

1.3 namenode 主备切换 。

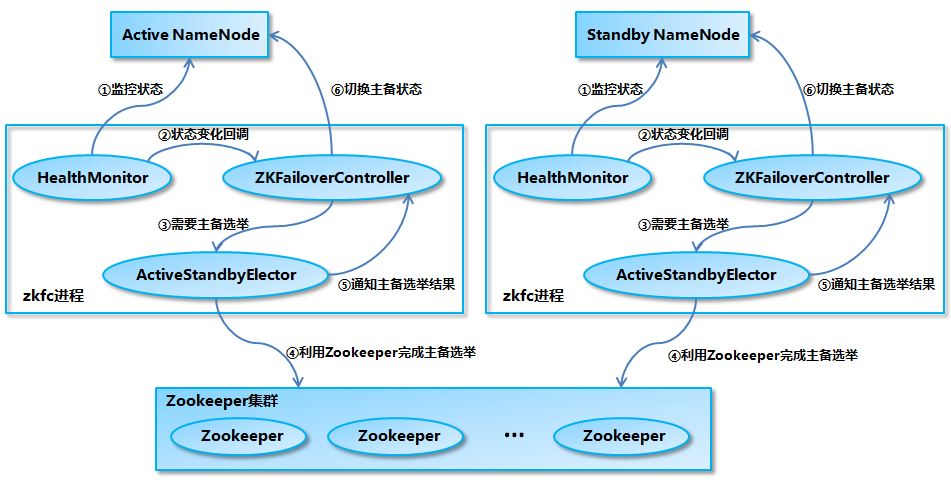

namenode 实现主备切换的流程下图所示:

healthmonitor 初始化完成之后会启动内部的线程来定时调用对应 namenode 的 haserviceprotocol rpc 接口的方法,对 namenode 的健康状态进行检测.

healthmonitor 如果检测到 namenode 的健康状态发生变化,会回调 zkfailovercontroller 注册的相应方法进行处理.

如果 zkfailovercontroller 判断需要进行主备切换,会首先使用 activestandbyelector 来进行自动的主备选举.

activestandbyelector 与 zookeeper 进行交互完成自动的主备选举.

activestandbyelector 在主备选举完成后,会回调 zkfailovercontroller 的相应方法来通知当前的 namenode 成为主 namenode 或备 namenode.

zkfailovercontroller 调用对应 namenode 的 haserviceprotocol rpc 接口的方法将 namenode 转换为 active 状态或 standby 状态.

1.4 yarn高可用 。

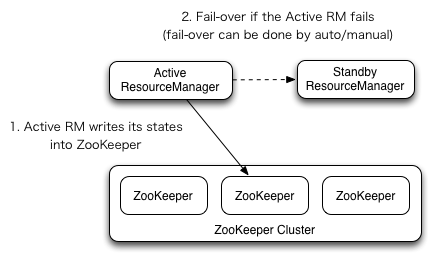

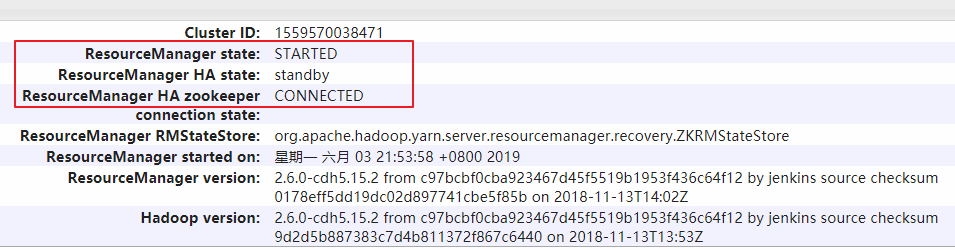

yarn resourcemanager 的高可用与 hdfs namenode 的高可用类似,但是 resourcemanager 不像 namenode ,没有那么多的元数据信息需要维护,所以它的状态信息可以直接写到 zookeeper 上,并依赖 zookeeper 来进行主备选举.

。

按照高可用的设计目标:需要保证至少有两个 namenode (一主一备) 和 两个 resourcemanager (一主一备) ,同时为满足“过半写入则成功”的原则,需要至少要有3个 journalnode 节点。这里使用三台主机进行搭建,集群规划如下:

。

。

4.1 下载并解压 。

下载hadoop。这里我下载的是cdh版本hadoop,下载地址为:http://archive.cloudera.com/cdh5/cdh/5/ 。

|

1

|

# tar -zvxf hadoop-2.6.0-cdh5.15.2.tar.gz

|

4.2 配置环境变量 。

编辑profile文件:

|

1

|

# vim /etc/profile

|

增加如下配置:

|

1

2

|

export hadoop_home=/usr/app/hadoop-2.6.0-cdh5.15.2

export path=${hadoop_home}/bin:$path

|

执行source命令,使得配置立即生效:

|

1

|

# source /etc/profile

|

4.3 修改配置 。

进入${hadoop_home}/etc/hadoop目录下,修改配置文件。各个配置文件内容如下:

|

1

2

|

# 指定jdk的安装位置

export java_home=/usr/java/jdk1.8.0_201/

|

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

|

<configuration>

<property>

<!

-- 指定namenode的hdfs协议文件系统的通信地址 -->

<

name

>fs.defaultfs</

name

>

<value>hdfs://hadoop001:8020</value>

</property>

<property>

<!

-- 指定hadoop集群存储临时文件的目录 -->

<

name

>hadoop.tmp.dir</

name

>

<value>/home/hadoop/tmp</value>

</property>

<property>

<!

-- zookeeper集群的地址 -->

<

name

>ha.zookeeper.quorum</

name

>

<value>hadoop001:2181,hadoop002:2181,hadoop002:2181</value>

</property>

<property>

<!

-- zkfc连接到zookeeper超时时长 -->

<

name

>ha.zookeeper.session-timeout.ms</

name

>

<value>10000</value>

</property>

</configuration>

|

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

|

<configuration>

<property>

<!

-- 指定hdfs副本的数量 -->

<

name

>dfs.replication</

name

>

<value>3</value>

</property>

<property>

<!

-- namenode节点数据(即元数据)的存放位置,可以指定多个目录实现容错,多个目录用逗号分隔 -->

<

name

>dfs.namenode.

name

.dir</

name

>

<value>/home/hadoop/namenode/data</value>

</property>

<property>

<!

-- datanode节点数据(即数据块)的存放位置 -->

<

name

>dfs.datanode.data.dir</

name

>

<value>/home/hadoop/datanode/data</value>

</property>

<property>

<!

-- 集群服务的逻辑名称 -->

<

name

>dfs.nameservices</

name

>

<value>mycluster</value>

</property>

<property>

<!

-- namenode id列表-->

<

name

>dfs.ha.namenodes.mycluster</

name

>

<value>nn1,nn2</value>

</property>

<property>

<!

-- nn1的rpc通信地址 -->

<

name

>dfs.namenode.rpc-address.mycluster.nn1</

name

>

<value>hadoop001:8020</value>

</property>

<property>

<!

-- nn2的rpc通信地址 -->

<

name

>dfs.namenode.rpc-address.mycluster.nn2</

name

>

<value>hadoop002:8020</value>

</property>

<property>

<!

-- nn1的http通信地址 -->

<

name

>dfs.namenode.http-address.mycluster.nn1</

name

>

<value>hadoop001:50070</value>

</property>

<property>

<!

-- nn2的http通信地址 -->

<

name

>dfs.namenode.http-address.mycluster.nn2</

name

>

<value>hadoop002:50070</value>

</property>

<property>

<!

-- namenode元数据在journalnode上的共享存储目录 -->

<

name

>dfs.namenode.shared.edits.dir</

name

>

<value>qjournal://hadoop001:8485;hadoop002:8485;hadoop003:8485/mycluster</value>

</property>

<property>

<!

-- journal edit files的存储目录 -->

<

name

>dfs.journalnode.edits.dir</

name

>

<value>/home/hadoop/journalnode/data</value>

</property>

<property>

<!

-- 配置隔离机制,确保在任何给定时间只有一个namenode处于活动状态 -->

<

name

>dfs.ha.fencing.methods</

name

>

<value>sshfence</value>

</property>

<property>

<!

-- 使用sshfence机制时需要ssh免密登录 -->

<

name

>dfs.ha.fencing.ssh.private-

key

-files</

name

>

<value>/root/.ssh/id_rsa</value>

</property>

<property>

<!

-- ssh超时时间 -->

<

name

>dfs.ha.fencing.ssh.

connect

-timeout</

name

>

<value>30000</value>

</property>

<property>

<!

-- 访问代理类,用于确定当前处于active状态的namenode -->

<

name

>dfs.client.failover.proxy.provider.mycluster</

name

>

<value>org.apache.hadoop.hdfs.server.namenode.ha.configuredfailoverproxyprovider</value>

</property>

<property>

<!

-- 开启故障自动转移 -->

<

name

>dfs.ha.automatic-failover.enabled</

name

>

<value>

true

</value>

</property>

</configuration>

|

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

|

<configuration>

<property>

<!

--配置nodemanager上运行的附属服务。需要配置成mapreduce_shuffle后才可以在yarn上运行mapreduce程序。-->

<

name

>yarn.nodemanager.aux-services</

name

>

<value>mapreduce_shuffle</value>

</property>

<property>

<!

-- 是否启用日志聚合(可选) -->

<

name

>yarn.log-aggregation-enable</

name

>

<value>

true

</value>

</property>

<property>

<!

-- 聚合日志的保存时间(可选) -->

<

name

>yarn.log-aggregation.retain-seconds</

name

>

<value>86400</value>

</property>

<property>

<!

-- 启用rm ha -->

<

name

>yarn.resourcemanager.ha.enabled</

name

>

<value>

true

</value>

</property>

<property>

<!

-- rm集群标识 -->

<

name

>yarn.resourcemanager.cluster-id</

name

>

<value>my-yarn-cluster</value>

</property>

<property>

<!

-- rm的逻辑id列表 -->

<

name

>yarn.resourcemanager.ha.rm-ids</

name

>

<value>rm1,rm2</value>

</property>

<property>

<!

-- rm1的服务地址 -->

<

name

>yarn.resourcemanager.hostname.rm1</

name

>

<value>hadoop002</value>

</property>

<property>

<!

-- rm2的服务地址 -->

<

name

>yarn.resourcemanager.hostname.rm2</

name

>

<value>hadoop003</value>

</property>

<property>

<!

-- rm1 web应用程序的地址 -->

<

name

>yarn.resourcemanager.webapp.address.rm1</

name

>

<value>hadoop002:8088</value>

</property>

<property>

<!

-- rm2 web应用程序的地址 -->

<

name

>yarn.resourcemanager.webapp.address.rm2</

name

>

<value>hadoop003:8088</value>

</property>

<property>

<!

-- zookeeper集群的地址 -->

<

name

>yarn.resourcemanager.zk-address</

name

>

<value>hadoop001:2181,hadoop002:2181,hadoop003:2181</value>

</property>

<property>

<!

-- 启用自动恢复 -->

<

name

>yarn.resourcemanager.recovery.enabled</

name

>

<value>

true

</value>

</property>

<property>

<!

-- 用于进行持久化存储的类 -->

<

name

>yarn.resourcemanager.store.class</

name

>

<value>org.apache.hadoop.yarn.server.resourcemanager.recovery.zkrmstatestore</value>

</property>

</configuration>

|

|

1

2

3

4

5

6

7

|

<configuration>

<property>

<!

--指定mapreduce作业运行在yarn上-->

<

name

>mapreduce.framework.

name

</

name

>

<value>yarn</value>

</property>

</configuration>

|

配置所有从属节点的主机名或ip地址,每行一个。所有从属节点上的datanode服务和nodemanager服务都会被启动.

|

1

2

3

|

hadoop001

hadoop002

hadoop003

|

4.4 分发程序 。

将hadoop安装包分发到其他两台服务器,分发后建议在这两台服务器上也配置一下hadoop的环境变量.

|

1

2

3

4

|

# 将安装包分发到hadoop002

scp -r /usr/app/hadoop-2.6.0-cdh5.15.2/ hadoop002:/usr/app/

# 将安装包分发到hadoop003

scp -r /usr/app/hadoop-2.6.0-cdh5.15.2/ hadoop003:/usr/app/

|

。

5.1 启动zookeeper 。

分别到三台服务器上启动zookeeper服务:

|

1

|

zkserver.sh start

|

5.2 启动journalnode 。

分别到三台服务器的的${hadoop_home}/sbin目录下,启动journalnode进程:

|

1

|

hadoop-daemon.sh start journalnode

|

5.3 初始化namenode 。

在hadop001上执行namenode初始化命令:

|

1

|

hdfs namenode -format

|

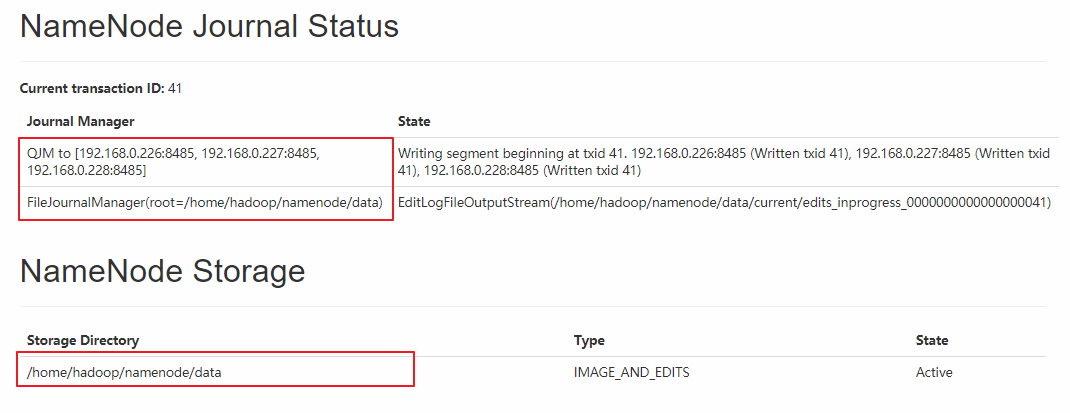

执行初始化命令后,需要将namenode元数据目录的内容,复制到其他未格式化的namenode上。元数据存储目录就是我们在hdfs-site.xml中使用dfs.namenode.name.dir属性指定的目录。这里我们需要将其复制到hadoop002上:

|

1

|

scp -r /home/hadoop/namenode/data hadoop002:/home/hadoop/namenode/

|

5.4 初始化ha状态 。

在任意一台namenode上使用以下命令来初始化zookeeper中的ha状态:

|

1

|

hdfs zkfc -formatzk

|

5.5 启动hdfs 。

进入到hadoop001的${hadoop_home}/sbin目录下,启动hdfs。此时hadoop001和hadoop002上的namenode服务,和三台服务器上的datanode服务都会被启动:

|

1

|

start-dfs.sh

|

5.6 启动yarn 。

进入到hadoop002的${hadoop_home}/sbin目录下,启动yarn。此时hadoop002上的resourcemanager服务,和三台服务器上的nodemanager服务都会被启动:

|

1

|

start-yarn.sh

|

需要注意的是,这个时候hadoop003上的resourcemanager服务通常是没有启动的,需要手动启动:

|

1

|

yarn-daemon.sh start resourcemanager

|

。

6.1 查看进程 。

成功启动后,每台服务器上的进程应该如下:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

|

[root@hadoop001 sbin]# jps

4512 dfszkfailovercontroller

3714 journalnode

4114 namenode

3668 quorumpeermain

5012 datanode

4639 nodemanager

[root@hadoop002 sbin]# jps

4499 resourcemanager

4595 nodemanager

3465 quorumpeermain

3705 namenode

3915 dfszkfailovercontroller

5211 datanode

3533 journalnode

[root@hadoop003 sbin]# jps

3491 journalnode

3942 nodemanager

4102 resourcemanager

4201 datanode

3435 quorumpeermain

|

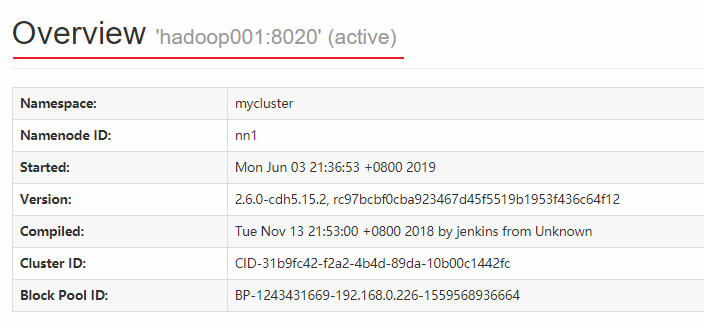

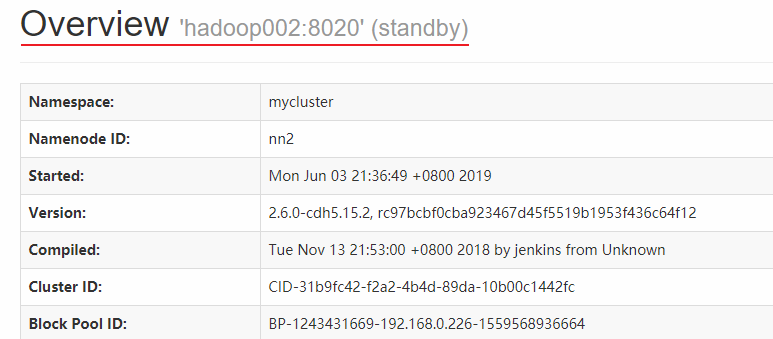

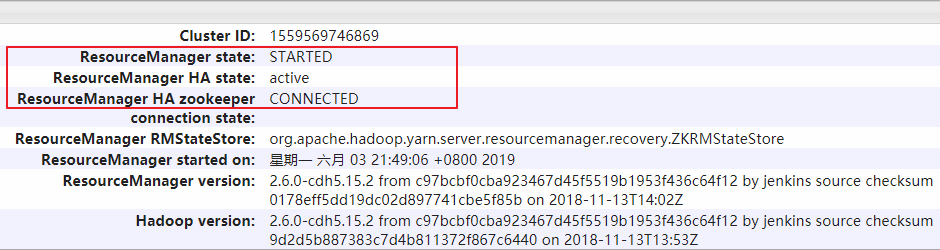

6.2 查看web ui 。

hdfs和yarn的端口号分别为50070和8080,界面应该如下:

此时hadoop001上的namenode处于可用状态:

而hadoop002上的namenode则处于备用状态:

。

。

hadoop002上的resourcemanager处于可用状态:

。

。

hadoop003上的resourcemanager则处于备用状态:

。

。

同时界面上也有journal manager的相关信息:

。

。

上面的集群初次启动涉及到一些必要初始化操作,所以过程略显繁琐。但是集群一旦搭建好后,想要再次启用它是比较方便的,步骤如下(首选需要确保zookeeper集群已经启动):

在hadoop001启动 hdfs,此时会启动所有与 hdfs 高可用相关的服务,包括 namenode,datanode 和 journalnode:

|

1

|

start-dfs.sh

|

在hadoop002启动yarn:

|

1

|

start-yarn.sh

|

这个时候hadoop003上的resourcemanager服务通常还是没有启动的,需要手动启动:

|

1

|

yarn-daemon.sh start resourcemanager

|

。

以上搭建步骤主要参考自官方文档:

总结 。

以上所述是小编给大家介绍的基于 ZooKeeper 搭建 高可用集群 的教程图解,希望对大家有所帮助,如果大家有任何疑问请给我留言,小编会及时回复大家的。在此也非常感谢大家对我网站的支持! 如果你觉得本文对你有帮助,欢迎转载,烦请注明出处,谢谢! 。

原文链接:https://www.cnblogs.com/heibaiying/archive/2019/06/23/11071857.html 。

最后此篇关于基于 ZooKeeper 搭建 Hadoop 高可用集群 的教程图解的文章就讲到这里了,如果你想了解更多关于基于 ZooKeeper 搭建 Hadoop 高可用集群 的教程图解的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

我们有数据(此时未分配)要转换/聚合/透视到 wazoo。 我在 www 上看了看,我问的所有答案都指向 hadoop 可扩展、运行便宜(没有 SQL 服务器机器和许可证)、快速(如果你有足够的数据)

这很明显,我们都同意我们可以将 HDFS + YARN + MapReduce 称为 Hadoop。但是,Hadoop 生态系统中的其他不同组合和其他产品会怎样? 例如,HDFS + YARN + S

如果 es-hadoop 只是连接到 HDFS 的 Hadoop 连接器,它如何支持 Hadoop 分析? 最佳答案 我假设您指的是 this project .在这种情况下,ES Hadoop 项目

看完this和 this论文,我决定我想在 MapReduce 上为大型数据集实现分布式体积渲染设置作为我的本科论文工作。 Hadoop 是一个合理的选择吗? Java 不会扼杀一些性能提升或使与 C

我一直在尝试查找有关如何通过命令行提交 hadoop 作业的信息。 我知道命令 - hadoop jar jar-file 主类输入输出 还有另一个命令,我正在尝试查找有关它的信息,但未能找到 - h

Hadoop 服务器在 Kubernetes 中。而Hadoop客户端位于外网。所以我尝试使用 kubernetes-service 来使用 Hadoop 服务器。但是 hadoop fs -put

有没有人遇到奇怪的环境问题,在调用 hadoop 命令时被迫使用 SU 而不是 SUDO? sudo su -c 'hadoop fs -ls /' hdfs Found 4 itemsdrwxr-x

在更改 mapred-site.xml 中的属性后,我给出了一个 tar.bz2 文件、.gz 和 tar.gz 文件作为输入。以上似乎都没有奏效。我假设这里发生的是 hadoop 作为输入读取的记录

如何在 Hadoop Pipes 中获取正在 hadoop 映射器 中执行的输入文件 名称? 我可以很容易地在基于 java 的 map reducer 中获取文件名,比如 FileSplit fil

我想使用 MapReduce 方法分析连续的数据流(通过 HTTP 访问),因此我一直在研究 Apache Hadoop。不幸的是,Hadoop 似乎期望以固定大小的输入文件开始作业,而不是能够在新数

名称节点可以执行任务吗?默认情况下,任务在集群的数据节点上执行。 最佳答案 假设您正在询问MapReduce ... 使用YARN,MapReduce任务在应用程序主数据库中执行,而不是在nameno

我有一个关系A包含 (zip-code). 我还有另一个关系B包含 (name:gender:zip-code) (x:m:1234) (y:f:1234) (z:m:1245) (s:f:1235)

我是hadoop地区的新手。您能帮我负责(k2,list[v2,v2,v2...])形式的输出(意味着将键及其所有关联值组合在一起)的责任是吗? 谢谢。 最佳答案 这是Hadoop的MapReduce

因此,我一直在尝试编写一个hadoop程序,该程序将输入作为一个包含许多文件的文件,并且我希望hadoop程序的输出仅是输入文件的一行。但是我还没有做到这一点。我也不想去 reducer 课。如果有人

我使用的输入文本文件的内容是 1 "Come 1 "Defects," 1 "I 1 "Information 1 "J" 2 "Plain 5 "Project 1

谁能告诉我以下grep命令的作用: $ bin/hadoop jar hadoop-*-examples.jar grep input output 'dfs[a-z.]+' 最佳答案 http:/

我不了解mapreducer的基本功能,mapreducer是否有助于将文件放入HDFS 或mapreducer仅有助于分析HDFS中现有文件中的内容 我对hadoop非常陌生,任何人都可以指导我理解

CopyFromLocal将从本地文件系统上载数据。 不要放会从任何文件上传数据,例如。本地FS,亚马逊S3 或仅来自本地fs ??? 最佳答案 请找到两个命令的用法。 put ======= Usa

我开始研究hadoop mapreduce。 我是Java和hadoop的初学者,并且了解hadoop mapreduce的编码,但是有兴趣了解它在云中的内部工作方式。 您能否分享一些很好的链接来说明

我一直在寻找Hadoop mapreduce类的类路径。我正在使用Hortonworks 2.2.4版沙箱。我需要这样的类路径来运行我的javac编译器: javac -cp (CLASS_PATH)

我是一名优秀的程序员,十分优秀!