- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章pandas系列之DataFrame 行列数据筛选实例由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

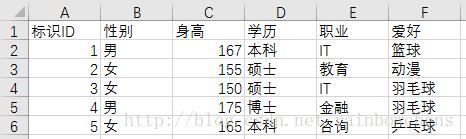

1、对dataframe的认知 。

dataframe的本质是行(index)列(column)索引+多列数据.

为了简化理解,我们不妨换个思路… 。

现实中,为了简化对一件事物的描述,我们会选择几个特征.

例如,从(性别、身高、学历、职业、爱好..)等角度去刻画一个人,这些“角度”即为“特征”.

其中,不同的行表示不同的记录;列代表特征,不同记录因各个特征之间的差异而不同.

dataframe默认索引是序号(0,1,2…),可以理解成位置索引。一般我们用id标识不同记录,不会改变index。但为了理解不同特征(列)含义,我们往往会重新指定column.

一些简易但不算严谨的理解是:

行列 。

行 – index – 记录 (一般沿用默认索引) 。

列 – column – 特征 (自定义索引) 。

索引 。

默认索引 – 序号 – 位置 – 方便索引但理解不易 。

自定义索引 – 特征名称 – 属性 – 便于理解 。

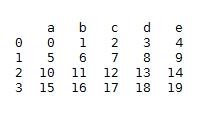

2、对dataframe进行行列数据筛选 。

|

1

2

3

|

import

pandas as pd,numpy as np

from

pandas

import

dataframe

df

=

dataframe(np.arange(

20

).reshape((

4

,

5

)),column

=

list

(

'abcde'

))

|

1.df[]&df. 选取列数据 。

|

1

2

|

df.a

df[[‘a

','

b']]

|

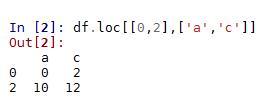

2.df.loc[[index],[colunm]] 通过标签选择数据 。

不对行进行筛选时,[index]处填 : (不能为空),即df.loc[:,'a']表示选取a列全部数据.

|

1

2

3

|

df.loc[

0

,

'a'

]

df.loc[

0

:

1

,[‘a

','

b']]

df.loc[[

0

,

2

],[‘a

','

c']]

|

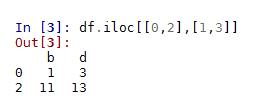

3.df.iloc[[index],[colunm]] 通过位置选择数据 。

不对行进行筛选时,同df.loc[],即[index]处不能为空.

|

1

2

3

|

df.iloc[

0

,

0

]

df.iloc[

0

:

1

,

1

:

3

]

df.iloc[[

0

,

2

],[

1

,

3

]]

|

4.df.ix[[index],[column]] 通过标签or位置选择数据 。

df.ix[]混合了标签和位置选择。需要注意的是,[index]和[column]的框内需要指定同一类的选择。 df.ix[[0:1],[‘a',3]]报错 。

以上这篇pandas系列之dataframe 行列数据筛选实例就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持我.

原文链接:https://blog.csdn.net/rainbowchens/article/details/76651547 。

最后此篇关于pandas系列之DataFrame 行列数据筛选实例的文章就讲到这里了,如果你想了解更多关于pandas系列之DataFrame 行列数据筛选实例的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

假设我有 3 个 DataFrame。其中一个 DataFrame 的列名不在其他两个中。 using DataFrames df1 = DataFrame([['a', 'b', 'c'], [1,

假设我有 3 个 DataFrame。其中一个 DataFrame 的列名不在其他两个中。 using DataFrames df1 = DataFrame([['a', 'b', 'c'], [1,

我有一个 largeDataFrame(多列和数十亿行)和一个 smallDataFrame(单列和 10,000 行)。 只要 largeDataFrame 中的 some_identifier 列

我有一个函数,可以在其中规范化 DataFrame 的前 N 列。我想返回规范化的 DataFrame,但不要管原来的。然而,该函数似乎也会对传递的 DataFrame 进行变异! using D

我想在 Scala 中使用指定架构在 DataFrame 上创建。我尝试过使用 JSON 读取(我的意思是读取空文件),但我认为这不是最佳实践。 最佳答案 假设您想要一个具有以下架构的数据框: roo

我正在尝试从数据框中删除一些列,并且不希望返回修改后的数据框并将其重新分配给旧数据框。相反,我希望该函数只修改数据框。这是我尝试过的,但它似乎并没有做我所除外的事情。我的印象是参数是作为引用传递的,而

我有一个包含大约 60000 个数据的庞大数据集。我会首先使用一些标准对整个数据集进行分组,接下来我要做的是将整个数据集分成标准内的许多小数据集,并自动对每个小数据集运行一个函数以获取参数对于每个小数

我遇到了以下问题,并有一个想法来解决它,但没有成功:我有一个月内每个交易日的 DAX 看涨期权和看跌期权数据。经过转换和一些计算后,我有以下 DataFrame: DaxOpt 。现在的目标是消除没有

我正在尝试做一些我认为应该是单行的事情,但我正在努力把它做好。 我有一个大数据框,我们称之为lg,还有一个小数据框,我们称之为sm。每个数据帧都有一个 start 和一个 end 列,以及多个其他列所

我有一个像这样的系列数据帧的数据帧: state1 state2 state3 ... sym1 sym

我有一个大约有 9k 行和 57 列的数据框,这是“df”。 我需要一个新的数据框:'df_final'- 对于“df”的每一行,我必须将每一行复制“x”次,并将每一行中的日期逐一增加,也就是“x”次

假设有一个 csv 文件如下: # data.csv 0,1,2,3,4 a,3.0,3.0,3.0,3.0,3.0 b,3.0,3.0,3.0,3.0,3.0 c,3.0,3.0,3.0,3.0,3

我只想知道是否有人对以下问题有更优雅的解决方案: 我有两个 Pandas DataFrame: import pandas as pd df1 = pd.DataFrame([[1, 2, 3], [

我有一个 pyspark 数据框,我需要将其转换为 python 字典。 下面的代码是可重现的: from pyspark.sql import Row rdd = sc.parallelize([R

我有一个 DataFrame,我想在 @chain 的帮助下对其进行处理。如何存储中间结果? using DataFrames, Chain df = DataFrame(a = [1,1,2,2,2

我有一个包含 3 列的 DataFrame,名为 :x :y 和 :z,它们是 Float64 类型。 :x 和 "y 在 (0,1) 上是 iid uniform 并且 z 是 x 和 y 的总和。

这个问题在这里已经有了答案: pyspark dataframe filter or include based on list (3 个答案) 关闭 2 年前。 只是想知道是否有任何有效的方法来过

我刚找到这个包FreqTables ,它允许人们轻松地从 DataFrames 构建频率表(我正在使用 DataFrames.jl)。 以下代码行返回一个频率表: df = CSV.read("exa

是否有一种快速的方法可以为 sort 指定自定义订单?/sort!在 Julia DataFrames 上? julia> using DataFrames julia> srand(1); juli

在 Python Pandas 和 R 中,可以轻松去除重复的列 - 只需加载数据、分配列名,然后选择那些不重复的列。 使用 Julia Dataframes 处理此类数据的最佳实践是什么?此处不允许

我是一名优秀的程序员,十分优秀!