- ubuntu12.04环境下使用kvm ioctl接口实现最简单的虚拟机

- Ubuntu 通过无线网络安装Ubuntu Server启动系统后连接无线网络的方法

- 在Ubuntu上搭建网桥的方法

- ubuntu 虚拟机上网方式及相关配置详解

CFSDN坚持开源创造价值,我们致力于搭建一个资源共享平台,让每一个IT人在这里找到属于你的精彩世界.

这篇CFSDN的博客文章学C语言的看过来,最完整进制转换、整数和小数内存存储模型由作者收集整理,如果你对这篇文章有兴趣,记得点赞哟.

。

什么是进制 。

进制也就是进位计数制,是人为定义的带进位的计数方法。对于任何一种进制---N进制,就表示每一位置上的数运算时都是逢N进一位.

数数相信大家都会了,比如0 1 2 3 4 5 6 7 8 9 10 11 12 13...,在数数时某一位数量满10了就向前进位,这种逢十进一的进位制,就叫十进制.

不过在日常生活中,并不止这一种进位制,比如1小时有60分钟,1分钟有60秒,满60进一,这就是六十进制.

而在计算机中常用的进制除了十进制,还有二进制、八进制、十六进制 。

二进制 。

组成:0 1 。

规则:逢二进一 。

表示方式:二进制数1000010可写成(1000010)2或写成1000010B 。

八进制 。

组成:0 1 2 3 4 5 6 7 。

规则:逢八进一 。

表示方式:八进制数520可写成(520)8或写成520O 。

十六进制 。

组成:0 1 2 3 4 5 6 7 8 9 A B C D E F 。

规则:逢十六进一 。

表示方式:十六进制的520可以写成(520)16或写成520H 。

为什么在计算机中,有这么多种进制表示方式?

存储单位 。

我们平常使用的程序,如:Windows操作系统、打字软件、游戏软件等。一般安装在硬盘等外存上,但仅此是不能使用其功能,必须把它们调入内存中运行,才能真正使用其功能.

因为内存的读写速度相对于外存来说非常快,但是内存是暂时存储程序以及数据的地方。当我们使用WPS处理文稿时,当你在键盘上敲入字符时,它被存入内存中。当你选择存盘时,内存中的数据才会被存入硬(磁)盘.

内存是由无数个晶体管组成的(可以理解为灯泡),一个晶体管作为一比特(bit)的存储器。每个晶体管可以存储一个二进制0或1,比特通常也叫做位.

位(bit): 计算机存储的最小单位 。

字节(byte): 数据表示的最小单位 。

千字节(KB):

字节以上的转换单位都是1024,只有一个字节等于八个位是不一样的... 。

思考:为什么硬盘标注的容量与实际的容量不一样?

买的256G硬盘实际上只有238.4G,咱们一起来换算一下:

硬盘厂商十进制计算:256G = 256,000MB = 256,000,000KB = 256,000,000,000Byte 以1000为单位换算操作系统二进制计算: 256G = 262,144MB = 268,435,456KB = 274,877,906,944Byte 以1024为单位换算那么256G实际容量:256,000,000.

000Byte/1024MB/1024MB/1024MB = 238.4G 。

所以,买256G硬盘实际上只有238.4G,而且容量越大差距也就越大了.

进制转换 。

十进制转其他进制:短除法 。

其他进制转十进制:位权相加 。

二进制10 0000 1000 转十进制 。

八进制1010 转十进制 。

十六进制208 转十进制 。

八进制、十六进制与二进制相互转换:拆位 。

八进制与二进制 。

一个八进制数可以拆分为3个二进制数,3个二进制数可以合成一个八进制数 。

十六进制与二进制 。

一个八进制数可以拆分为4个二进制数,4个二进制数可以合成一个八进制数 。

为什么可以这样拆位呢?

三位二进制数表示的范围是[0 - 8) -> 2^3 对于八进制来说刚刚好 。

四位二进制数表示的范围是[0 - 16) -> 2^4 对于十六进制来说刚刚好 。

整数的存储方式 。

一,机器数和机器数的真值 。

一个数在计算机中的二进制表示形式,叫做这个数的机器数。机器数是带符号的,在计算机用机器数的最高位存放符号,正数为0,负数为1.

比如,十进制中的数 +3 ,计算机字长为8位,转换成二进制就是0000 0011,如果是 -3 ,就是 100 00011 .

那么,这里的 0000 0011 和 1000 0011 就是机器数.

因为第一位是符号位,所以机器数的形式值就不等于真正的数值.

例如上面的有符号数 1000 0011,其最高位1代表负,其真正数值是 -3,而不是形式值131(1000 0011转换成十进制等于131)。所以,为区别起见,将带符号位的机器数对应的真正数值称为机器数的真值.

例:0000 0001的真值 = +000 0001 = +1,1000 0001的真值 = –000 0001 = –1 。

二,原码, 反码, 补码 。

让我们先了解原码、反码和补码的概念。对于一个数,计算机要使用一定的编码方式进行存储,原码、反码、补码是机器存储一个具体数字的编码方式.

原码就是机器数,即用第一位表示符号,其余位表示值。比如:如果是8位二进制:

[+1]原= 0000 0001 。

[-1]原= 1000 0001 。

第一位是符号位,因为第一位是符号位,所以8位二进制数的取值范围就是:(即第一位不表示值,只表示正负。) 。

[1111 1111 , 0111 1111] 即 [-127 , 127] 。

原码是人脑最容易理解和计算的表示方式.

正数的反码是其本身,

负数的反码是在其原码的基础上,符号位不变,其余各个位取反.

[+1] = [0000 0001]原 = [0000 0001]反 。

[-1] = [1000 0001]原 = [1111 1110]反 。

可见如果一个反码表示的是负数,人脑无法直观地看出来它的数值。通常要将其转换成原码再计算.

正数的补码就是其本身,

负数的补码是在其原码的基础上,符号位不变,其余各位取反,最后+1。(也即在反码的基础上+1) 。

[+1] = [0000 0001]原 = [0000 0001]反 = [0000 0001]补 。

[-1] = [1000 0001]原 = [1111 1110]反 = [1111 1111]补 。

对于负数,补码表示方式也是人脑无法直观看出其数值的。通常也需要转换成原码再计算其数值.

三,为何要使用原码、反码和补码 。

人脑可以知道第一位是符号位,在计算的时候我们会根据符号位,选择对真值区域的加减。(真值的概念在本文最开头) 但是对于计算机,加减乘数已经是最基础的运算,要设计得尽量简单,计算机辨别"符号位"显然会让计算机的基础电路设计变得十分复杂.

于是人们想出了将符号位也参与运算的方法。我们知道,根据运算法则减去一个正数等于加上一个负数,即:1-1 = 1 + (-1) = 0, 所以机器可以只有加法而没有减法,这样计算机运算的设计就更简单了.

我们以计算十进制表达式:1 - 1 = 0为例 。

首先来看原码:

1 - 1 = 1 + (-1) = [0000 0001]原+ [1000 0001]原= [1000 0010]原= -2 。

如果用原码表示,让符号位也参与计算,显然对于减法来说,结果是不正确的。这也就是为何计算机内部不使用原码表示一个数.

为了解决原码做减法的问题, 出现了反码:

1 - 1 = 1 + (-1) = [0000 0001]原+ [1000 0001]原= [0000 0001]反+ [1111 1110]反= [1111 1111]反= [1000 0000]原= -0 。

发现用反码计算减法,结果的真值部分是正确的。而唯一的问题其实就出现在"0"这个特殊的数值上,虽然人们理解上+0和-0是一样的,但是0带符号是没有任何意义的,而且会有[0000 0000]原和[1000 0000]原两个编码表示0.

于是补码的出现,解决了0的符号问题以及0的两个编码问题:

1-1 = 1 + (-1) = [0000 0001]原+ [1000 0001]原= [0000 0001]补+ [1111 1111]补= [1 0000 0000]补=[0000 0000]补=[0000 0000]原注意:进位1不在计算机字长里.

这样0用[0000 0000]表示,而以前出现问题的-0则不存在了。而且可以用[1000 0000]表示-128:-128的由来如下:

(-1) + (-127) = [1000 0001]原+ [1111 1111]原= [1111 1111]补+ [1000 0001]补= [1000 0000]补 。

-1-127的结果应该是-128,在用补码运算的结果中,[1000 0000]补就是-128,但是注意因为实际上是使用以前的-0的补码来表示-128,所以-128并没有原码和反码表示。(对-128的补码表示[1000 0000]补,算出来的原码是[0000 0000]元,这是不正确的) 。

使用补码,不仅仅修复了0的符号以及存在两个编码的问题,而且还能够多表示一个最低数。这就是为什么8位二进制,使用原码或反码表示的范围为[-127, +127],而使用补码表示的范围为[-128, 127].

整数的存储是将十进制为的整数转换成其相应的补码后存储.

小数的存储方式 。

现如今的计算机中浮点数的存储都是遵循IEEE754/854标准,以二进制的科学计数法存放到内存中.

对于浮点数在计算机中有两种存储的精度,即单精度和双精度,单精度是32位,双精度是64位.

十进制小数转二进制小数 。

以float f = 5.25为例 。

整数部分:5 -> 101 。

小数部分:0.25 -> 0.01 。

最后结果:101.01 = 1.0101 * 2^2 。

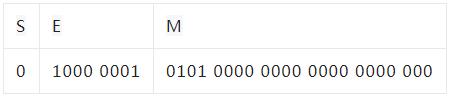

可见指数实际值为2,加上偏差码127,2 + 127 = 129,129的二进制为10000001B,因此不难得到,8.25在内存中的存储情况为

如果把这个值作为整型使用,将是一个很大的数字,是1084751872 。

把这个内存里面的值转为十进制小数就很简单了:

注意:

原文地址:https://www.toutiao.com/i6938718179405480462/ 。

最后此篇关于学C语言的看过来,最完整进制转换、整数和小数内存存储模型的文章就讲到这里了,如果你想了解更多关于学C语言的看过来,最完整进制转换、整数和小数内存存储模型的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

我在具有 2CPU 和 3.75GB 内存 (https://aws.amazon.com/ec2/instance-types/) 的 c3.large Amazon EC2 ubuntu 机器上运

我想通过用户空间中的mmap-ing并将地址发送到内核空间从用户空间写入VGA内存(视频内存,而不是缓冲区),我将使用pfn remap将这些mmap-ed地址映射到vga内存(我将通过 lspci

在 Mathematica 中,如果你想让一个函数记住它的值,它在语法上是很轻松的。例如,这是标准示例 - 斐波那契: fib[1] = 1 fib[2] = 1 fib[n_]:= fib[n] =

我读到动态内存是在运行时在堆上分配的,而静态内存是在编译时在堆栈上分配的,因为编译器知道在编译时必须分配多少内存。 考虑以下代码: int n; cin>>n; int a[n]; 如果仅在运行期间读

我是 Python 的新手,但我之前还不知道这一点。我在 for 循环中有一个基本程序,它从站点请求数据并将其保存到文本文件但是当我检查我的任务管理器时,我发现内存使用量只增加了?长时间运行时,这对我

我正在设计一组数学函数并在 CPU 和 GPU(使用 CUDA)版本中实现它们。 其中一些函数基于查找表。大多数表占用 4KB,其中一些占用更多。基于查找表的函数接受一个输入,选择查找表的一两个条目,

读入一个文件,内存被动态分配给一个字符串,文件内容将被放置在这里。这是在函数内部完成的,字符串作为 char **str 传递。 使用 gdb 我发现在行 **(str+i) = fgetc(aFil

我需要证实一个理论。我正在学习 JSP/Java。 在查看了一个现有的应用程序(我没有写)之后,我注意到一些我认为导致我们的性能问题的东西。或者至少是其中的一部分。 它是这样工作的: 1)用户打开搜索

n我想使用memoization缓存某些昂贵操作的结果,这样就不会一遍又一遍地计算它们。 两个memoise和 R.cache适合我的需要。但是,我发现缓存在调用之间并不可靠。 这是一个演示我看到的问

我目前正在分析一些 javascript shell 代码。这是该脚本中的一行: function having() { memory = memory; setTimeout("F0

我有一种情况,我想一次查询数据库,然后再将整个数据缓存在内存中。 我得到了内存中 Elasticsearch 的建议,我用谷歌搜索了它是什么,以及如何在自己的 spring boot 应用程序中实现它

我正在研究 Project Euler (http://projecteuler.net/problem=14) 的第 14 题。我正在尝试使用内存功能,以便将给定数字的序列长度保存为部分结果。我正在

所以,我一直在做 Java 内存/注意力游戏作业。我还没有达到我想要的程度,它只完成了一半,但我确实让 GUI 大部分工作了......直到我尝试向我的框架添加单选按钮。我认为问题可能是因为我将 JF

我一直在尝试使用 Flask-Cache 的 memoize 功能来仅返回 statusTS() 的缓存结果,除非在另一个请求中满足特定条件,然后删除缓存。 但它并没有被删除,并且 Jinja 模板仍

我对如何使用 & 运算符来减少内存感到非常困惑。 我可以回答下面的问题吗? clase C{ function B(&$a){ $this->a = &$a; $thi

在编写代码时,我遇到了一个有趣的问题。 我有一个 PersonPOJO,其 name 作为其 String 成员之一及其 getter 和 setter class PersonPOJO { priv

在此代码中 public class Base { int length, breadth, height; Base(int l, int b, int h) { l

Definition Structure padding is the process of aligning data members of the structure in accordance

在 JavaScript Ninja 的 secret 中,作者提出了以下方案,用于在没有闭包的情况下内存函数结果。他们通过利用函数是对象这一事实并在函数上定义一个属性来存储过去调用函数的结果来实现这

我正在尝试找出 map 消耗的 RAM 量。所以,我做了以下事情;- Map cr = crPair.collectAsMap(); // 200+ entries System.out.printl

我是一名优秀的程序员,十分优秀!