- html - 出于某种原因,IE8 对我的 Sass 文件中继承的 html5 CSS 不友好?

- JMeter 在响应断言中使用 span 标签的问题

- html - 在 :hover and :active? 上具有不同效果的 CSS 动画

- html - 相对于居中的 html 内容固定的 CSS 重复背景?

我刚看完the notes CNN 上的斯坦福 CS231n 和现场链接 demo ;然而,我不确定演示中的“激活”、“激活梯度”、“权重”和“权重梯度”指的是什么。 以下屏幕截图已从演示中复制。

混淆点1

我首先对输入层的“激活”指的是什么感到困惑。根据笔记,我认为激活层指的是 CNN 中的 RELU 层,它本质上是告诉 CNN 应该点亮哪些神经元(使用 RELU 函数)。我不确定这与输入层有什么关系,如下所示。此外,为什么显示两个图像?第一张图像似乎显示了提供给 CNN 的图像,但我无法区分第二张图像所显示的内容。

混淆点2

出于与上述相同的原因,我不确定此处显示的是什么“激活”和“激活梯度”。我认为“权重”显示了卷积层中 16 个过滤器的样子,但我不确定“权重梯度”应该显示什么。

混淆点3

我想我理解 RELU 层中的“激活”指的是什么。在输出图像的每个值(像素)都应用了 RELU 函数之后,它会显示所有 16 个过滤器的输出图像,因此为什么 16 个图像中的每一个都包含黑色(未激活)或某种白色阴影的像素(活性)。但是,我不明白“激活梯度”指的是什么。

混淆点4

也不明白这里的“激活梯度”指的是什么。

我希望通过理解这个演示,我会更了解 CNN

最佳答案

这个问题类似于this问题,但不完全。另外,here's a link到带有注释的 ConvNetJS 示例代码( here's a link 到完整文档)。您可以查看代码本身演示页面顶部的代码。

安 activation function是一个函数,它接受一些输入并根据它是否达到某个“阈值”(这特定于每个不同的激活函数)输出一些值。这来自于神经元的工作方式,它们接受一些电输入,并且只有在达到某个阈值时才会激活。

混淆点1:第一组图像显示原始输入图像(左侧彩色图像),两幅图像的右侧是经过激活函数后的输出。您不应该真正能够解释第二张图像,因为它正在通过网络进行非线性和感知随机非线性变换。

混淆点2:与前一点类似,“激活”是图像像素信息传入的函数。 A gradient本质上是激活函数的斜率。它看起来更稀疏(即颜色只出现在某些地方),因为它显示了图像中每个节点关注的可能区域。例如,第一行的第 6 张图像在左下角有一些颜色;这可能表明激活函数发生了很大的变化,以表明该领域有一些有趣的事情。此 article可能会消除一些对权重和激活函数的混淆。和 this article有一些关于每一步正在做什么的非常棒的视觉效果。

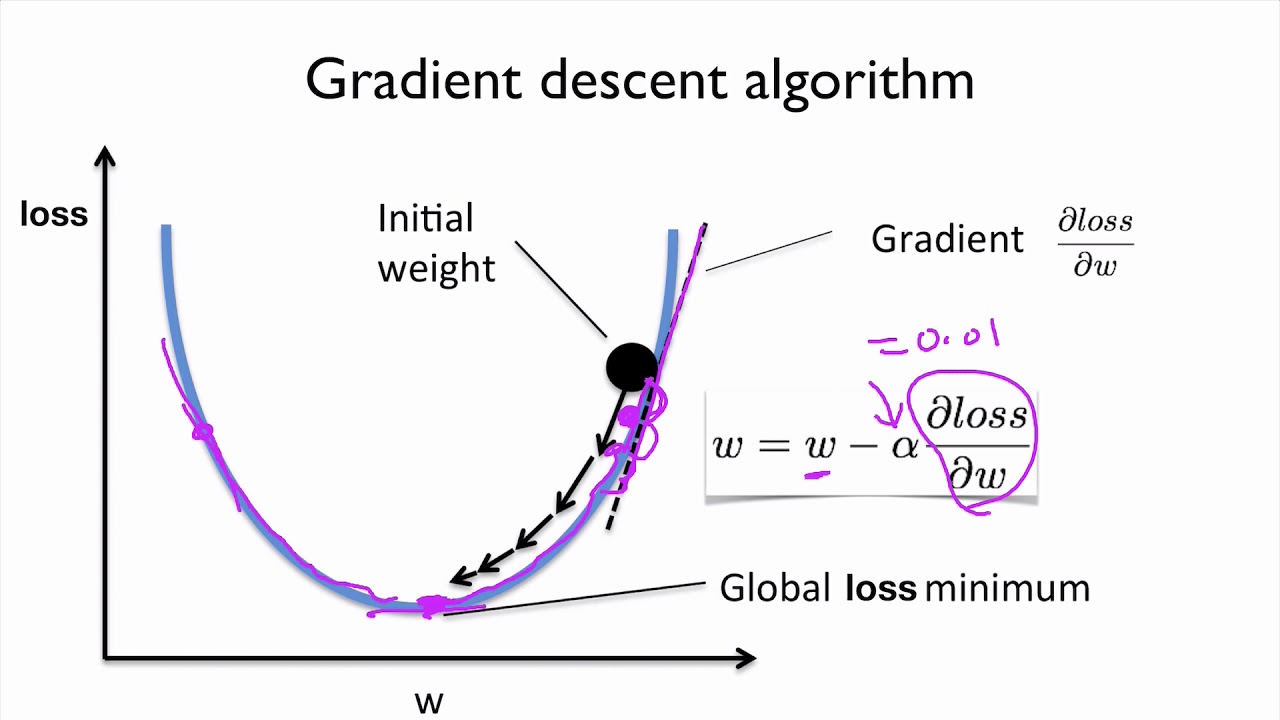

混淆点3:起初这让我感到困惑,因为如果你考虑 ReLu function ,您将看到它对于正 x 的斜率为 1和 0 其他地方。因此,采用激活函数(在这种情况下为 ReLu)的梯度(或斜率)是没有意义的。 “最大激活”和“最小激活”值对 ReLu 有意义:最小值为零,最大值是最大值。这直接来自 ReLu 的定义。为了解释梯度值,我怀疑一些高斯噪声和 bias term of 0.1已添加到这些值中。 编辑:梯度是指如下所示的成本权重曲线的斜率。 y 轴是损失值或使用权重值计算的误差 w 在 x 轴上。

图片来源https://i.ytimg.com/vi/b4Vyma9wPHo/maxresdefault.jpg

混淆点4:看上面。

关于neural-network - 卷积神经网络中的 "Activations"、 "Activation Gradients"、 "Weights"和 "Weight Gradients"是什么?,我们在Stack Overflow上找到一个类似的问题: https://stackoverflow.com/questions/57038055/

我是一名优秀的程序员,十分优秀!