- Java锁的逻辑(结合对象头和ObjectMonitor)

- 还在用饼状图?来瞧瞧这些炫酷的百分比可视化新图形(附代码实现)⛵

- 自动注册实体类到EntityFrameworkCore上下文,并适配ABP及ABPVNext

- 基于Sklearn机器学习代码实战

每一周,我们的同事都会向社区的成员们发布一些关于 Hugging Face 相关的更新,包括我们的产品和平台更新、社区活动、学习资源和内容更新、开源库和模型更新等,我们将其称之为「Hugging News」,本期 Hugging News 有哪些有趣的消息,快来看看吧! 。

我们的全球 Hugging Face 社区正在举办一个使用 KerasCV 训练 Dreambooth 模型的活动,时间是 3 月 7 日到 4 月 1 日。欢迎大家参加! 。

同时不要忘记参加我们中国社区 与 PaddlePaddle 联合的举办的微调黑客松 ,以及 与百姓 AI 联合举办的聊天机器人黑客松活动 .

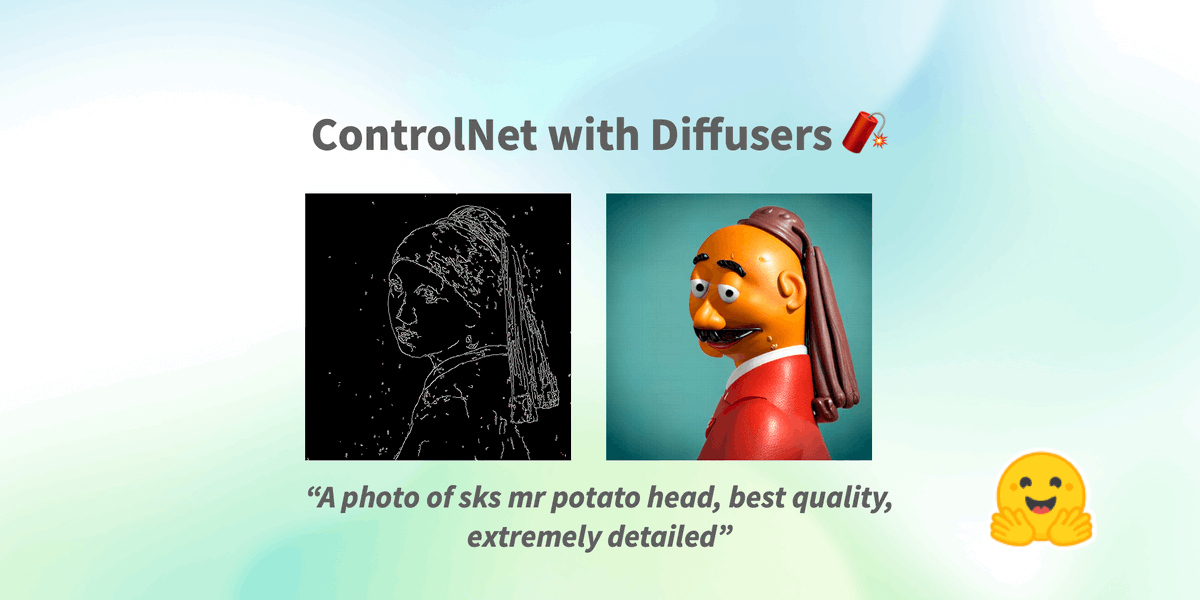

感谢社区贡献者 Takuma Mori (@takuma104) 的巨大贡献,帮助将 ControlNet 集成到 Diffusers 中,Diffusers 现已支持使用 ControlNet。类似 Diffusers 中的其他 Pipeline,Diffusers 同样为 ControlNet 提供了 StableDiffusionControlNetPipeline 供用户使用。 StableDiffusionControlNetPipeline 的核心是 controlnet 参数,它接收用户指定的训练过的 ControlNetModel 实例作为输入,同时保持扩散模型的预训练权重不变.

更多详细情况和使用说明,请查看我们的推文: 《使用 🧨 Diffusers 实现 ControlNet 高速推理》 .

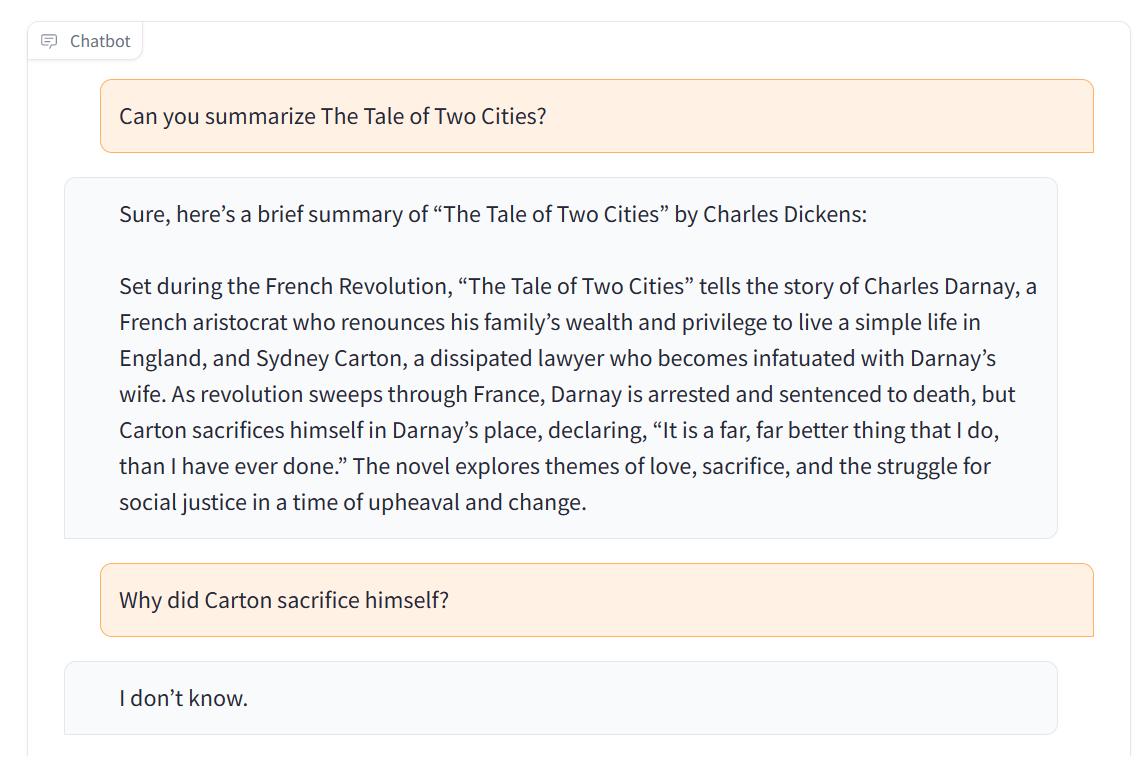

除了聊天机器人组件,3.20 版的 Gradio 还加入了很多图像展示、下拉菜单、滑块等 UI/UX 的改进。查看 Gradio 官网了解更多: https://gradio.app/ 。

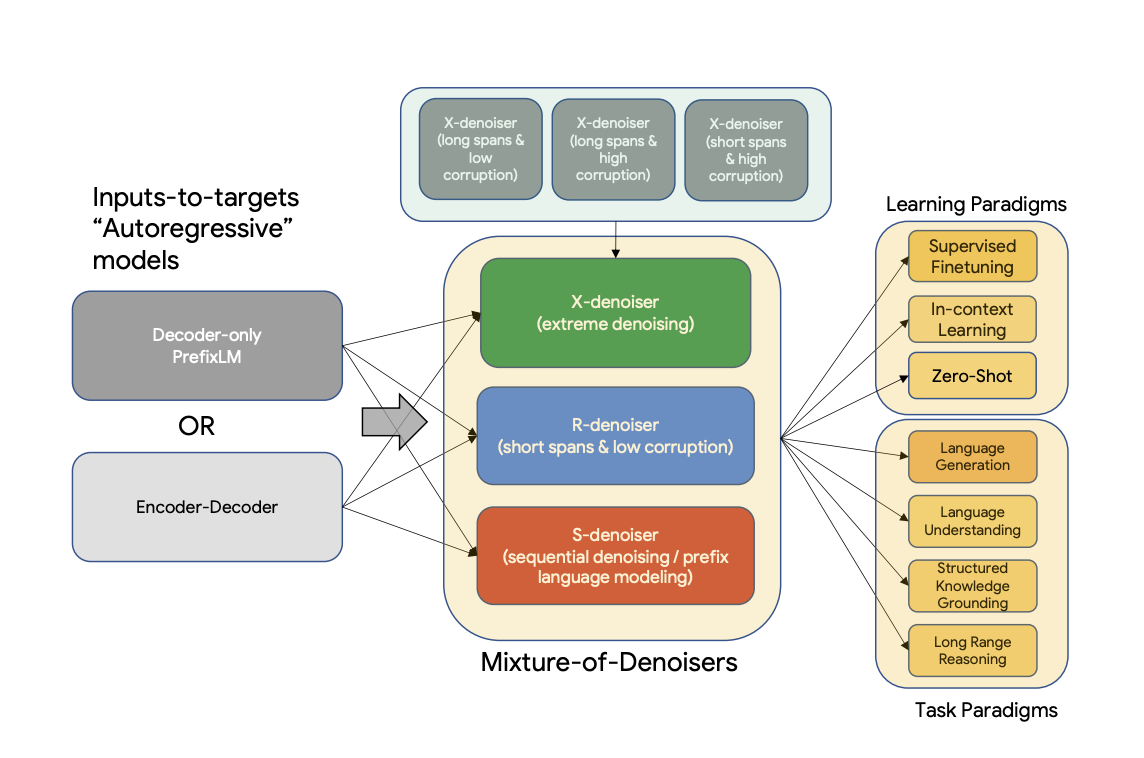

Google 开源的预训练大语言模型 Flan-UL2 已经发布到 Hugging Face Hub,欢迎来这里了解更多: https://hf.co/google/flan-ul2 。

使用 JavaScript 与 Hugging Face 交互,欢迎体验和贡献! https://github.com/huggingface/huggingface.js 。

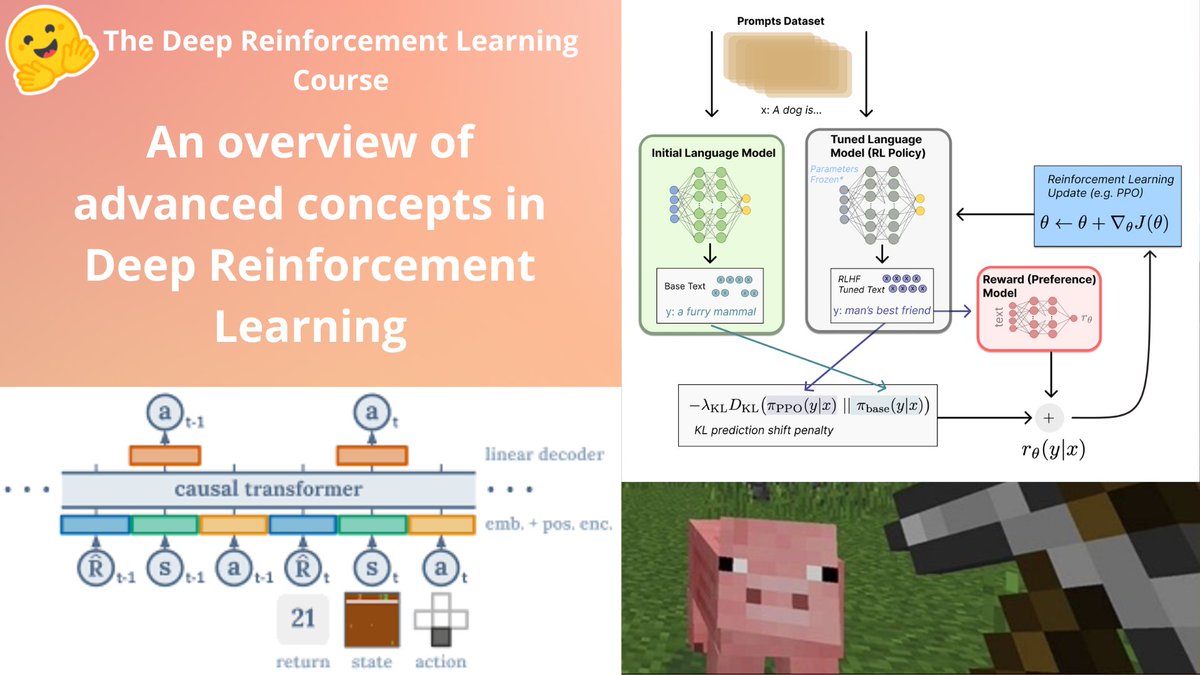

最后单元内容包括:基于模型的强化学习、离线与在线强化学习、RLHF(ChatGPT 背后的技术)、决策转换器、RL 中的语言模型等,快来学习吧! https://hf.co/deep-rl-course/unitbonus3/introduction 。

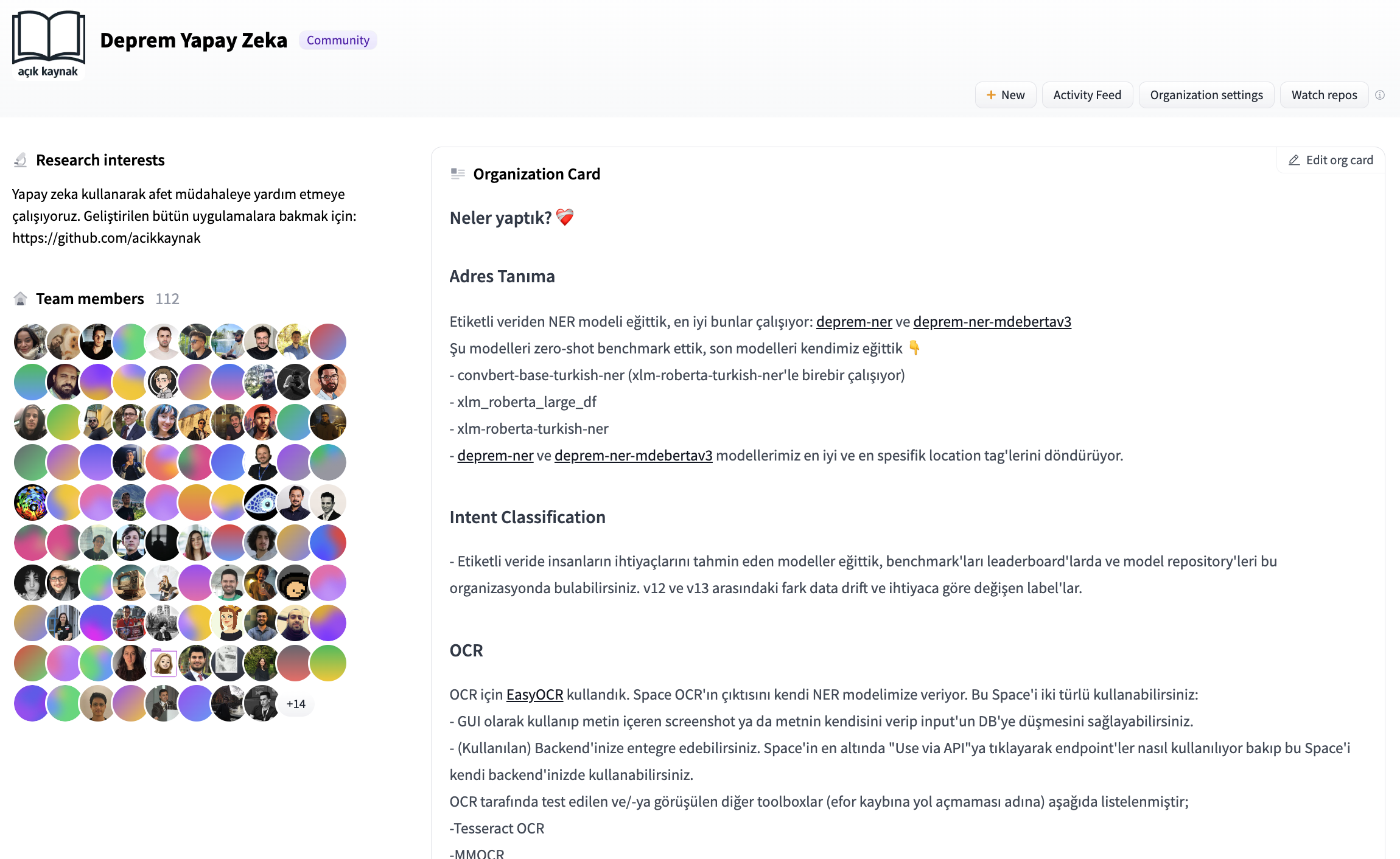

今年 2 月 6 日,土耳其东南部发生两次强烈地震,造成 4.2 万人死亡、12 万人受伤。一群开发者迅速创建了一个名为「灾难地图 (afetharita)」的应用,帮助搜救团队和志愿者找到幸存者。两位 Hugging Face 的同事 Merve 和 Alara 也是他们中的一份子,并帮助开设了一个 Hugging Face 组织帐户,通过 PR 进行协作,以构建基于 ML 的应用程序来接收和处理信息.

我们使用 Hugging Face Hub 上的机器学习模型,从求救者的社交媒体信息中提取地址和需求。通过与其他团队的合作,志愿者们还开发了一套用于评估地震灾区建筑和基础设施损害的遥感应用,从而为未来的搜救行动提供支持.

受限于文章篇幅,如果你想了解更细节的内容,请阅读这篇博文: https://hf.co/blog/using-ml-for-disasters 。

ChatGLM-6B 是一个由清华大学知识工程研究室开源的、支持中英双语问答的对话语言模型,基于 General Language Model (GLM) 架构,具有 62 亿参数。结合模型量化技术,用户可以在消费级的显卡上进行本地部署(INT4 量化级别下最低只需 6GB 显存).

ChatGLM-6B 使用了和 ChatGLM 相同的技术,针对中文问答和对话进行了优化。经过约 1T 标识符的中英双语训练,辅以监督微调、反馈自助、人类反馈强化学习等技术的加持,62 亿参数的 ChatGLM-6B 已经能生成相当符合人类偏好的回答.

以上就是本周的 Hugging News,这里给我们的小编阿东一个大大的拥抱,并祝大家度过一个幸福愉快的周末! 。

最后此篇关于HuggingNews#0317:ChatGLM会成为HF趋势榜的第一名吗?的文章就讲到这里了,如果你想了解更多关于HuggingNews#0317:ChatGLM会成为HF趋势榜的第一名吗?的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

关闭。这个问题不符合Stack Overflow guidelines .它目前不接受答案。 这个问题似乎与 help center 中定义的范围内的编程无关。 . 关闭 4 年前。 Improve

我有一个名为 LOGENTRY 的简单表,其中包含名为“DATE”和“COST”的字段。示例: +--------------+-------+ | DATE | COST | +-

我有一个每小时运行一次的 cron 作业。 cron 作业向表 'update' 添加一条记录 table - 'update' update_id (primary) timestamp 和 将我网

我正在使用 Bokeh 制作趋势图,显示概念的流行程度如何随时间变化。我使用了 brewer 示例 ( https://docs.bokeh.org/en/latest/docs/gallery/st

所以我想做的是制作一个趋势算法,我需要有关 SQL 代码的帮助,因为我无法让它运行。 该算法包含三个方面:(我对更好的趋势算法的想法完全开放) 1.Plays during 24h / Total p

关闭。这个问题不满足Stack Overflow guidelines .它目前不接受答案。 想改善这个问题吗?更新问题,使其成为 on-topic对于堆栈溢出。 7年前关闭。 Improve thi

开发 Twitter Connect 应用程序并通过 URL 获取趋势: https://api.twitter.com/1.1/trends/closest.json?lat=42&long=36

我对时间序列异常检测非常陌生,所以我的问题对你们中的一些人来说可能是显而易见的。今天,我使用 lstm 和聚类技术来检测时间序列上的异常,但这些方法无法识别随着时间的推移慢慢恶化的异常(我认为这称为趋

我正在寻求[博客]的帮助:http://www.androidhive.info/2012/01/android-json-parsing-tutorial/解析 twitter 趋势 JSON 文件

我有一个网站,人们可以在其中添加他们喜欢的电视节目。 我想要一些趋势统计数据。示例: (1 个不变)生活大爆炸 (上周第 3 次)老爸老妈浪漫史 (上周第 2 个)房子 (上周第 30 位,上涨 40

我有一个带有 DatetimeIndex 和 ohlcv 股票报价列的 pandas Dataframe。我想提取满足特定阈值的价格波动/趋势:大于 0.3 美元的上升趋势/趋势和超过 -0.3 美元

尝试仅访问多伦多趋势的“名称”部分。到目前为止我有这个但是它给我错误: toronto = t.get_place_trends(id=4118) trend_array = [] for trend

已结束。此问题正在寻求书籍、工具、软件库等的推荐。它不满足Stack Overflow guidelines 。目前不接受答案。 我们不允许提出寻求书籍、工具、软件库等推荐的问题。您可以编辑问题,以便

我尝试在我的网络应用程序中实现 Google 趋势。这是我的代码: using (var client = new WebClient()) { var us

我最近将 Junit 和 Emma 集成到 CruiseControl (CC) 中,因此它可以为每个构建创建漂亮的报告。我想根据 Emma 提供的一些信息(例如覆盖率百分比数字和摘要)查看一些趋势图

我正在尝试将谷歌趋势嵌入到我的代码 vuejs 中,但我找不到任何关于如何做到这一点的信息。 我尝试一下: export default { created(){ posts

我对此有点新手...基本上我需要运行一个脚本来从谷歌趋势下载.csv 文件。我按照这个reference写了下面的代码,代码如下: HttpClient client = new Defau

我正在使用非官方 Google Trends API ( https://github.com/GeneralMills/pytrends#trend ) 编写代码,但是在几乎 10 个请求之后,我收

我一直使用破折号作为 css 类和 ID 名称的分隔符: .about-us .car-pricing-guide 我见过网站使用多个下划线 __ .home__content 此外,我还看到了 2

很抱歉提出这个问题,但我已经在这个问题上停留了一段时间。 基本上我正在尝试列出一个列表: numbers=[1, 2, -1, -2, 4, 5] 并将此列表子集化为显示正/负运动(或趋势)的列表列表

我是一名优秀的程序员,十分优秀!