- Java锁的逻辑(结合对象头和ObjectMonitor)

- 还在用饼状图?来瞧瞧这些炫酷的百分比可视化新图形(附代码实现)⛵

- 自动注册实体类到EntityFrameworkCore上下文,并适配ABP及ABPVNext

- 基于Sklearn机器学习代码实战

小伙伴们快看过来!这是一款全新打造的 ⚔️ AI vs. AI ⚔️——深度强化学习多智能体竞赛系统 .

这个工具托管在 Space 上,允许我们创建多智能体竞赛。它包含三个元素

然后,当用户将一个训练好的模型推到 Hub 时, 它会获取评估和排名 。得益于此,我们可以在多智能体环境中对你的智能体与其他智能体进行评估.

除了作为一个托管多智能体竞赛的有用工具,我们认为这个工具在多智能体设置中可以成为一个 健壮的评估技术 。通过与许多策略对抗,你的智能体将根据广泛的行为进行评估。这应该能让你很好地了解你的策略的质量.

让我们看看它在我们的第一个竞赛托管: SoccerTwos Challenge 上是如何工作的.

AI vs. AI 是一个在 Hugging Face 上开发的开源工具, 对多智能体环境下强化学习模型的强度进行排名 .

其思想是通过让模型之间持续比赛,并使用比赛结果来评估它们与所有其他模型相比的表现,从而在不需要经典指标的情况下了解它们的策略质量,从而获得 对技能的相对衡量,而不是客观衡量 .

对于一个给定的任务或环境,提交的智能体越多, 评分就越有代表性 .

为了在一个竞争的环境里基于比赛结果获得评分,我们决定根据 ELO 评分系统进行排名.

游戏的核心理念是,在比赛结束后,双方玩家的评分都会根据比赛结果和他们在比赛前的评分进行更新。当一个拥有高评分的用户打败一个拥有低排名的用户时,他们便不会获得太多分数。同样,在这种情况下,输家也不会损失很多分.

相反地,如果一个低评级的玩家击败了一个高评级的玩家,这将对他们的评级产生更显著的影响.

在我们的环境中,我们尽量保持系统的简单性,不根据玩家的初始评分来改变获得或失去的数量。因此,收益和损失总是完全相反的 (例如+10 / -10),平均 ELO 评分将保持在初始评分不变。选择一个1200 ELO 评分启动完全是任意的.

如果你想了解更多关于 ELO 的信息并且查看一些计算示例,我们在 深度强化学习课程 里写了一个解释.

使用此评级,可以 自动在具有可对比强度的模型之间进行匹配 。你可以有多种方法来创建匹配系统,但在这里我们决定保持它相当简单,同时保证比赛的多样性最小,并保持大多数比赛的对手评分相当接近.

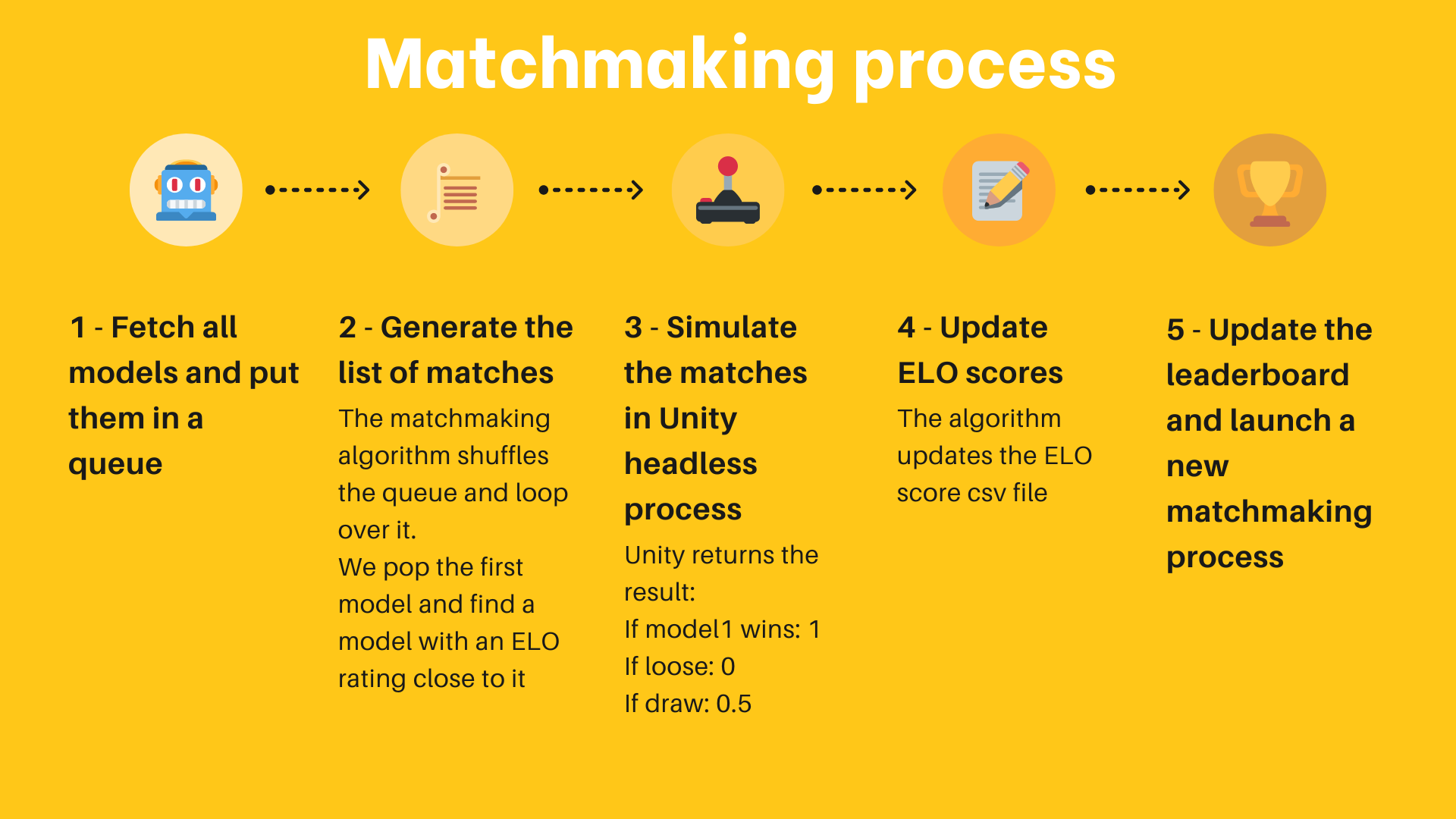

以下是该算法的工作原理

为了持续运行这个配对过程,我们使用 免费的 Hug Face Spaces 硬件和一个 Scheduler 来作为后台任务持续运行这个配对过程.

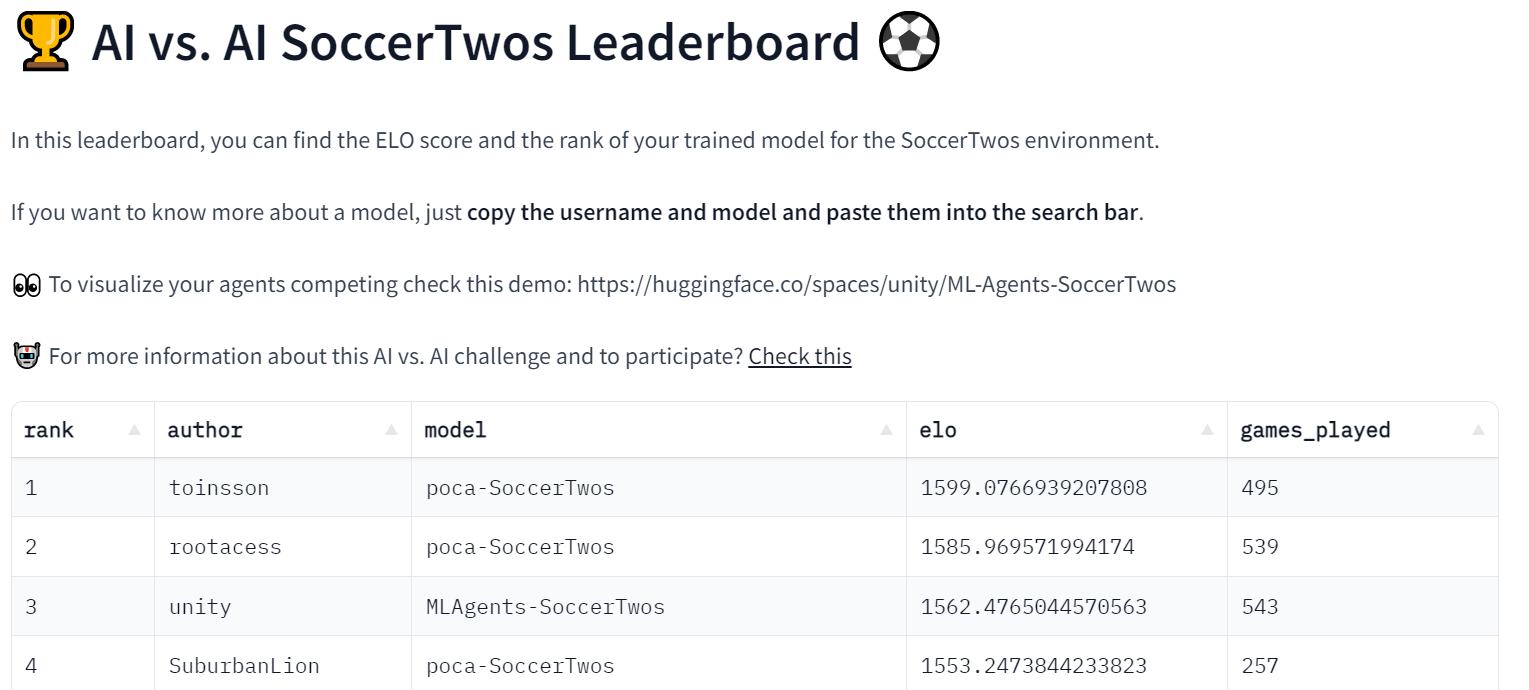

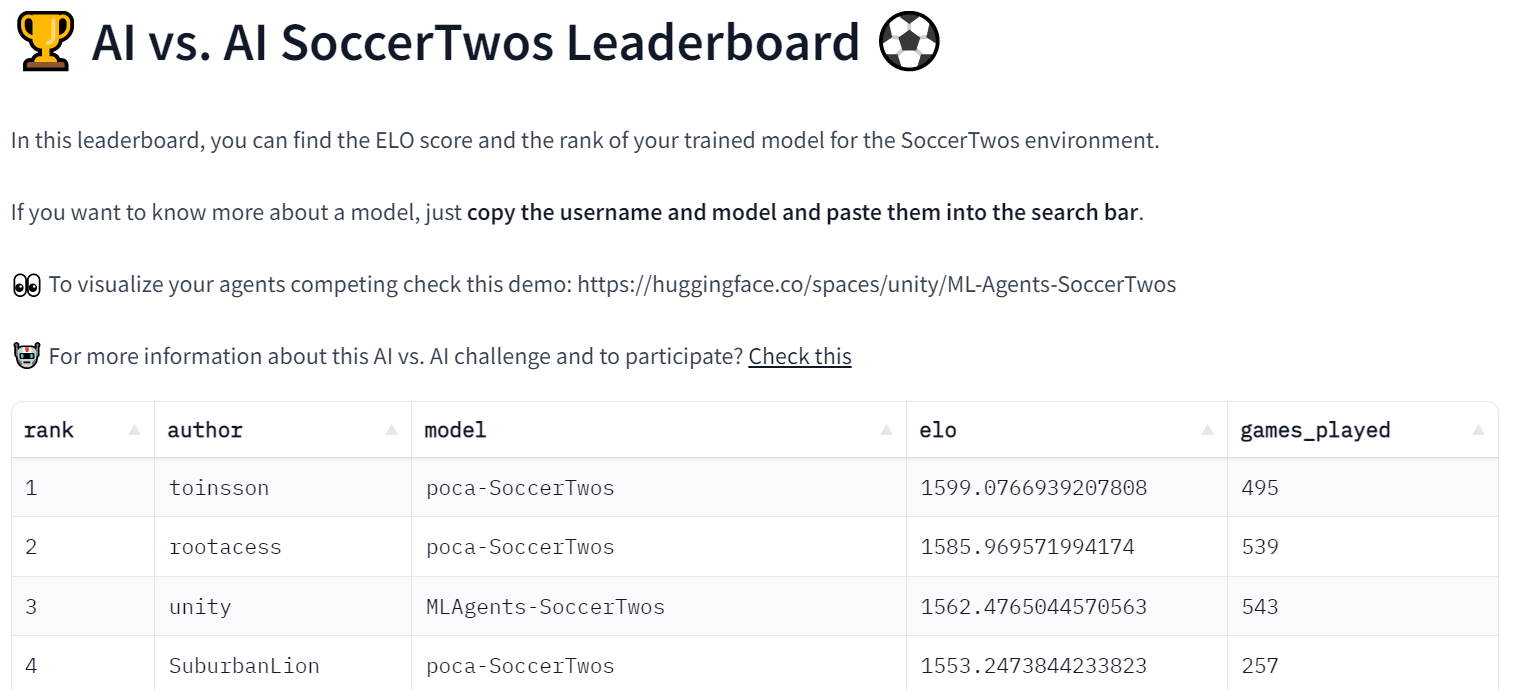

Space 还用于获取每个以及比赛过的模型的 ELO 评分,并显示一个排行榜, 每个人都可以检查模型的进度 .

该过程通常使用几个 Hugging Face Datasets 来提供数据持久性 (这里是匹配历史和模型评分).

因为这个过程也保存了比赛的历史,因此可以精确地看到任意给定模型的结果。例如,这可以让你检查为什么你的模型与另一个模型搏斗,最显著的是使用另一个演示 Space 来可视化匹配,就像 这个 .

目前, 这个实验是在 MLAgent 环境 SoccerTwos 下进行的,用于 Hugging Face 深度强化学习课程 ,然而,这个过程和实现通常是 环境无关的,可以用来免费评估广泛的对抗性多智能体设置 .

当然,需要再次提醒的是,此评估是提交的智能体实力之间的相对评分,评分本身 与其他指标相比没有客观意义 。它只表示一个模型与模型池中其他模型相对的好坏。尽管如此,如果有足够大且多样化的模型池 (以及足够多的比赛),这种评估将成为表示模型一般性能的可靠方法.

这个挑战是我们免费的深度强化学习课程的第 7 单元。它开始于 2 月 1 日,计划于 4 月 30 日结束.

如果你感兴趣, 你不必参加课程就可以加入这个比赛。你可以在 这里 开始 。

在这个单元,读者通过训练一个 2 vs 2 足球队 学习多智能体强化学习 (MARL) 的基础.

用到的环境是 Unity ML-Agents 团队 制作的。这个比赛的目标是简单的: 你的队伍需要进一个球。要做到这一点,他们需要击败对手的团队,并与队友合作.

除了排行榜,我们创建了一个 Space 演示,人们可以 选择两个队伍并可视化它们的比赛 .

这个实验进展顺利,因为我们已经在 排行榜 上有 48 个模型了.

我们也创造了一个叫做 ai-vs-ai-competition 的 discord 频道,人们可以与他人交流并分享建议.

因为我们开发的这个工具是 环境无关的 ,在未来我们想用 PettingZoo 举办更多的挑战赛和多智能体环境。如果你有一些想做的环境或者挑战赛, 不要犹豫,与我们联系 .

在未来,我们将用我们创造的工具和环境来举办多个多智能体比赛,例如 SnowballFight.

除了称为一个举办多智能体比赛的有用工具,我们考虑这个工具也可以在多智能体设置中成为 一项健壮的评估技术: 通过与许多策略对抗,你的智能体将根据广泛的行为进行评估,并且你将很好地了解你的策略的质量 .

保持联系的最佳方式是 加入我们的 Discord 与我们和社区进行交流.

引用 。

引用: 如果你发现这对你的学术工作是有用的,请考虑引用我们的工作

Cochet, Simonini, "Introducing AI vs. AI a deep reinforcement learning multi-agents competition system", Hugging Face Blog, 2023.

BibTeX 引用

@article{cochet-simonini2023,

author = {Cochet, Carl and Simonini, Thomas},

title = {Introducing AI vs. AI a deep reinforcement learning multi-agents competition system},

journal = {Hugging Face Blog},

year = {2023},

note = {https://huggingface.co/blog/aivsai},

}

英文原文: https://huggingface.co/blog/aivsai 。

作者: Carl Cochet、Thomas Simonini 。

译者: AIboy1993 (李旭东) 。

审校、排版: zhongdongy (阿东) 。

最后此篇关于AI大战AI,一个深度强化学习多智能体竞赛系统的文章就讲到这里了,如果你想了解更多关于AI大战AI,一个深度强化学习多智能体竞赛系统的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

更新:下面提到的stackoverflow给出了另一种解决方案,即导入json并用正确格式的数据替换文本。我现在试图看看如何适应给定的格式,它看起来像这样: { "text" : "use

有谁知道三者之间的具体区别和功能,或者作为开发人员是否有更多功能/更灵活地使用? 最佳答案 wit.ai 与 Dialogflow 与 luis.ai ╔═══════════════════════

我知道 Wit.ai 引擎可以通过手动验证案例来训练,但是有没有办法用一组定义的输入和输出来训练它? 最佳答案 您可能可以查看其中一个应用程序的导出格式并对其进行调整以导入新应用程序。 https:/

来自 wit.ai 团队的一些人请回答这个 我们计划将 wit.ai 用于商业目的。有使用政策吗?请提供一些注意事项指南。此外,这项服务将来是否也是免费的,还是您计划推出企业版? 主要是 API 命中

我需要添加一个确认实体,以便在对话框流 (api.ai) 中的某个操作的参数中得到"is"或“取消”。假设用户正在购买咖啡,我会询问有关咖啡和数量的详细信息,最后我需要确认,我应该向哪个实体申请?任何

谁能帮我解决上面的问题。我们必须在数组 (a1,a2),(a1,a3),(a1,a4).... 等中找到元素的组合,然后选择满足条件 (ai*aj) <= max 的组合(A) 其中 A 是数组并返回

我正在尝试训练我的 Wit.ai 机器人以识别某人的名字。我不太确定我是否完全理解 NLP 的工作原理,所以我会给你一个例子。 我定义了很多表达,比如“我的名字是XXXX”、“大家都叫我XXXX” 在

我想知道是否存在一个网站,人们可以上传他们的 AI 在不同的棋盘游戏中相互竞争:国际象棋、五子棋等。 该站点将接受程序的源代码(以某种通用语言编写)、对其进行编译并相互运行程序。所有程序都必须使用一些

大家好,我是程序员幽鬼。 你想为后代开发一个令人难以置信的应用程序,你想到的第一件事——人工智能!还有什么比模仿人类智能的机器更令人着迷的呢?如果你期待打破刻板印象并准备推出出色的 AI 应用

我在 Application Insights Analytics 中创建了几个查询来获取我想要的图表。 示例: customEvents | where timestamp >= ago(31d)

我似乎无法让这个请求生效: https://wit.ai/docs/http/20160526#delete--entities-:entity-id-values-link 我已经设置了一个值为“C

我正在尝试在 wit.ai 中编写示例应用程序。我使用在 https://wit.ai/docs/quickstart 中显示的 node.js 客户端跟随快速启动应用程序。 .那里显示的示例只有一个

在 api.i(dialogflow) 中,我想获取用户的输入,如姓名、年龄、邮件等,并使用 PHP 将它们存储在我的 MYSQL 数据库中。 如何在对话流中生成我的代理的公共(public) API

我目前正在与 Wit.ai 合作 webpage in CodePen.io .我想知道是否可以使用 HTTP API 检索 Wit.ai 机器人的文本响应(“Bot says”)。 例如:如果用户要

我接到了一项任务,要编写一个由人类玩家和 AI 玩家组成的 NIM 游戏。游戏是“Misere”(最后一个必须拿起一根棍子的人输了)。 AI 应该使用 Minimax 算法,但它正在采取使其输得更快的

为了通过 shell 从端点取消部署模型,我必须指定 deployed-model-id如 gcloud ai endpoints undeploy-model 中所述 我如何获得这个已部署的模型 I

我在谷歌的 Vertex AI 中运行自定义训练作业。执行自定义作业的简单 gcloud 命令将使用类似于以下语法的内容(可以查看命令的完整文档 here ): gcloud beta ai cust

Wit AI project 在他们的 Converse 功能中添加了一个名为 Story 的新概念。有没有办法通过 HTTP API 管理(创建/编辑/验证)这些 Wit AI 故事? 最佳答案 W

我想为 Google 智能助理部署一个应用。但是,我想使用不同的 AI 后端而不是 api.ai。 有人知道这是否可能吗?如何? 或者如果我想使用 Google 智能助理,我会被 api.ai 困住吗

我的项目有一个依赖项,需要 python v3.6+。因此,它会在通过 pip 在 python 3 内核中安装时抛出错误,因为 AI Platform Notebooks 默认附带 v3.5。如何使

我是一名优秀的程序员,十分优秀!