- Java锁的逻辑(结合对象头和ObjectMonitor)

- 还在用饼状图?来瞧瞧这些炫酷的百分比可视化新图形(附代码实现)⛵

- 自动注册实体类到EntityFrameworkCore上下文,并适配ABP及ABPVNext

- 基于Sklearn机器学习代码实战

文件有一个stat命令 。

文件有一个vim命令 。

分类 。

File 文件名

Size 文件大小(字节)

Blocks 文件使用的数据块总数

IO Block 数据块的大小

regular file:文件类型(常规文件)

Device 设备编号

Inode 文件所在的Inode

Links 硬链接次数

Access 权限

Uid 属主id/用户

Gid 属组id/组名

Access Time:简写为atime,表示文件的访问时间。当文件内容被访问时,更新这个时间

Modify Time:简写为mtime,表示文件内容的修改时间,当文件的数据内容被修改时,更新这个时间。

Change Time:简写为ctime,表示文件的状态时间,当文件的状态被修改时,更新这个时间,例如文件的链接数,大小,权限,Blocks数。

文件数据 。

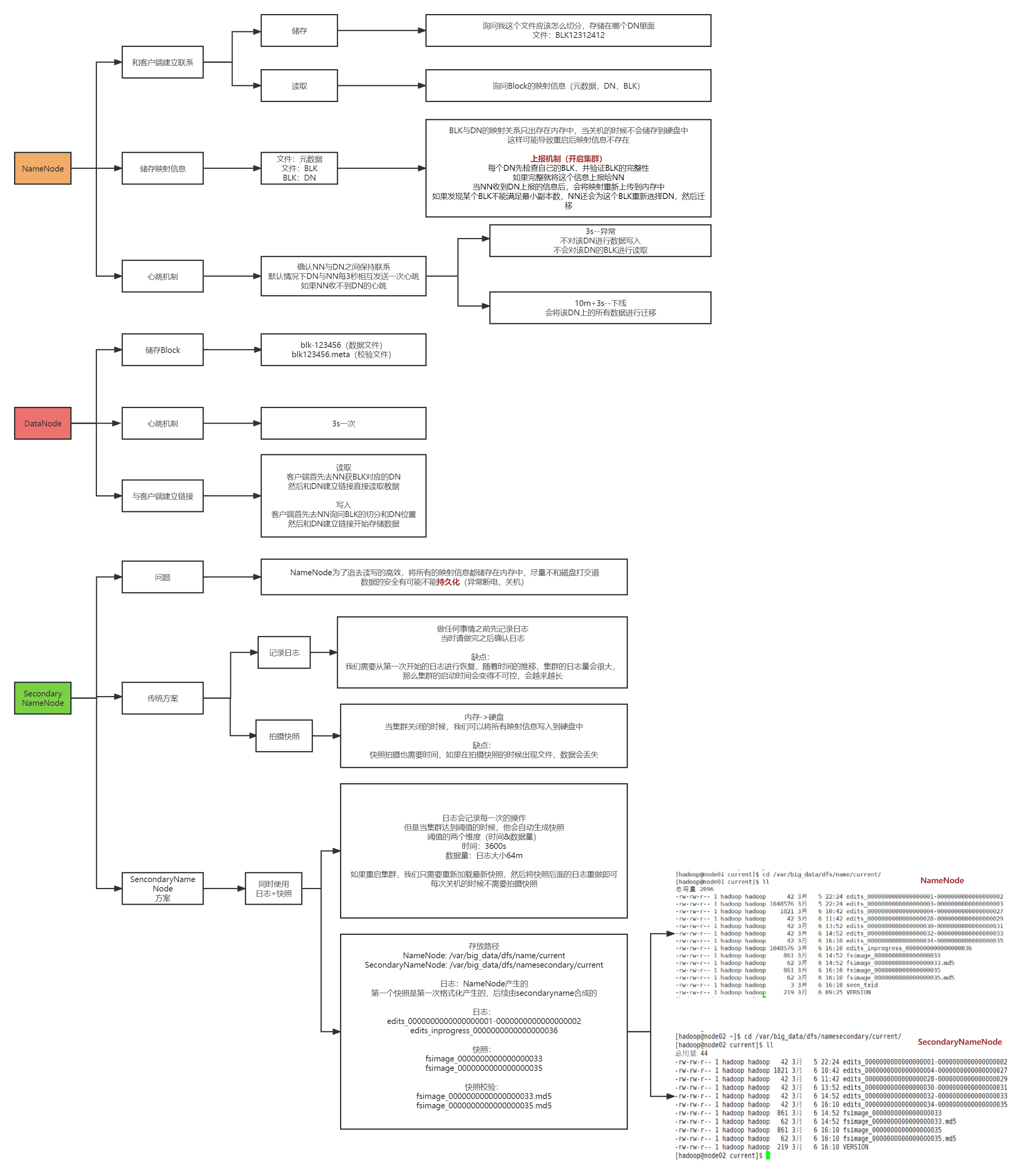

接受客户端的读写服务 。

NameNode存放文件与Block的映射关系 。

DataNode存放Block与DataNode的映射关系 。

保存文件的元数据信息 。

文件的归属 。

文件的权限 。

文件的大小时间 。

lock信息,但是block的位置信息不会持久化,需要每次开启集群的时候DN上报 。

收集Block的信息 。

系统启动时 。

集群运行中 。

<property>

<description>Determines datanode heartbeat interval in seconds.</description>

<name>dfs.heartbeat.interval</name>

<value>3</value>

</property>

<property>

<name>heartbeat.recheck.interval</name>

<value>300000</value>

</property>

如果DN超过三秒没有心跳,就认为DN出现异常 。

- 不会让新的数据读写到DataNode

- 客户访问的时候不提供异常结点的地址

如果DN超过10分钟+30秒没有心跳,那么NN会将当前DN存储的数据转存到其他节点 。

超时时长的计算公式为:

timeout = 2 * heartbeat.recheck.interval + 10 * dfs.heartbeat.interval.

而默认的heartbeat.recheck.interval 大小为5分钟,dfs.heartbeat.interval默认为3秒.

NameNode为了效率,将所有的操作都在内存中完成 。

NameNode不会和磁盘进行任何的数据交换 。

问题

存放的是文件的数据信息和验证文件完整性的校验信息 。

数据会存放在硬盘上 。

1m=1条元数据 1G=1条元数据 。

NameNode非常排斥存储小文件,一般小文件在存储之前需要进行压缩 。

汇报 。

启动时 。

运行中 。

当客户端读写数据的时候,首先去NN查询file与block与dn的映射 。

日志机制 。

做任何操作之前先记录日志 。

当NN下次启动的时候,只需要重新按照以前的日志“重做”一遍即可缺点 。

缺点 。

优点 。

拍摄快照 。

我们可以将内存中的数据写出到硬盘上 。

启动时还可以将硬盘上的数据写回到内存中 。

缺点 。

关机时间过长 。

如果是异常关机,数据还在内存中,没法写入到硬盘 。

如果写出频率过高,导致内存使用效率低(stop the world) JVM 。

优点 。

解决思路(日志edits+快照fsimage) 。

让日志大小可控 。

NameNode文件目录 。

解决方案 。

当我们启动一个集群的时候,会产生四个文件 。

edits_0000000000000000001 。

fsimage_00000000000000000 。

seen_txid 。

VERSION 。

我们每次操作都会记录日志 -->edits_inprogress-000000001 。

随和时间的推移,日志文件会越来越大,当达到阈值的时候(64M 或 3600秒) 。

dfs.namenode.checkpoint.period 每隔多久做一次checkpoint ,默认3600s

dfs.namenode.checkpoint.txns 每隔多少操作次数做一次checkpoint,默认1000000次

fs.namenode.checkpoint.check.period 每个多久检查一次操作次数,默认60s

会生成新的日志文件 。

edits_inprogress-000000001 -->edits_0000001 。

创建新的日志文件edits_inprogress-0000000016 。

最后此篇关于Hadoop节点的分类与作用的文章就讲到这里了,如果你想了解更多关于Hadoop节点的分类与作用的内容请搜索CFSDN的文章或继续浏览相关文章,希望大家以后支持我的博客! 。

我们有数据(此时未分配)要转换/聚合/透视到 wazoo。 我在 www 上看了看,我问的所有答案都指向 hadoop 可扩展、运行便宜(没有 SQL 服务器机器和许可证)、快速(如果你有足够的数据)

这很明显,我们都同意我们可以将 HDFS + YARN + MapReduce 称为 Hadoop。但是,Hadoop 生态系统中的其他不同组合和其他产品会怎样? 例如,HDFS + YARN + S

如果 es-hadoop 只是连接到 HDFS 的 Hadoop 连接器,它如何支持 Hadoop 分析? 最佳答案 我假设您指的是 this project .在这种情况下,ES Hadoop 项目

看完this和 this论文,我决定我想在 MapReduce 上为大型数据集实现分布式体积渲染设置作为我的本科论文工作。 Hadoop 是一个合理的选择吗? Java 不会扼杀一些性能提升或使与 C

我一直在尝试查找有关如何通过命令行提交 hadoop 作业的信息。 我知道命令 - hadoop jar jar-file 主类输入输出 还有另一个命令,我正在尝试查找有关它的信息,但未能找到 - h

Hadoop 服务器在 Kubernetes 中。而Hadoop客户端位于外网。所以我尝试使用 kubernetes-service 来使用 Hadoop 服务器。但是 hadoop fs -put

有没有人遇到奇怪的环境问题,在调用 hadoop 命令时被迫使用 SU 而不是 SUDO? sudo su -c 'hadoop fs -ls /' hdfs Found 4 itemsdrwxr-x

在更改 mapred-site.xml 中的属性后,我给出了一个 tar.bz2 文件、.gz 和 tar.gz 文件作为输入。以上似乎都没有奏效。我假设这里发生的是 hadoop 作为输入读取的记录

如何在 Hadoop Pipes 中获取正在 hadoop 映射器 中执行的输入文件 名称? 我可以很容易地在基于 java 的 map reducer 中获取文件名,比如 FileSplit fil

我想使用 MapReduce 方法分析连续的数据流(通过 HTTP 访问),因此我一直在研究 Apache Hadoop。不幸的是,Hadoop 似乎期望以固定大小的输入文件开始作业,而不是能够在新数

名称节点可以执行任务吗?默认情况下,任务在集群的数据节点上执行。 最佳答案 假设您正在询问MapReduce ... 使用YARN,MapReduce任务在应用程序主数据库中执行,而不是在nameno

我有一个关系A包含 (zip-code). 我还有另一个关系B包含 (name:gender:zip-code) (x:m:1234) (y:f:1234) (z:m:1245) (s:f:1235)

我是hadoop地区的新手。您能帮我负责(k2,list[v2,v2,v2...])形式的输出(意味着将键及其所有关联值组合在一起)的责任是吗? 谢谢。 最佳答案 这是Hadoop的MapReduce

因此,我一直在尝试编写一个hadoop程序,该程序将输入作为一个包含许多文件的文件,并且我希望hadoop程序的输出仅是输入文件的一行。但是我还没有做到这一点。我也不想去 reducer 课。如果有人

我使用的输入文本文件的内容是 1 "Come 1 "Defects," 1 "I 1 "Information 1 "J" 2 "Plain 5 "Project 1

谁能告诉我以下grep命令的作用: $ bin/hadoop jar hadoop-*-examples.jar grep input output 'dfs[a-z.]+' 最佳答案 http:/

我不了解mapreducer的基本功能,mapreducer是否有助于将文件放入HDFS 或mapreducer仅有助于分析HDFS中现有文件中的内容 我对hadoop非常陌生,任何人都可以指导我理解

CopyFromLocal将从本地文件系统上载数据。 不要放会从任何文件上传数据,例如。本地FS,亚马逊S3 或仅来自本地fs ??? 最佳答案 请找到两个命令的用法。 put ======= Usa

我开始研究hadoop mapreduce。 我是Java和hadoop的初学者,并且了解hadoop mapreduce的编码,但是有兴趣了解它在云中的内部工作方式。 您能否分享一些很好的链接来说明

我一直在寻找Hadoop mapreduce类的类路径。我正在使用Hortonworks 2.2.4版沙箱。我需要这样的类路径来运行我的javac编译器: javac -cp (CLASS_PATH)

我是一名优秀的程序员,十分优秀!